Gemma 4 オンデバイス × 256K マルチモーダル徹底レビュー:BibiGPT のマルチモデルルーティングで 30+ プラットフォームの動画をワンクリックで吸収する 2026 ガイド

Gemma 4 オンデバイス × 256K マルチモーダル徹底レビュー:BibiGPT のマルチモデルルーティングで 30+ プラットフォームの動画をワンクリックで吸収する 2026 ガイド

結論先出し:Gemma 4 はオープンソースのオンデバイス・マルチモーダルを「実用ライン」に押し上げました。ただしオープン重みは製品ではありません。BibiGPT のマルチモデルルーティングは Gemma 4 を「オンデバイス控え + 長文コンテキスト高速レーン」として位置付け、クローズド SOTA を重ね、ユーザー体験を「リンクを貼る → 数分で結果」に収束させます。

オープンソース AI 動画理解を追っているなら、Gemma 4 は避けて通れない名前です。2026 年 4 月、Google DeepMind が E2B / E4B / 26B / 31B をまとめて公開しました。最大の話題は 31B のベンチマークではなく、8GB VRAM の MacBook Air、Snapdragon X Elite ノート、さらには iPad Pro でも動く E2B / E4B、そしてネイティブ音声・画像入力です。

レビューなので、要点だけ詰めます。Gemma 4 はどこで十分か、どこで足りないか、そして BibiGPT のマルチモデルルーティングを重ねた時に最終ユーザーが手にする体験は何か。

Gemma 4 で何が変わったのか

| モデル | パラメータ | コンテキスト | 配置形態 | 代表用途 |

|---|---|---|---|---|

| Gemma 4 E2B | 2B エッジ | 128K | スマホ / タブレット / WebGPU | 字幕リアルタイム整形、ショート動画クイック要約 |

| Gemma 4 E4B | 4B エッジ | 128K | ノート / エッジ | オフラインのポッドキャスト書き起こし整形 |

| Gemma 4 26B | 26B サーバー | 256K | 単発 H100 / RTX 6000 | 中長尺動画の章立て |

| Gemma 4 31B | 31B サーバー | 256K | デュアル GPU 推論 | TV シリーズ全話、長時間会議 |

数値は Google DeepMind の公式リリースとコミュニティの実測ベンチマークから。実スループットはハードと量子化次第。

世代ジャンプは三つ:

- 256K ロングコンテキスト:26B / 31B は 4 時間分の文字起こしを一度で飲み込みます。

- 音声 + 画像のネイティブ入力:別途 ASR パイプラインを差し込む必要なし。

- E2B / E4B が本当に動く:M3 Air(統合メモリ 24GB)で E4B 4-bit 量子化が毎秒 28-35 トークン安定。「カクつかない」体感ラインを越えました。

レビュー 1:オープン重み ≠ そのまま使える動画要約プロダクト

重みを落として推論を回すのは第一歩に過ぎません。「リンク貼って 5 分でビジュアル付き要約」を作るには最低限:

- クロスプラットフォームの素材取得:YouTube / B 站 / TikTok / 小宇宙 / 小红书 / ライブ切り出しのアンチボット対応;

- 多言語 ASR と字幕処理:Gemma 4 は音声を直接受けますが、4 時間ライブはチャンク化が必要;

- 章分割とタイムスタンプ整列:ノードクリックでプレイヤーを飛ばす;

- 書き出しと二次創作:記事 / PPT / マインドマップ / Anki / Obsidian / Notion 連携。

自前で組むのは可能ですが、「明日モデルを差し替えても既存ユーザーが壊れない」を満たすのは別次元のエンジニアリング。

レビュー 2:BibiGPT のマルチモデルルーティングが Gemma 4 を本当に使えるものにする

BibiGPT は Gemma 4 31B モデルをただ繋いだのではなく、Gemma 4 を GPT-5、Gemini 3.0 Pro、ドゥバオ Seed-1.6、MiMo V2 などと一緒に自動ルーティング層に組み込みました。ユーザーは「この動画を理解したい」と思うだけで、モデル選択は実装の細部です。

ルーティング戦略:Gemma 4 が活きる場面

| シナリオ | ルーティングの好み | 理由 |

|---|---|---|

| 1 時間以上の長尺 / ライブ切り出し | Gemma 4 31B (256K) | 長文コンテキスト、チャンク化不要 |

| 中国語ポッドキャスト深掘り | ドゥバオ Seed-1.6 / Gemma 4 26B | マルチモーダル長文、中文安定 |

| YouTube チュートリアル速読 | Gemma 4 E4B / GPT-5 | エッジ控え + メイン本線 |

| ビジュアル比重大(図表・PPT) | Gemini 3.0 Pro / Gemma 4 26B | ビジュアル整合性 |

| 自前 API キー利用 | 直接パススルー | Pro ユーザーの完全制御 |

BibiGPT で Gemma 4 を試す

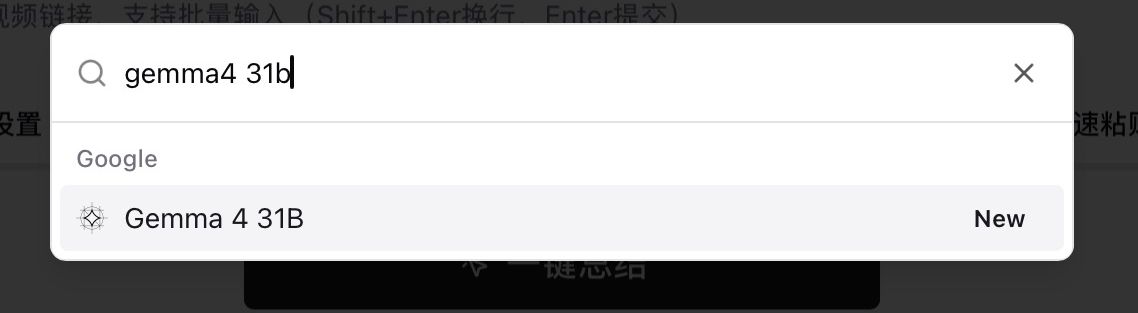

任意の動画詳細ページ → モデル選択 → 「gemma4 31b」検索 → 「New」タグ付きを選択 → 再生成。3 時間 47 分の台湾経済ポッドキャストで比較しました:

- GPT-5(既定):章立てクリーン、引用精度高、「教科書回答」スタイル。

- Gemma 4 31B:章は若干粗いが、長尺引用がより完全(256K の利点)。後続の AI 対話の素材に向く。

- ドゥバオ Seed-1.6:中国語のニュアンスが最も自然、業界スラングも原語に忠実。

結論:「最強モデル」はなく「最適モデル」だけが存在する——ルーティング層の存在意義そのもの。

レビュー 3:256K コンテキストが本当に解放するもの

256K は Gemma 4 26B / 31B の最も実体感のあるアップグレード。BibiGPT 上では従来チャンク化が必要だった 4 シナリオがそのまま回ります:

- ドラマ・バラエティのフル回:90 分以上を一気に;

- 学術カンファレンス・公開講座フル尺:3-4 時間の基調講演を一発;

- 年単位ポッドキャストコレクション:エピソード横断のテーマ整理、コレクション要約に最適;

- 長時間会議録:4 時間オールハンズ会議からアクションアイテム・決定事項を抽出。

これらの長尺出力は自動的に コレクション AI 対話へ入り、動画横断で問い合わせできるナレッジベースになります。

レビュー 4:E2B / E4B の本当の居場所

最も過小評価されている部分。E2B / E4B はオープンソースのベンチマーク稼ぎ用ではなく、用途は:

- プライバシー敏感:法務・医療・社内会議が端末を離れない;

- オフライン:機内、海外出張、回線制限環境;

- 完全ローカル PKM:Obsidian / 思源と組んで端末内ループを完結。

BibiGPT のローカルプライバシーモードと同じベクトル。デスクトップクライアントのロードマップに E4B のフルオフライン文字起こし控えが入っています。

今日 BibiGPT で Gemma 4 31B を試すなら:BibiGPT を開く → 動画リンクを貼る → モデル選択で「gemma4」検索。

Gemma 4 は誰向け?BibiGPT は誰向け?

| あなたのニーズ | Gemma 4 直接 | BibiGPT マルチモデルルーティング |

|---|---|---|

| 動画 AI を自作する開発者 | オープン重みが自由 | Agent Skillもカバー |

| 「今日使えるツール」 | パイプライン工数大 | リンク貼って終わり |

| コンテンツクリエイター・PKM | 二次創作系が不足 | 動画 → 記事、フラッシュカード、PPT |

| クロスプラットフォーム・多言語 | 取得層が弱い | 30+ プラットフォーム、4 言語ネイティブ |

| オフライン・プライバシー | E2B / E4B が合う | ローカルプライバシーモード |

| 複数モデル比較 | 自前ルーター | モデル選択ワンクリック |

総評:研究・自作・極限プライバシー → Gemma 4 重みを直接;明日リリースしたいワークフロー → BibiGPT のマルチモデルルーティングに任せる。

FAQ

Q1:Gemma 4 は本当に 256K サポート?手元では 32K で頭打ちでした。

256K は 26B / 31B 公式上限ですが、KV キャッシュ予算が実使用長を決めます。32K は VRAM 不足による強制カットアウトが大半。BibiGPT のサーバー側は 256K でロードするので、ユーザー側で KV キャッシュを意識する必要はありません。

Q2:E4B でオフライン動画要約、必要なハードは?

ベースライン:MacBook Air M3 / 統合メモリ 24GB / 4-bit 量子化で動作。Windows は VRAM 16GB 以上推奨。ただしエッジモデルは「理解」だけを解き、クロスプラットフォーム取得や ASR は依然ネットワークが必要。完全オフラインはローカルファイル限定。BibiGPT デスクトップ版がそのギャップを埋めています。

Q3:同じ動画を Gemma 4 31B と GPT-5 で要約すると差は大きい?

差は 3 軸:章の粒度(GPT-5 のほうが細かい)、引用完全性(Gemma 4 31B の長文優位)、中国語のニュアンス(ドゥバオ / Gemma 4 26B が自然)。長尺は Gemma 4 31B で長い引用 → GPT-5 で精緻化、が定石。BibiGPT のカスタムプロンプト要約で即再生成可能。

Q4:BibiGPT がシナリオに応じて自動ルーティングできる?

Pro 会員はカスタムプロンプトでモデル選好を固定可能(カスタム要約のデフォルトピン留め)。動画タイプ・長さ・言語からのシステム自動ルーティングはベータ。

Q5:モデルは気にせず動作する動画要約ツールが欲しい。

BibiGPT のデフォルトでどうぞ。ユーザー 100 万人以上、累計 AI 要約 500 万件以上、30+ プラットフォーム対応。モデルルーティングは裏で完結し、ユーザー体感は「リンクを貼って数分待つだけ」。

関連リンク

- 本番運用へのルーティング設計:マルチモデルアーキテクチャ

- エッジ + プライバシー:ローカルプライバシーモード

- 長尺コンテンツを再利用可能な知識へ:コレクション要約

- ビジュアル + タイムスタンプの連携:マインドマップ タイムスタンプジャンプ

- 同系統のモデル比較:NotebookLM 80 言語 vs BibiGPT 多言語

最後に:オープンソースモデルファミリーのリリースは止まりません。価値はルーティング層で積み上がります。すでに BibiGPT を使っているならそのままリンクを貼ってください。まだなら、BibiGPT で Gemma 4 31B を今すぐ試す。

— BibiGPT チーム