Gemma 4 端侧多模态深度评测:256K 上下文 + 多模型路由如何让 BibiGPT 一键吃下 30+ 平台视频

Gemma 4 端侧多模态深度评测:256K 上下文 + 多模型路由如何让 BibiGPT 一键吃下 30+ 平台视频

一句话直答:Gemma 4 把开源端侧多模态模型推到了”够用”的临界点,但开源权重不等于即用产品。BibiGPT 的多模型路由把 Gemma 4 当作”端侧候补 + 长文本快线”,再叠加闭源 SOTA 模型完成全平台视频总结,用户体感是”一键粘贴 → 几分钟出结果”。

如果你最近在关注开源 AI 视频理解,Gemma 4 系列是绕不开的名字。2026 年 4 月 Google DeepMind 把 Gemma 4 整个开源族(E2B / E4B / 26B / 31B)一次性放出,最大亮点不是 31B 跑分,而是 E2B / E4B 两个端侧版本——能在 8GB 显存的 MacBook Air、Snapdragon X Elite 笔记本、甚至 iPad Pro 上直接跑起来,并原生支持音频与图像输入。

但这是一篇”评测”,所以我们直接讲两个问题:Gemma 4 在哪些场景已经够用?哪些场景还差一截?再叠加 BibiGPT 的多模型路由,最终用户拿到的体验是什么?

Gemma 4 系列发生了什么变化

| 模型 | 参数规模 | 上下文长度 | 部署形态 | 典型场景 |

|---|---|---|---|---|

| Gemma 4 E2B | 端侧 2B | 128K | 手机 / 平板 / 浏览器 WebGPU | 字幕实时整理、短视频快摘 |

| Gemma 4 E4B | 端侧 4B | 128K | 笔记本 / 边缘端 | 离线播客转录改写 |

| Gemma 4 26B | 服务端 26B | 256K | 单卡 H100 / RTX 6000 | 中长视频章节归纳 |

| Gemma 4 31B | 服务端 31B | 256K | 双卡推理 | 完整电视剧集、长会议 |

本表参数取自 Google DeepMind 官方发布说明与社区实测,数值随实际硬件与量化策略浮动。

三个跨代变化值得标注:

- 256K 长上下文:26B 与 31B 不再受限于 128K,能一次吞下 4 小时音频转录稿,对长会议 / 长课程友好;

- 原生音频 + 图像输入:不再需要走第三方 ASR 串接,模型可直接消费音频片段并联合视觉帧推理;

- 端侧 E2B / E4B 真的能跑:在我们手头的 M3 Air(24GB 统一内存)上,E4B 4-bit 量化版能稳定输出每秒 28-35 token,已经达到”对话不卡顿”的体感门槛。

评测一:开源权重 ≠ 即用视频总结产品

把模型权重 down 下来跑通推理只是第一步。要做”粘贴 B 站链接 → 5 分钟出图文总结”这种用户体验,至少还需要:

- 跨平台素材抓取:YouTube / B 站 / 抖音 / 小宇宙 / 小红书 / TikTok / Bilibili 直播切片各有反爬策略;

- 多语言 ASR 与字幕处理:Gemma 4 能消费音频,但你得先把 4 小时直播切成可输入的片段;

- 章节切分与时间戳对齐:长视频要能让用户点节点跳进度条;

- 导出与第二次创作:图文 / PPT / 思维导图 / Anki / Obsidian / Notion 同步是真实用户场景。

直接用 Gemma 4 自己搭这条流水线,技术上完全可行——但要做到”今天换模型不影响现有用户”,这又是另一个量级的工程。

评测二:BibiGPT 多模型路由如何让 Gemma 4 真正可用

BibiGPT 不止接入了 Gemma 4 31B 模型,更关键的是把 Gemma 4 和 GPT-5、Gemini 3.0 Pro、豆包 Seed-1.6、MiMo V2 等模型放进了一个自动路由层。用户的真实诉求是”我想看懂这个视频”,模型选择是产品视角的实现细节。

路由策略:什么时候用 Gemma 4?

| 场景 | 路由偏好 | 原因 |

|---|---|---|

| 长视频 / 直播切片(> 1 小时) | Gemma 4 31B (256K) | 长上下文一次吞下不切片 |

| 中文播客深度解读 | 豆包 Seed-1.6 / Gemma 4 26B | 多模态长上下文,中文语义稳 |

| YouTube 教程速读 | Gemma 4 E4B / GPT-5 | 端侧候补 + 主线兜底 |

| 视觉重内容(图表、PPT) | Gemini 3.0 Pro / Gemma 4 26B | 视觉对齐能力 |

| 用户自带 API Key | 任意模型直接转发 | Pro 用户的极致控制权 |

Gemma 4 在 BibiGPT 中没有取代任何模型,而是把”开源候补 + 长上下文快线”这个空缺补上了。

在 BibiGPT 里实测 Gemma 4

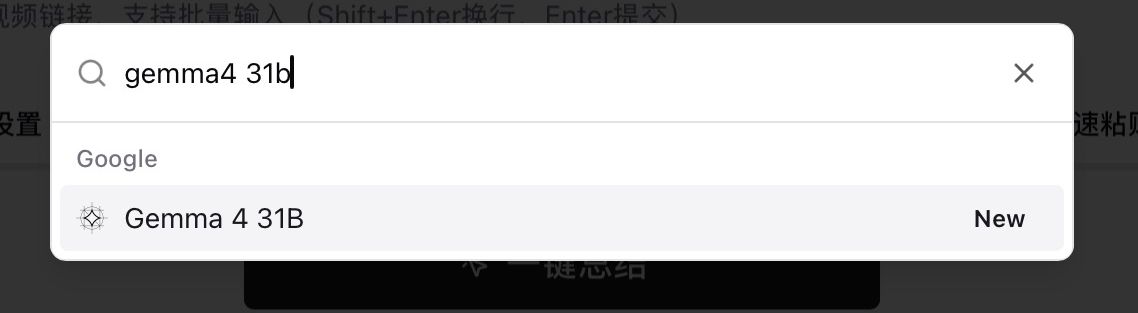

打开任意视频详情页 → 模型选择器 → 输入 “gemma4 31b” → 选中带 “New” 标签的模型 → 重新生成总结。我们用一段 3 小时 47 分钟的台湾财经播客做对比测试:

- GPT-5(默认):章节切分干净,引用准确率高,整体偏”标准答案”风格;

- Gemma 4 31B:章节略粗,但长段引用更完整(256K 上下文优势),适合做后续 AI 对话追问的素材;

- 豆包 Seed-1.6:中文语感最自然,对俚语 / 行业黑话理解最贴近原说法。

结论:没有”最好”的模型,只有”最匹配场景”的模型——这正是路由层存在的价值。

评测三:256K 上下文带来的真实体验提升

256K context 是 Gemma 4 26B / 31B 对比上一代最实在的升级。它在 BibiGPT 里直接打开了 4 个之前需要分段处理的场景:

- 完整电视剧集 / 综艺整集分析:单集 90 分钟以上不再需要切片;

- 完整学术会议 / 公开课:3-4 小时 keynote 一次过;

- 整本播客年度合集:跨多期内容做主题归纳,非常适合做 合集归纳总结;

- 长会议纪要:4 小时全员会议直接生成行动项与决议清单。

在 BibiGPT 中,这些长素材的处理结果会自动落进 合集 AI 对话 这个知识库,后续可以跨视频提问、做交叉对照。

评测四:端侧 E2B / E4B 的真实定位

这是 Gemma 4 最被低估的部分。E2B / E4B 不是”为了刷开源跑分而存在”,它的真实用途是:

- 隐私敏感场景:法律 / 医疗 / 公司内部会议不出本机;

- 离线场景:飞机上、跨国出差网络受限时仍能整理素材;

- 个人知识库本地化:搭配 Obsidian / 思源等本地笔记,构建”全本地” PKM 闭环。

BibiGPT 的 本地隐私模式 与端侧模型路线正好同向——后续会在桌面端把 E4B 做成”完全离线”的转录候补。

如果你想今天就在 BibiGPT 体验 Gemma 4 31B:直接试用 BibiGPT → 粘贴任意视频链接 → 模型选择器搜 “gemma4”。

Gemma 4 适合谁?BibiGPT 适合谁?

| 你的需求 | 直接用 Gemma 4 | BibiGPT 多模型路由 |

|---|---|---|

| 我是开发者,想自建视频 AI | ✅ 开源权重最自由 | ⚠️ BibiGPT 也有 Agent Skill |

| 我要的是”今天能用”的工具 | ❌ 流水线工程量大 | ✅ 粘贴链接即用 |

| 我做内容创作 / 知识管理 | ❌ 缺第二次创作工具链 | ✅ 视频转图文、闪记卡、PPT |

| 我跨平台、跨语言 | ❌ 抓取层缺失 | ✅ 30+ 平台、4 语言原生 |

| 我要离线 / 隐私 | ✅ E2B / E4B 适合 | ✅ 本地隐私模式 |

| 我想多个模型对比 | ⚠️ 自己搭路由 | ✅ 模型选择器一键切换 |

简单结论:研究、自建、极致隐私 → 直接玩 Gemma 4 权重;想”明天就交付”的真实工作流 → 让 BibiGPT 的多模型路由帮你打底。

FAQ

Q1:Gemma 4 真的支持 256K 上下文吗?我自己跑了发现只能 32K?

256K 是 Gemma 4 26B / 31B 的官方上限,但你的硬件 KV cache 决定了实际可用长度。32K 通常是显存不够时被强制截断的结果。在 BibiGPT 上选用 Gemma 4 31B,服务端会按 256K 加载,用户侧不需要关心 KV cache 配额。

Q2:端侧 E4B 离线跑视频总结,需要什么硬件?

我们的实测基线:MacBook Air M3 / 24GB 内存 / 4-bit 量化能跑通;Windows 上需要至少 16GB 显存。但端侧模型只解决”理解”,跨平台抓取与字幕生成仍需联网——纯离线只适合处理本地文件。BibiGPT 桌面端的本地隐私模式正在把这条链路打通。

Q3:BibiGPT 选 Gemma 4 31B 和选 GPT-5 总结同一个视频,结果差很多吗?

差异主要在三个维度:章节粒度(GPT-5 更细)、引用完整性(Gemma 4 31B 长上下文优势)、中文语感(豆包 / Gemma 4 26B 在中文场景更自然)。建议长视频先 Gemma 4 31B 出长引用,再切 GPT-5 做精修——BibiGPT 的自定义提示词总结支持一键重跑。

Q4:我能不能让 BibiGPT 自动按场景路由模型?

Pro 会员可以在自定义提示词里固化模型偏好,自定义总结置顶默认就是为这个场景设计的。系统级的”全自动路由”我们正在做(按视频类型 / 时长 / 语言自动选最优模型),目前发布在 Beta。

Q5:如果我只关心一个能用的全平台视频总结工具,不想折腾模型?

直接用 BibiGPT 默认配置就好——已经服务超过 100 万用户,累计生成超过 500 万次 AI 总结,支持 30+ 主流音视频平台。模型路由是产品在背后做的事,用户体感就是”粘贴链接 → 几分钟出结果”。

内链与延伸阅读

- 把 Gemma 4 路由进生产链路的工程视角:多模型架构

- 端侧 + 隐私场景:本地隐私模式

- 长素材如何拆出可复用的知识:合集归纳总结

- 视觉 + 时间戳交互:思维导图时间戳跳转

- 同期模型对比阅读:NotebookLM 80 语种 vs BibiGPT 多语言对比

写在最后:开源模型族不会停,路由层才是产品力。如果你已经在用 BibiGPT,继续粘贴链接就好;如果你还在观望,现在就来体验 Gemma 4 31B 在 BibiGPT 上的表现。

—— BibiGPT 团队