OpenClaw 25万スター・OpenAIが買収:AIエージェント時代にBibiGPT動画要約で学習を加速する方法

OpenClawが60日でGitHub史上最速成長記録を更新し、OpenAIに買収されました。AIエージェント時代、BibiGPTのAI動画要約とbibigpt-skillで5ステップの動画学習パイプラインを構築しましょう。

OpenClaw 25万スター・OpenAIが買収:AIエージェント時代にBibiGPT動画要約で学習を加速する方法

2026年2月、AI業界を揺るがす出来事が起きました。

Peter Steinbergerが開発したオープンソースAIエージェントフレームワークOpenClawが、わずか60日で25万GitHubスターを獲得。Reactが10年かけて積み上げた記録を一気に塗り替えたのです。

OpenAIはすぐに動きました。Steinbergerを採用し、「AIエージェントをすべての人に届ける」プロジェクトに参加させました。これは明確なシグナルです——AIエージェントは、開発者のおもちゃから、誰もが使う日常インフラへと変わる時が来た。

動画コンテンツで毎日学ぶ知識ワーカーにとって、この変化は何を意味するのでしょうか?あなたのAIアシスタントが真に「動画を観て、情報を抽出し、知識ベースを構築してくれる」時代が来たということです。BibiGPTがその実現を可能にする核心ツールです。

OpenClawの爆発的成長の真意:「会話AI」から「行動AI」へ

OpenClawが提供する根本的な能力はシンプルです:AIモデルが質問に答えるだけでなく、コンピュータを直接操作して実際のタスクを実行すること。

- メール自動確認・返信・アーカイブ

- ブラウザ自動操作でフォーム入力、予約、ショッピング

- 30分ごとに自動実行されるハートビートタスク

- Slack、WhatsApp経由でMacをリモート操作

3,500以上のコミュニティスキルがClickUp、GitHub、Figma、スマートホームと連携。OpenAIによる買収は単なる人材獲得ではなく、AIエージェントが次世代コンピューティングパラダイムであると宣言したものです。

AIエージェントがまだ見えない場所:動画

テキスト、コード、API——AIエージェントはこれらをすでに得意としています。しかし動画は孤立した島のまま。

YouTubeには毎分500時間の動画がアップロードされ、Bilibiliには毎日数百万本のコンテンツが公開されます。これらの豊かな知識のほとんどは、AIエージェントが自動処理できないまま放置されています。

OpenClawのネイティブsummarizeスキルはYouTubeのみ対応。Bilibili、小红書、抖音、ポッドキャストには対応していません。

ここでbibigpt-skillの出番です。

bibigpt-skill:AIエージェントに動画理解能力を装着する

bibigpt-skillは、BibiGPTの完全な動画処理パイプラインを標準CLIとして公開し、OpenClaw/Claude Codeなどのエージェントが直接呼び出せるようにします。

# Claude Code環境でbibigpt-skillをインストール

npx skills add JimmyLv/bibigpt-skill

# エージェントに指示:

# 「このBilibili動画を要約して、主要な主張を3つ抽出して」

# エージェントが自動的にbibi summarizeを呼び出す

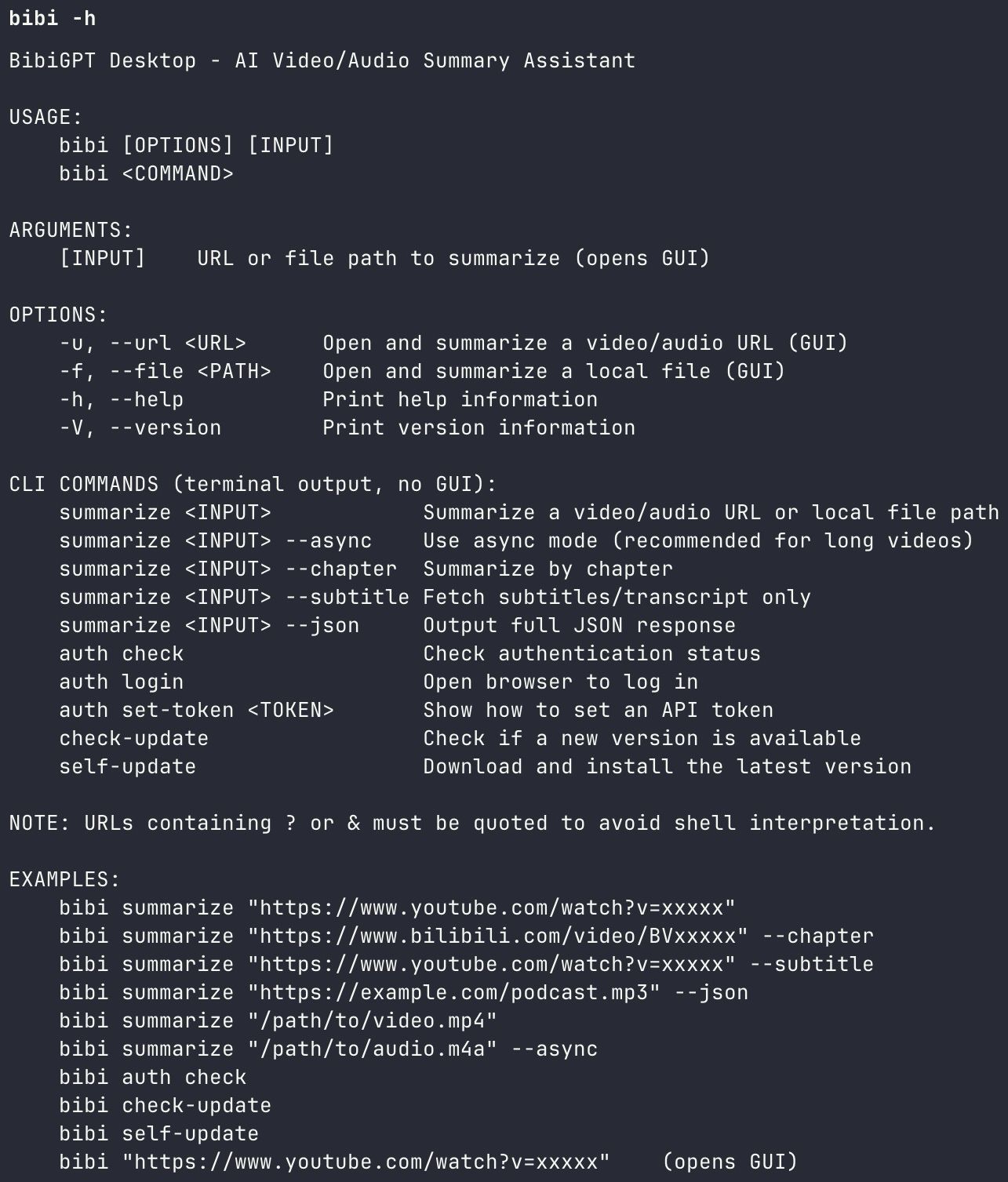

BibiGPT CLIとbibigpt-skillのインストール画面

BibiGPT CLIとbibigpt-skillのインストール画面

詳細な比較ガイドは OpenClaw + BibiGPT Skill: Bilibili・小红書対応AI動画要約を参照してください。

AIエージェント時代の動画学習5ステップパイプライン

BibiGPT + OpenClaw(またはClaude Code)を使った個人動画学習自動化システムです。

ステップ1:自動収集——エージェントに情報源を監視させる

毎朝8時に実行されるOpenClawハートビートタスク:

1. 購読中のYouTubeチャンネル+Bilibili投稿者の新着動画リストを取得

2. 各動画にbibi summarize "<url>" --chapter --jsonを実行

3. Markdownダイジェストを生成→Slack/メールに送信

ステップ2:構造化要約——箇条書きではなく知識ブロックで

bibi summarize --chapterモードが動画をチャプター単位の知識ブロックに分解:

- 核心的主張(1〜3文)

- 重要データポイント

- タイムスタンプアンカー

認知科学の研究(Mayer 2021)では、構造化された要約は線形読解と比べて情報保持率を約40%向上させることが示されています。

ステップ3:深い理解——マインドマップ+出典追跡Q&A

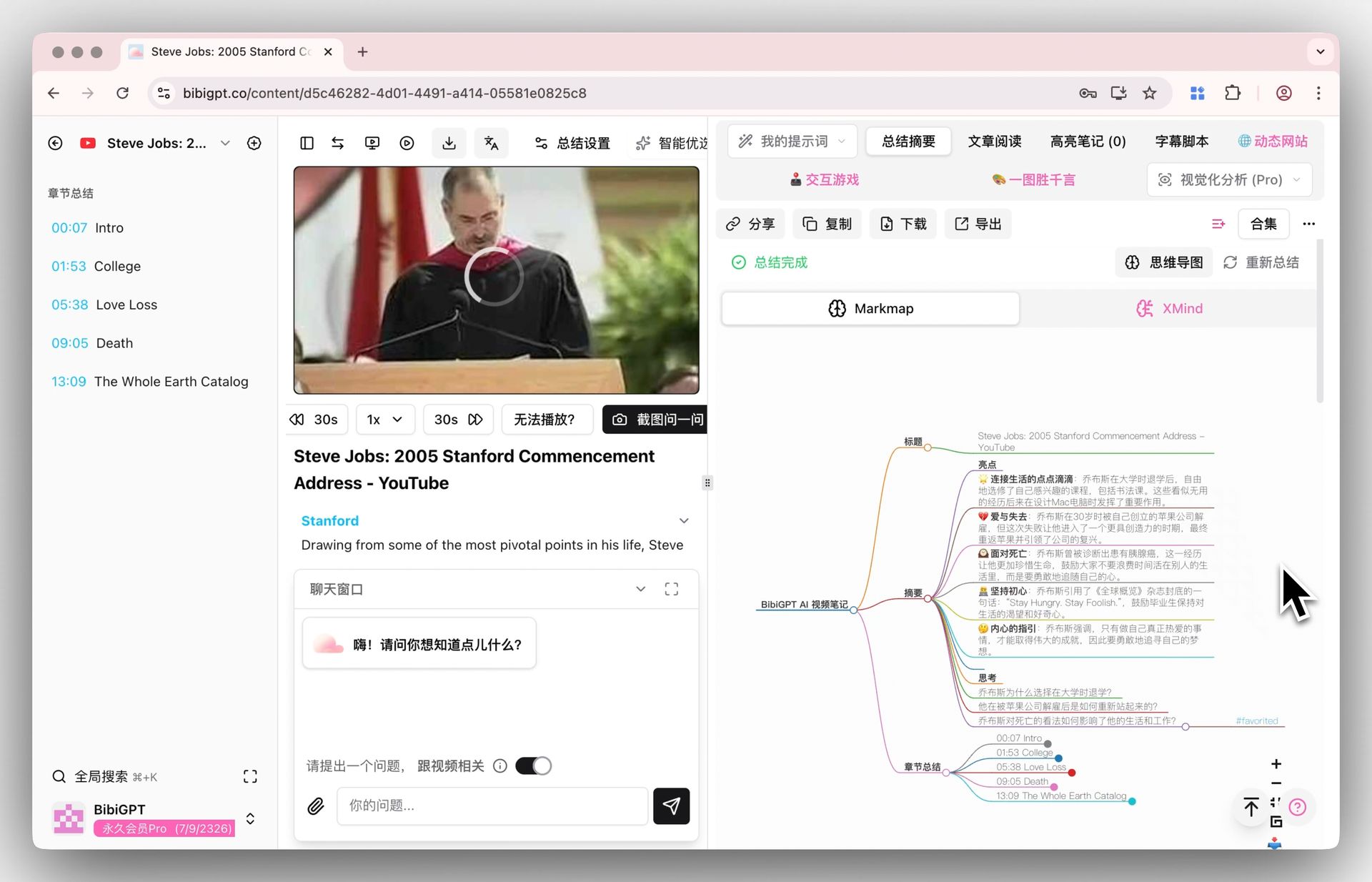

インラインマインドマップ:テキスト要約とXMind/Markmapビューをページを離れずに切り替え。

BibiGPTインラインマインドマップ XMindビュー

BibiGPTインラインマインドマップ XMindビュー

AI動画チャット&インテリジェント出典追跡:チャットウィンドウで動画内容について質問すると、すべての回答にクリック可能なタイムスタンプが付き、元の動画クリップに直接ジャンプできます。

ステップ4:能動的復習——フラッシュカード+Anki間隔反復

BibiGPTのフラッシュカード機能が動画内容を自動的にQ&Aカードに変換:

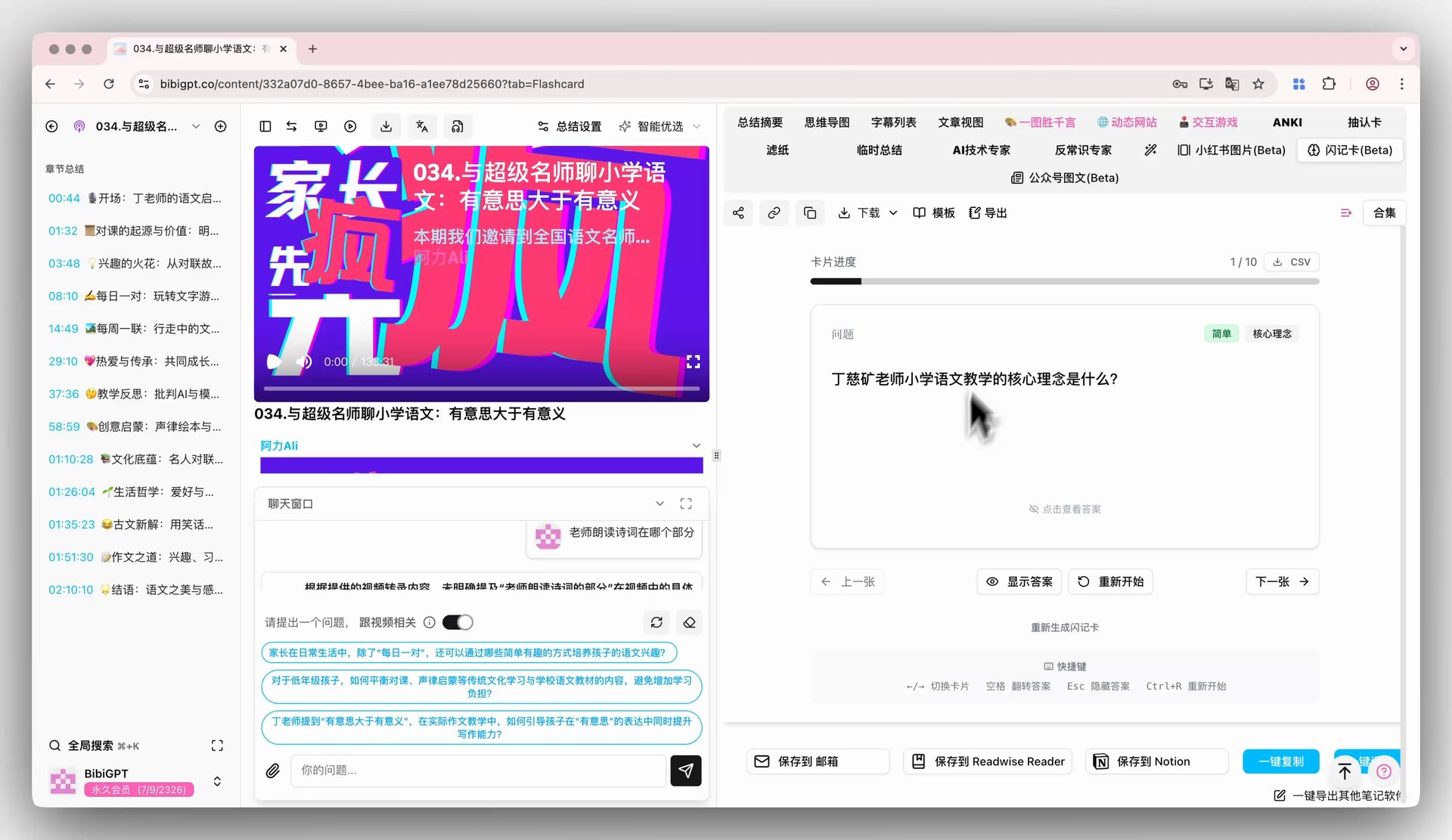

BibiGPTフラッシュカード:動画からAnkiカードを自動生成

BibiGPTフラッシュカード:動画からAnkiカードを自動生成

- 動画の核心概念からQ&Aカードを自動生成

- BibiGPT内でインタラクティブに復習

- CSVでエクスポートしてAnkiにインポート→科学的間隔反復

ステップ5:知識出力——理解を共有可能なインサイトに

- 要約から重要箇所をハイライト収集

- 共有用画像カードを生成(小红書カバー、X/Twitterカード形式)

- Notion、Obsidian、Readwiseにエクスポート

今すぐ始めよう

# BibiGPTデスクトップをインストール(bibi CLI含む)

brew install --cask jimmylv/bibigpt/bibigpt # macOS

# bibigpt-skillをインストール

npx skills add JimmyLv/bibigpt-skill

# 認証確認

bibi auth check

BibiGPTでAIエージェント時代の動画学習を始めましょう:

- 🌐 Webサイト: https://aitodo.co

- 💻 デスクトップダウンロード: https://aitodo.co/download/desktop

- ✨ 全機能を見る: https://aitodo.co/features

BibiGPTチーム