DeepSeek-V4 登場!BibiGPTが当日4つの新モデル+1Mコンテキスト対応 — AI 動画・ポッドキャスト要約が大幅アップグレード

DeepSeek-V4 プレビュー版が本日公開・オープンソース化され、1M コンテキストと Opus 4.6 に迫る Agent 能力を提供します。BibiGPTは当日統合を完了し、Pro / Pro Thinking / Flash / Flash Thinking の 4 モデルはモデルピッカーから直接選べます。何が変わったか、どう切り替えるか、どのシナリオにどのモデルが合うか、そしてBibiGPTがその上に積み上げた長尺コンテンツ処理能力を、実使用ノートとしてまとめました。

DeepSeek-V4 登場!BibiGPTが当日4つの新モデル+1Mコンテキスト対応 — AI 動画・ポッドキャスト要約が大幅アップグレード

本日(2026 年 4 月 24 日)、DeepSeek-V4 プレビュー版が正式公開・オープンソース化されました。1M コンテキストが標準装備となり、Agent 能力は Sonnet 4.5 ラインに到達。BibiGPTは当日統合を完了し、DeepSeek V4 Pro、V4 Pro Thinking、V4 Flash、V4 Flash Thinking の 4 モデルをモデルピッカーから直接選択できます。フルレングスのドキュメンタリー、2 時間のインタビュー、1 シーズン分のポッドキャストにすぐ適用できます。

新モデルをいくつかの実シナリオで早速動かしてみた記録を、同種のニーズを持つ方への参考として同時公開します。

BibiGPTの要約モデル一覧に追加された DeepSeek V4 シリーズ 4 モデル

BibiGPTの要約モデル一覧に追加された DeepSeek V4 シリーズ 4 モデル

目次

- DeepSeek-V4 今回変わったポイント

- BibiGPTに同時搭載された DeepSeek V4 の 4 モデル

- 3 ステップで DeepSeek V4 に切り替える

- 実戦:DeepSeek V4 Pro で DeepSeek 自身の発表動画を要約

- V4 に切り替えると即座に反映されるシナリオ

- AI 時代、本当に希少なのはモデルではなくコンテンツ消費速度

- よくある質問(FAQ)

DeepSeek-V4 今回変わったポイント

DeepSeek-V4 は主要な 3 つの軸を同時に動かしてきました。それぞれ個別に触れる価値があります。

第 1、1M コンテキストが DeepSeek 公式サービスのデフォルトに。 新しいアテンション機構がトークン次元で圧縮を行い、DSA(DeepSeek Sparse Attention)と組み合わせてメモリと計算コストを大幅に削減しました。要するに、1 時間分の字幕を投入しても、以前のような「分割して貼り合わせる」工程が不要となり、モデルが一続きの内容として一度に読みます。

第 2、Agent 能力が明確に一段上がりました。 DeepSeek 自身の測定によれば、V4-Pro は Agentic Coding でオープンソース最高水準、提供品質は Opus 4.6 非思考モードに近く、社内ですでにデフォルトのコーディングモデルになっています。一般ユーザーにとっては、長文の構造化処理(チャプター分け、要点抽出、マインドマップ生成)の安定性が目に見えて改善したということです。

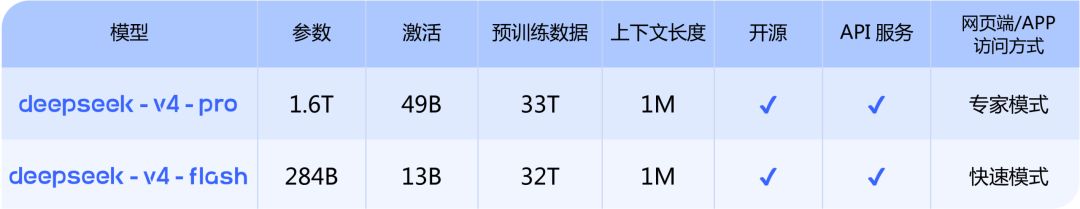

第 3、Pro と Flash で両サイドをカバー。 Pro(1.6T パラメータ / 49B アクティブ / 33T 事前学習)は最上位クローズドモデルと勝負、Flash(284B / 13B / 32T)はコスパ重視。どちらも思考・非思考モード対応、reasoning_effort も調節可能。簡単なタスクは Flash、重いタスクは Pro — 両方とも堅実な使用感です。

DeepSeek V4 Pro と V4 Flash の公式スペック比較表

DeepSeek V4 Pro と V4 Flash の公式スペック比較表

詳細な原文(中国語)は DeepSeek 公式の 《DeepSeek-V4 プレビュー版:百万トークン時代の普遍化》 にあります。モデル重みは Hugging Face の DeepSeek V4 コレクション (Pro / Pro-Base / Flash / Flash-Base の 4 つの repo)からダウンロードでき、テクニカルレポートは DeepSeek_V4.pdf で直接閲覧できます。

BibiGPTに同時搭載された DeepSeek V4 の 4 モデル

任意の動画または音声の要約設定を開き、モデルピッカーで deepseek と入力すると、New タグの付いた 4 つの新エントリが表示されます:

BibiGPTのモデルピッカーで deepseek を検索 — 上段 4 つが V4 シリーズ

BibiGPTのモデルピッカーで deepseek を検索 — 上段 4 つが V4 シリーズ

| モデル | 用途 | 思考モード |

|---|---|---|

| DeepSeek V4 Pro | 最高品質、長い論理チェーンが必要なコンテンツ | 非思考 |

| DeepSeek V4 Pro Thinking | V4 Pro + 明示推論、Agent ・分析タスク | 思考 |

| DeepSeek V4 Flash | コスパ優先、短く軽めのコンテンツ | 非思考 |

| DeepSeek V4 Flash Thinking | Flash + 推論、速度と深度のバランス | 思考 |

どれを選ぶ? シンプルな判断ルール:

- 長めのコンテンツ(1 時間超、フルシーズン・ポッドキャスト、長いインタビュー) → Pro か Pro Thinking、全体にわたる深い推論を得たいとき

- 短めのコンテンツ(30 分以下の会議、日常 Vlog) → Flash、より速く経済的

- モデルに段階的に推論させ、観点を比較し、より深く分析してほしい → Thinking バージョン

- きれいな要約だけで、推論過程は不要 → 非思考バージョン

細かく比べるのが面倒な場合は V4 Pro Thinking から試してみてください。ほとんどの長尺コンテンツで安定した結果を返します。

3 ステップで DeepSeek V4 に切り替える

BibiGPTホーム画面の「デフォルトモデル」入口

BibiGPTホーム画面の「デフォルトモデル」入口

- BibiGPTを開き、YouTube / ポッドキャスト / ローカルファイルのリンクを入力欄に貼り付け

- 入力欄下の デフォルトモデル をクリック、検索窓に

deepseekと入力 - New タグの付いた 4 つから 1 つ選び、要約ボタンをクリック

選択はセッション間で保持されます。ヘビーユーザーなら、V4 Pro Thinking をデフォルトのカスタム要約にピン留めしておくと、以後すべての動画が自動でこのモデルで処理されます。

モデルを切り替える前にBibiGPTの要約品質を体感したい場合は、下のウィジェットにリンクを貼ってみてください:

试试粘贴你的视频链接

支持 YouTube、B站、抖音、小红书等 30+ 平台

実戦:DeepSeek V4 Pro で DeepSeek 自身の発表動画を要約

最初にやったこと:V4 Pro で DeepSeek 自身の発表動画を回してみました。約 1 分 30 秒の短いクリップ、思考モード ON で、モデルは動画を 7 つの構造化チャプターに分割し、それぞれに要約・ハイライト・思考・批判的レビューを付与しました。

BibiGPTが DeepSeek V4 Pro で DeepSeek V4 発表動画を要約した画面

BibiGPTが DeepSeek V4 Pro で DeepSeek V4 発表動画を要約した画面

注目すべきポイント:

- 事実カバレッジが完全:発表の 5 大ポイント(百万コンテキスト標準化、Agent 能力飛躍、世界知識リード、デュアルティア柔軟性、Agent エコシステム対応)がパラメータ数字まで正確に再現

- すべての結論が追跡可能:各結論にクリック可能なタイムスタンプが付き、動画の該当箇所にワンクリックでジャンプ

- 後続質問を自動生成:要約の下に「V4 の 2 ティアの違いは?」「API からどう呼び出す?」といった質問が自動生成、ワンタップで深掘り対話へ

今回の改善は主に 思考モードがもたらす深い推論 に由来します。長尺コンテキスト自体はBibiGPT内の主要モデルですでにデフォルトの経路で、V4 の加入によりオープンソース陣営でも「深い推論 + 全文カバレッジの安定性」の組み合わせを第一級の品質で提供できるようになりました。

看看 BibiGPT 的 AI 总结效果

松尾豊教授に聞く、生成AIの「次の10年」

PIVOTのロングインタビュー。LLMの進化軸、ソブリンLLM、ロボティクス、そして三つの言葉について松尾豊教授が語る。

V4 に切り替えると即座に反映されるシナリオ

オープンソースモデルが次々と出てくる中、こう聞かれそうです:DeepSeek 公式サイトや API を直接使えばいいのでは?なぜBibiGPT経由?

鍵はシナリオにあります。DeepSeek 公式サイトは汎用チャットボックスで、動画のダウンロード、文字起こし、貼り付け、プロンプトまで自分で対応する必要があります。BibiGPTが長年やってきたことは一つ:長編動画とポッドキャストを、記事を読むように消化できる形に変えること。V4 はそのスタックに加わった最新の能力であり、「リンクを貼れば本当に理解できる」を成り立たせているのは、モデルの上に積み上げた製品レイヤーです。

BibiGPTの既存機能のうち、以下のシナリオは 「デフォルトモデル」で選んだモデルにそのまま従います — 言い換えると、DeepSeek V4 に切り替えた瞬間、これらの機能は V4 で動作します。

📝 動画要約(デフォルト要約 + カスタムプロンプト)

動画を貼り付けた後に一番よく押す「ワンクリック要約」は、現在選択中のモデルで生成されます。保存済みのカスタムプロンプト(「反直感エキスパート」「批判的思考」「投資分析」など)も同じモデルを通ります。DeepSeek V4 Pro Thinking に切り替えてから、同じ動画・同じプロンプトでもう一度走らせれば、推論チェーンと構造の違いを横並びで比較できます。この領域は私たち自身もまだ様々なコンテンツで試している最中なので、ぜひ実際に回してみて、結果が業務の感覚に合うかどうかを確かめてみてください。

BibiGPT カスタムプロンプト要約:モデル切り替え後に同じプロンプトの結果を並べて比較

BibiGPT カスタムプロンプト要約:モデル切り替え後に同じプロンプトの結果を並べて比較

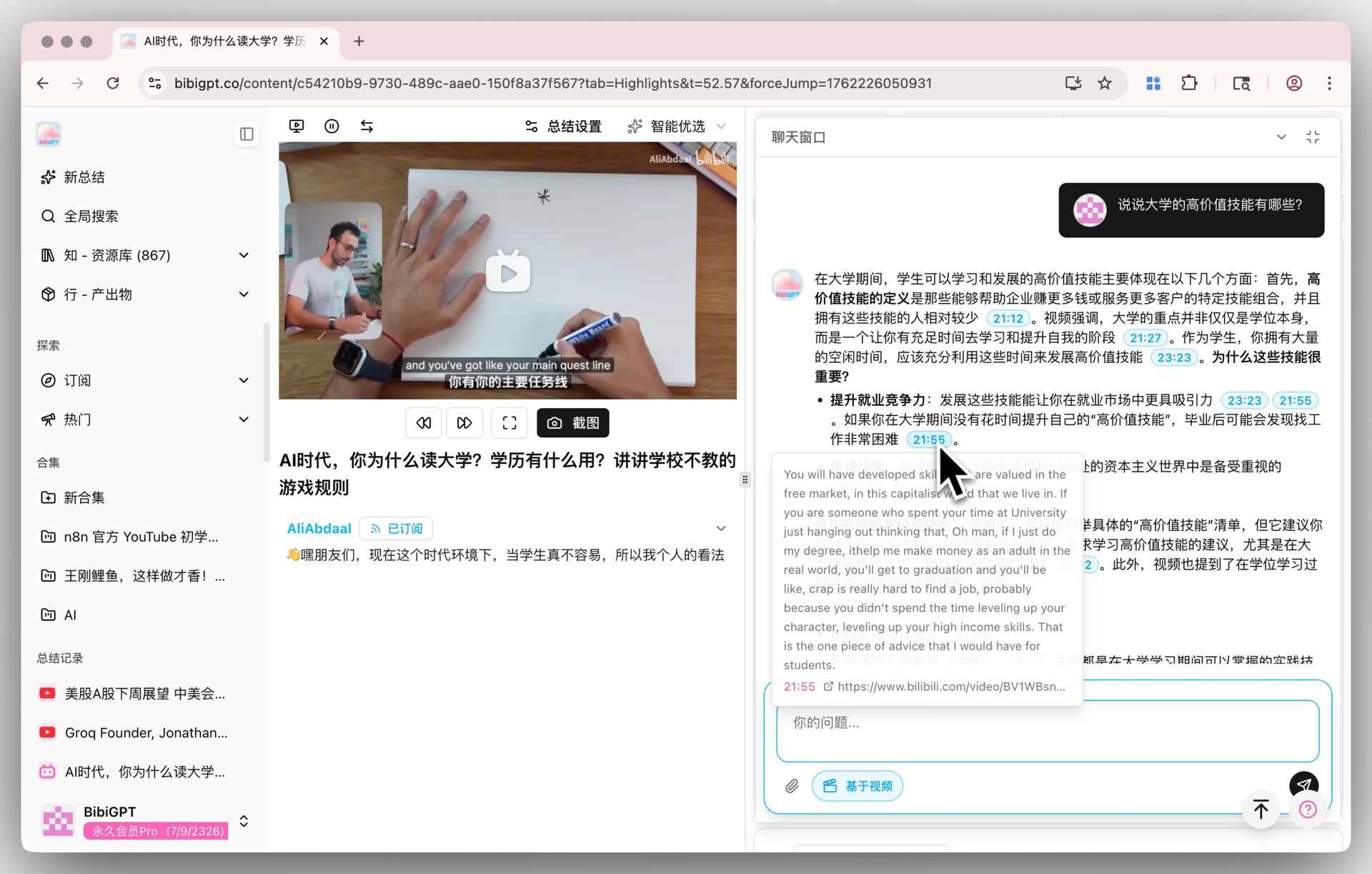

🎯 AI 動画対話とソーストレース

動画詳細ページ下部の「チャットウィンドウ」もデフォルトモデルに従います。モデルの答えすべてにクリック可能なタイムスタンプが付き — 「1:12:30 で反対のことを言ってた」、ワンクリックでその瞬間へ。V4 に切り替えたら、1 時間以上のインタビューを選んで数ターン連続で追い質問してみてください。モデル差が比較的出やすいシナリオで、一度ご自身の手で走らせてみる価値があります。

AI 動画対話とソーストレース:すべての答えにクリック可能なタイムスタンプ

AI 動画対話とソーストレース:すべての答えにクリック可能なタイムスタンプ

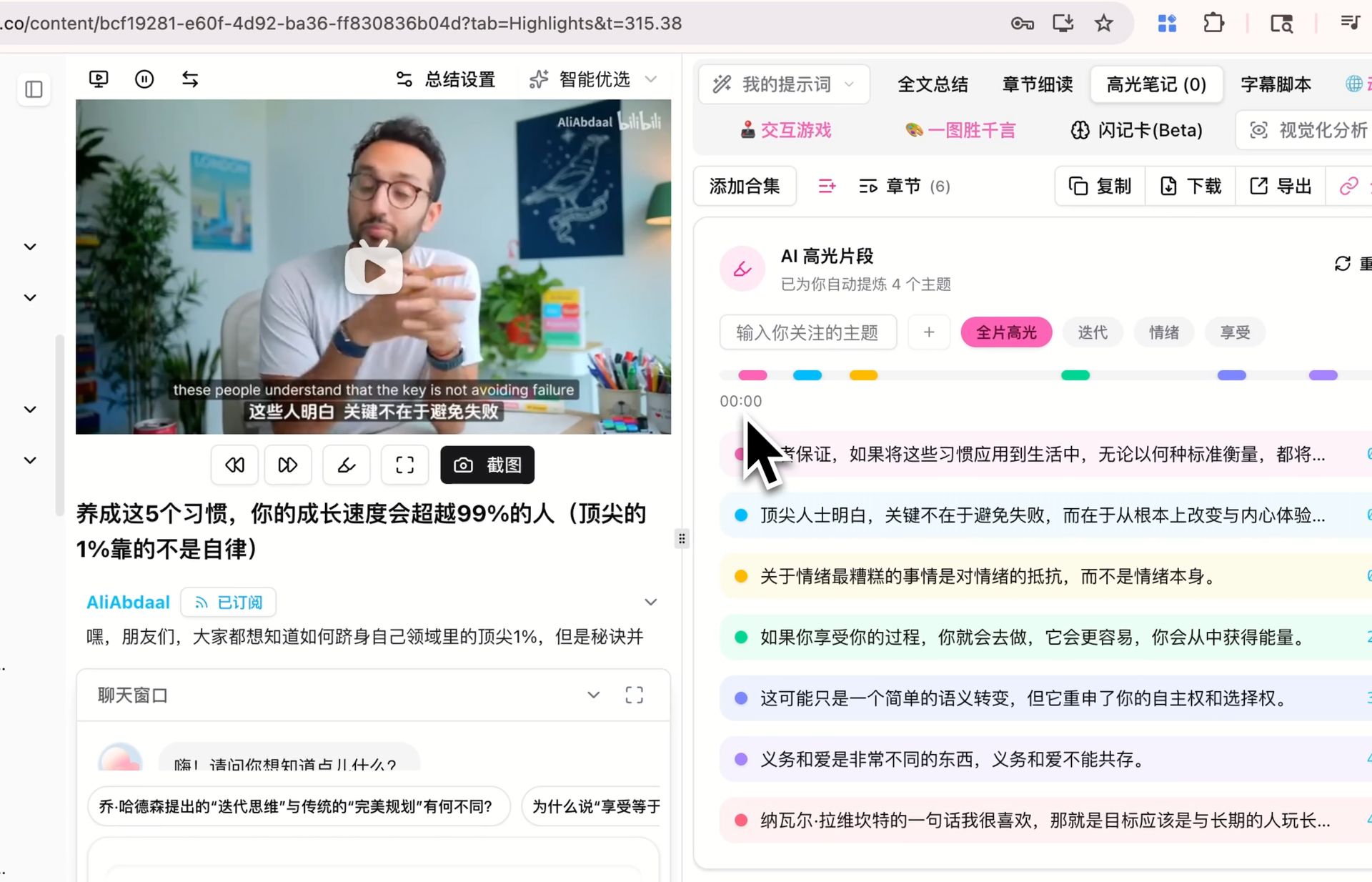

🔖 AI ハイライトノート

動画からタイムスタンプ付きのハイライト片を自動抽出し、トピックごとにグループ化するこの処理もデフォルトモデル経由です。以前に別のモデルでハイライトノートを作った動画があれば、いま V4 でもう一度生成してみてください — 「どれがハイライトとして選ばれるか」「トピックがどう分類されるか」を横並びで比べれば、ご自身のコンテンツでの差が一番わかりやすいはずです。

AI ハイライトノート:動画からハイライト片を自動抽出し分類

AI ハイライトノート:動画からハイライト片を自動抽出し分類

上記 3 つはいずれも私たち自身がまだ V4 の実力を体験中の領域です。コンテンツ、プロンプト、言語によって結果は変わり得るので、最も信頼できる結論は、皆さんが自分の業務フローで何度か回した後に下すものになるかと思います。

なお、映像コンテンツ解析はビジョンモデル専用、動画→イラスト付き記事は固定パイプラインを使っており、デフォルトモデルの切り替えの影響を受けません。この 2 つは今回の比較対象には含まれません。

BibiGPTはこれまでに 100 万人以上のユーザー にサービスを提供し、500 万件以上の AI 要約 を生成してきました。この規模のおかげで、新しいモデルが登場するたびにベンチマーク比較に留まらず、素早く実使用シナリオへ対応付けることができます。

AI 時代、本当に希少なのはモデルではなくコンテンツ消費速度

2026 年の AI モデルは水道水のようなインフラ。DeepSeek V4、Gemini 3.1 Pro、Claude Opus 4.6 — 誰でも呼び出せます。モデルはもはや希少資源ではありません。

では何が希少?情報を意見に、意見を行動に変える速度です。

音声と動画はインターネットで最も密度が低く、最も時間のかかるフォーマットです。2 時間のインタビューの文字起こしが 8,000 字でも、本論は 300 字かもしれません。30 時間のポッドキャストシーズンから長く残る引用は 20 本ほど。過去は 1.5 倍速・2 倍速の再生しか手がなく、注意力を密度と交換する方式でした。新世代モデルの登場で、この方程式を解き直せるようになりました:

- 受動的聴取の代わりに、気になることだけ質問 — モデルが字幕から答えを取り出す

- 最後まで見てから判断の代わりに、要約を先に読む — 時間を割く価値があるかを先に決定

- 動画を 1 本ずつ送る代わりに、全体から検索 — 「登録中の 100 人の中で、誰がこのテーマを扱った?」

BibiGPTがやっていることは 1 つだけです:最強のモデルを、最も消費しにくい大きなフォーマット(音声・動画)に差し込む。誰もが毎日 2 時間の動画を 15 分の高密度読書に圧縮できるように。DeepSeek V4 はこのスタックに信頼できる選択肢を一つ加えてくれました。

よくある質問(FAQ)

Q1: DeepSeek V4 Pro と V4 Pro Thinking の違いは?

核心は推論を明示的に見せるかどうか。非思考モードはレイテンシ低・出力短で、きれいな要約向き。思考モードは推論チェーンを先に書くので、多段ロジック、章間比較、論証分析に有利。reasoning_effort=high/max で深さを調整可能 — 大きいほど遅いが深く。

Q2: V4 Pro と V4 Flash、どちらを選ぶ?

「長さ × 推論複雑度」で判断してください。1 時間超または多段推論が必要 → Pro。30 分以下できれいな要約で十分 → Flash。迷ったら Flash を先に試し、物足りなければ Pro で再実行。BibiGPTは原本字幕をキャッシュするので、再要約で文字起こしステップを再度回さずに済みます。

Q3: なぜ DeepSeek 公式サイトではなくBibiGPT経由?

DeepSeek 公式サイトは汎用チャットボックスで、動画ダウンロード・文字起こし・貼り付け・プロンプトをすべて自前で対応する必要があります。BibiGPTは上流パイプライン(30 以上のプラットフォーム解析、文字起こし、視覚解析、タイムスタンプ整合)をすでに処理しており、DeepSeek V4 は最後の一区間 — 理解と生成 — のみを担います。同じ入力で、マインドマップ・ハイライトノート・イラスト付き記事・構造化エクスポートまで追加の組み立てなしで得られます。

Q4: DeepSeek V4 はどれくらい長い動画を扱える?

V4 Pro と Flash はどちらも 1M トークン・コンテキストで、日本語換算で約 150 万字、会話換算で 20 時間以上 — ポッドキャスト 1 シーズン相当です。BibiGPTはモデルの実効コンテキストに応じて、一括要約と分割後再統合を自動で判断します。

Q5: DeepSeek V4 の重みはオープンソース?

完全オープンソースです。重みは Hugging Face deepseek-ai/deepseek-v4 と ModelScope にあり、テクニカルレポートは DeepSeek_V4.pdf で直接閲覧できます。研究者やセルフホスト利用者は必要に応じてダウンロードしてください。

今すぐ V4 を試してみる

V4 を最も直接的に体感する方法:最近じっくり見たいと思っていた長尺動画を一つ選んでみてください — 講演、ポッドキャスト、ドキュメンタリーなど何でも OK — DeepSeek V4 Pro Thinking で一度走らせてみれば、ご自身が本当に関心のあるコンテンツで V4 がどう振る舞うかが一番直接的にわかります。

今すぐAI効率的な学習の旅を始めましょう:

- 🌐 公式ウェブサイト: https://aitodo.co

- 📱 モバイルダウンロード: https://aitodo.co/app

- 💻 デスクトップダウンロード: https://aitodo.co/download/desktop

- ✨ より多くの機能を学ぶ: https://aitodo.co/features

BibiGPT チーム