AI動画ノート効率学習法:動画視聴から知識定着までBibiGPT完全ワークフロー

動画をたくさん見ても覚えられない?BibiGPTは動画から知識定着までの完全なAI学習ワークフローを提供:字幕自動抽出、AI構造化ノート、マインドマップ、コアインサイトのハイライト、NotionやObsidianへのエクスポートまで5ステップで効率的な動画学習を実現します。

AI動画ノート効率学習法:動画視聴から知識定着までBibiGPT完全ワークフロー

目次

- 課題:なぜ100時間の動画視聴で何も覚えられないのか?

- 5ステップワークフロー:動画から知識定着までの完全な道筋

- 学習方法論との融合:AIワークフローをさらに効果的に

- 4つの実践シナリオ:様々なユーザーの活用法

- よくある質問(FAQ)

- まとめ:AIワークフローで動画学習を再定義する

課題:なぜ100時間の動画視聴で何も覚えられないのか?

こんな経験はありませんか:週末を丸ごと使ってCourseraの講座30本を一気見し、「たくさん学んだ」と感じたのに、月曜の朝出社すると頭の中が真っ白 — 重要な概念がぼんやりし、論点間の論理的なつながりが途切れ、どの動画で何を扱っていたか完全に混同してしまっている。

これは記憶力の問題ではありません。**受動的な視聴はそもそも効果的な学習方法ではないのです。**認知科学の研究によれば、受動的な動画視聴の知識保持率はわずか5%-10%ですが、ノート作成、マインドマップ、能動的想起などを組み合わせると保持率を50%-90%まで高めることができます。

問題は手動でのノート作成が遅すぎることです。60分の動画に20分のノート時間が必要です。マインドマップを手動で描くとさらに時間がかかり、重要な情報を見落とす可能性も高くなります。

BibiGPTのソリューション:「動画視聴」から「知識定着」までの完全なAIワークフローを提供します。字幕抽出、AI構造化ノート、マインドマップ生成、コアインサイトのハイライト、ノートエクスポートの5つの工程をカバーし、数時間かかっていた手動ノート作成を数分に圧縮しながら、ノート品質は手書きノートをはるかに上回ります。

See BibiGPT's AI Summary in Action

松尾豊教授に聞く、生成AIの「次の10年」

PIVOTのロングインタビュー。LLMの進化軸、ソブリンLLM、ロボティクス、そして三つの言葉について松尾豊教授が語る。

Want to summarize your own videos?

BibiGPT supports YouTube, Bilibili, TikTok and 30+ platforms with one-click AI summaries

Try BibiGPT Free5ステップワークフロー:動画から知識定着までの完全な道筋

100万+ユーザーと500万+AI要約生成の実戦検証を経たBibiGPTの5ステップ動画学習ワークフローです。

ステップ1:動画リンクを貼り付けて字幕を自動抽出

BibiGPTを開き、入力フィールドに動画リンクを貼り付けます。BibiGPTは30+プラットフォームに対応 — YouTube、Bilibili、TikTok、ポッドキャスト(Apple Podcasts、Spotify)、TED、Courseraなど。ローカルの音声・動画ファイルを直接アップロードすることもできます。

リンクを貼り付けるとBibiGPTが自動的に:

- プラットフォームと動画形式を識別:手動選択不要、システムが自動判定

- 完全な字幕テキストを抽出:タイムスタンプ付き、多言語字幕対応

- 字幕なし動画の処理:内蔵字幕のない動画は高度なAI音声テキスト変換技術で非常に高い精度で処理

このステップが解決する核心的な問題:動画コンテンツを検索可能で処理可能なテキストに変換すること。多くの学習者が動画をテキストに変換することがすべての深層学習ワークフローの出発点であることに気づいていません。

ステップ2:AI要約で構造化ノートを生成

字幕抽出が完了するとBibiGPTの高度なAIが全コンテンツを深層分析し、構造化されたAIノートを生成します。単純な「要約」ではなく、手動ノートを本当に置き換えられる構造化された知識ドキュメントです:

- 核心論点の抽出:数千語の字幕から3-5個の核心論点を正確に特定

- 論理構造の復元:話者・講師の論理の流れに沿ってコンテンツを整理(機械的な切り取りではなく)

- 重要データ・事例の標記:数字、ケーススタディ、引用などの高価値情報が漏れない

- タイムスタンプ付きキーポイント参照:すべてのキーポイントが元動画の正確な時間位置にリンク

学習者にとってこれは、60分の動画のすべての核心内容を2分で把握し、特定のチャプターを深く視聴するか決定できるということです。これが効率的学習の第一歩です。

AIが学習方法をどう向上させるかについて詳しく知りたい方は、AIオーディオビデオ要約学習効率ガイドをご参照ください。

ステップ3:マインドマップ — 動画の知識構造を視覚的に俯瞰

構造化ノートの後、BibiGPTが対応するマインドマップを自動生成します。これは線形的な動画コンテンツを空間的な知識構造に変換する重要なステップです。

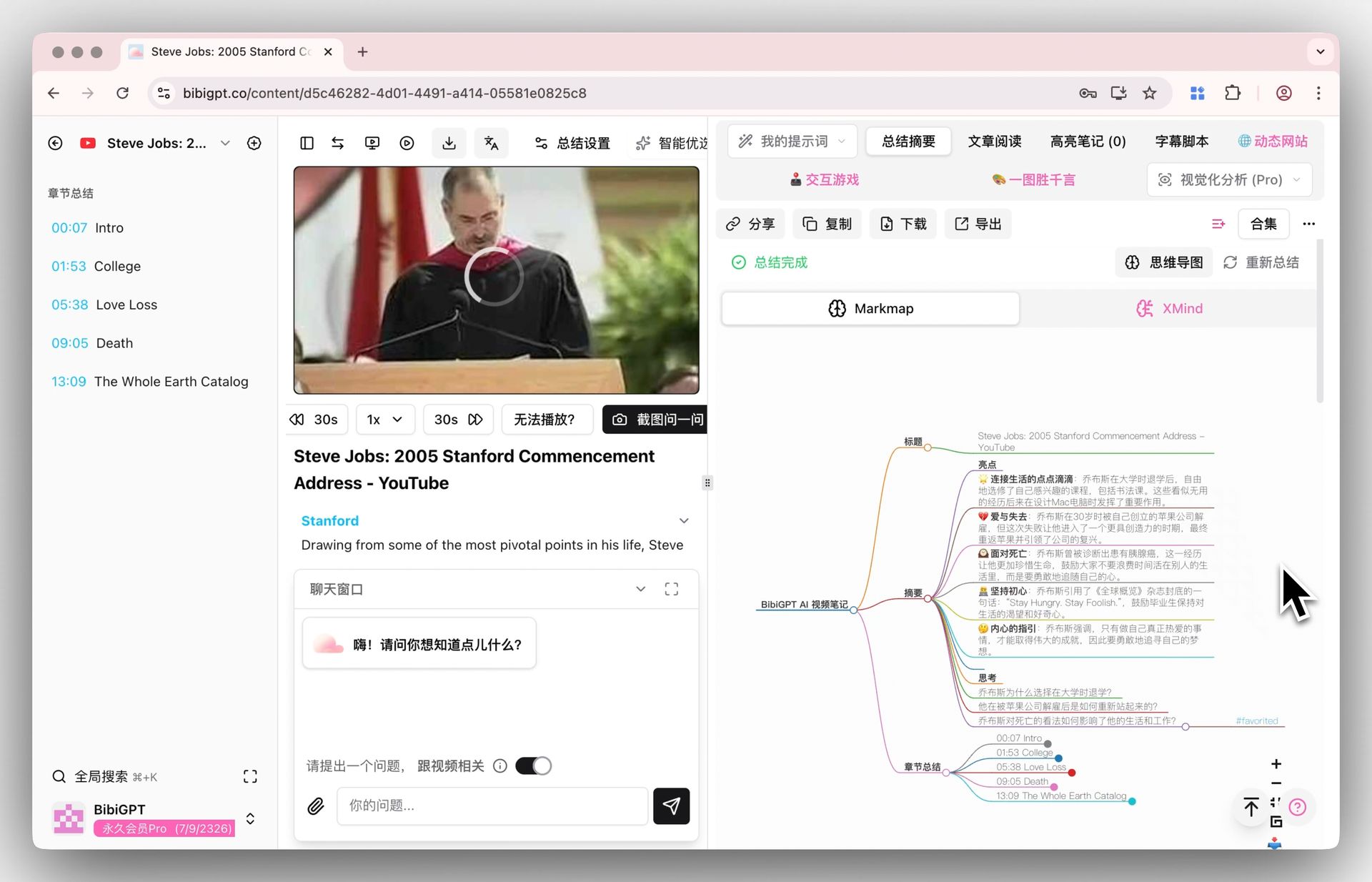

マインドマップ表示

マインドマップ表示

マインドマップの学習的価値:

- 全体的な視点:1つのマップで動画全体の知識構造を把握 — 細部に迷わない

- 関係の可視化:概念間の階層的・関連的な関係が一目瞭然

- 記憶のアンカー:視覚的な構造はプレーンテキストより脳がエンコード・記憶しやすい

- 効率的な復習:試験や会議前にマインドマップをざっと見るだけで3分で全記憶を復元

AI Mind Map Preview

松尾豊教授に聞く、生成AIの「次の10年」

PIVOTのロングインタビュー。LLMの進化軸、ソブリンLLM、ロボティクス、そして三つの言葉について松尾豊教授が語る。

Want to summarize your own videos?

BibiGPT supports YouTube, Bilibili, TikTok and 30+ platforms with one-click AI summaries

Try BibiGPT Freeマインドマップはノードの展開/折りたたみ、ズーム、画像またはMarkdown形式でのエクスポートに対応しています。ノートに直接スクリーンショットを貼り付けたり、エクスポート後に二次編集が可能です。

ステップ4:AIハイライトノート — コアインサイトの抽出

AI要約とマインドマップを基にBibiGPTのAIハイライトノート機能がコアインサイトをさらに精製します:

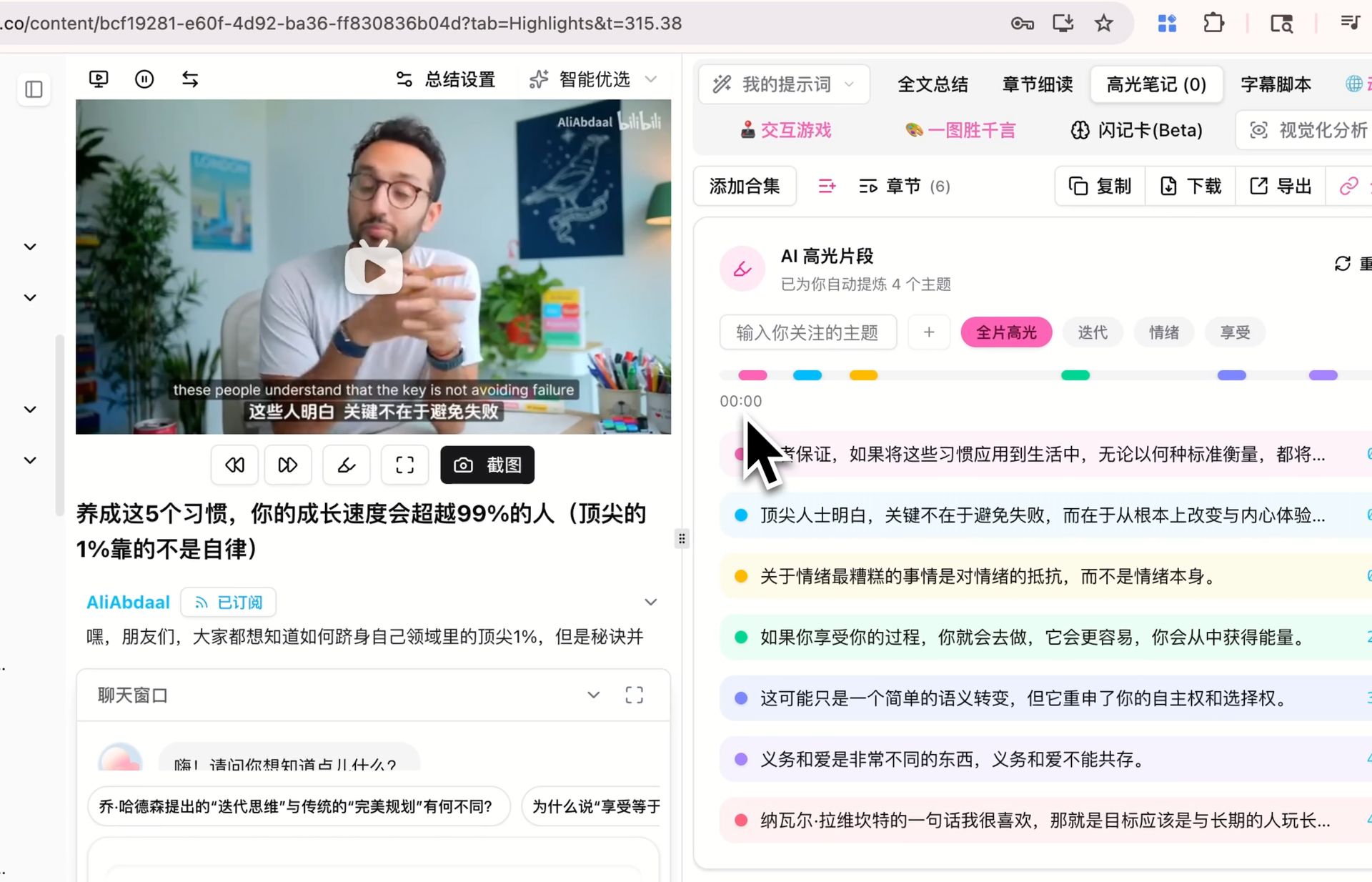

AIハイライトノートデモ

AIハイライトノートデモ

AIハイライトノートのユニークな価値:

- インサイトレベルの精製:段落要約ではなく、各コアインサイトの精密な抽出

- 重要度マーキング:高度なAIが各ポイントの重要度を自動判定し、異なるハイライトレベルで区別

- コンテキスト保持:各ハイライトインサイトに十分なコンテキストが保持され、過度な圧縮による意味の損失がない

- 追跡可能な引用:ハイライト箇所をクリックすると動画の対応するタイムスタンプにジャンプ

このステップは「情報」から「インサイト」への飛躍を完成させます。手元にあるのはもはや長いノートではなく、精製された即座に実行可能なナレッジチェックリストです。

ステップ5:NotionとObsidianにエクスポート — 個人ナレッジベースの構築

最後のステップは処理済みコンテンツをナレッジ管理システムにエクスポートし、これらのノートを長期記憶システムに統合することです。BibiGPTは複数のエクスポート方法をサポートしています:

- Notion同期:AI要約、ハイライトノート、マインドマップをNotionワークスペースにワンクリック同期、完璧なフォーマットのページを自動作成

- Obsidianエクスポート:Markdown形式でエクスポートし、Obsidian vaultに直接配置、双方向リンクノートシステムとシームレスに接続

- その他の形式:Markdown、JSON、ZIPバンドルエクスポートに対応、あらゆるノートツールと互換

BibiGPTとNotionの深い統合についてはNotion統合完全ガイドをご参照ください。Obsidianユーザーの方にはObsidian統合ガイドをおすすめします。

エクスポートは終わりではなく、知識定着の出発点です。動画ノートが日常ノート、読書ノート、仕事ノートと同じナレッジベースに集まると、分野横断的な知識の結びつきが自然に生まれます — これが真の深い学習です。

学習方法論との融合:AIワークフローをさらに効果的に

BibiGPTの5ステップワークフローは単なる技術ツールプロセスではありません。実証済みの学習方法論と自然に統合されます。最も効果的な3つの組み合わせをご紹介します:

アクティブリコール(能動的想起)

BibiGPTがAI要約を生成した後、すぐに読まないでください。まず動画で何を扱っていたか想起し、記憶から3-5個のキーポイントを書き出し、それからAI要約と比較します。この「まず想起、次に比較」のアプローチで知識保持率を2-3倍高めることができます。

実践方法:動画視聴 → 動画を閉じて記憶からキーポイントを列挙 → BibiGPT要約を開いて比較 → 漏れたポイントをマークして集中復習

間隔反復(Spaced Repetition)

BibiGPTのハイライトノートをエクスポートした後、1-3-7-14日の間隔で復習します。マインドマップは間隔復習に特に適しています — 各復習セッションで2分間マインドマップを閲覧し、記憶から詳細ノードの再構築を試みてください。

実践方法:ハイライトノートをNotionにエクスポート → 復習リマインダーを設定 → マインドマップでクイック想起テスト

ファインマン学習法(Feynman Technique)

BibiGPTのAI対話機能はファインマン学習法の完璧なパートナーです。動画とAI要約を読んだ後、AI対話で自分の言葉で核心内容を「説明」し、AIに理解のギャップや誤解を指摘してもらいましょう — 24時間対応の学習パートナーがいるようなものです。

実践方法:AI要約を読む → AI対話で自分の言葉で説明 → 「私の理解で抜けていることは?」と質問 → 反復して改善

ファインマン学習法とAIツールの組み合わせについて詳しくは、ファインマン学習法動画ナレッジ吸収ガイドをご参照ください。

4つの実践シナリオ:様々なユーザーの活用法

シナリオ1:オンライン講座学習

ユーザープロフィール:プログラミング、デザイン、金融などのスキルを学ぶ社会人または学生

課題:Udemyの講座に40本の講義動画があり、それぞれ30-60分。全部視聴するには30時間以上必要で、平日は不可能です。

BibiGPTワークフロー:

- 講座全体の動画リンクを一括貼り付け(再生リスト一括要約対応)

- 各講義のAI要約を先に読み、5分で講座全体のフレームワークを把握

- 本当に深く視聴する必要がある5-8本のコア講義をマーク

- コア講義のマインドマップとハイライトノートを生成

- Obsidianにエクスポートして講座ナレッジグラフを構築

結果:30時間の講座 → 2時間でコア知識 + 8時間で重要チャプターの深い学習。所要時間60%以上削減。

シナリオ2:カンファレンストーク・プレゼンテーション

ユーザープロフィール:業界動向を追跡する社会人、プロダクトマネージャー、アナリスト

課題:WWDC、Google I/Oなどの業界サミットの発表はそれぞれ2時間以上、カンファレンスあたり20以上のセッション。全部見るのは非現実的です。

BibiGPTワークフロー:

- 発表動画のURLを貼り付け

- AI要約を読んで自分の仕事に関連する核心トピックを素早く特定

- AI対話で具体的な技術的詳細や意思決定の背景を質問

- 重要な結論とアクションアイテムをチームのNotionナレッジベースにエクスポート

結果:20の発表のコア情報を1時間で把握。FOMOの終わり。

シナリオ3:ポッドキャスト深層学習

ユーザープロフィール:通勤中にポッドキャストを聴くナレッジワーカー、コンテンツクリエイター

課題:ポッドキャストは聴いている時は生産的に感じるが、コンテンツは聴いた後に消えてしまう。通勤中はノートが取れず、デスクに着いたら再度聴くのが面倒。

BibiGPTワークフロー:

- ポッドキャストリンクを貼り付け(Apple Podcasts、Spotify等対応)

- BibiGPTが自動文字起こしと構造化ノート生成

- インスピレーションを与えるインサイトをハイライトし、AI対話でさらに深掘り

- ノートをエクスポートし、既存のナレッジシステムと接続

結果:1時間の通勤ポッドキャスト → 降車後5分で完全なノート。「聴いて忘れる」の終わり。

シナリオ4:学術研究と文献レビュー

ユーザープロフィール:大学院生、博士課程、学術研究者

課題:YouTubeや学術プラットフォームに無数の講義や講座録画がある。引用、方法論、コア論証などの学術情報を抽出する必要がある。

BibiGPTワークフロー:

- 学術講義または講座録画のURLを貼り付け

- AI要約で方法論のフレームワークとコア論証を素早く把握

- ハイライトノートで引用可能な重要な記述やデータを抽出

- Obsidianにエクスポートし、文献ノートや研究ノートと統合

結果:10時間の学術動画 → 1時間の構造化ノート。文献レビューの効率が劇的に向上。

よくある質問(FAQ)

BibiGPTのAIノートの品質はどうですか?手動ノートの代わりになりますか?

BibiGPTは高度なAI技術を使って深層コンテンツ分析を行います。生成される構造化ノートは正確性と完全性の両面で、素早い手動ノートを一般的に上回ります。特にデータポイント、論証ロジック、構造的関係など見落としがちな情報の捕捉に強みがあります。AIノートを「高品質な下書き」として活用し、その上に個人的な理解と注釈を追加することをおすすめします — この組み合わせアプローチが最高の学習効果を生みます。

どの動画プラットフォームに対応していますか?ローカルファイルも処理できますか?

BibiGPTはYouTube、Bilibili、TikTok、TED、Coursera、ポッドキャストプラットフォームなど30+プラットフォームの動画・音声コンテンツに対応しています。ローカルの音声・動画ファイル(MP4、MP3、WAVなどの一般的な形式)の直接アップロードもサポートしているため、あらゆる動画ソースを処理できます。

マインドマップは編集・エクスポートできますか?

はい。BibiGPTが生成したマインドマップはオンラインでのノード展開/折りたたみやズームブラウジングに対応しています。マインドマップを画像またはMarkdown形式でエクスポートし、他のツールでさらに編集できます。エクスポートしたマインドマップファイルはXMind、MindNodeなどの専門マインドマップツールにインポートして編集を続けることができます。

まとめ:AIワークフローで動画学習を再定義する

動画コンテンツが爆発的に増加する2026年、学習のボトルネックはもはや「良い動画を見つけること」ではなく、「見すぎて覚えられず活用もできないこと」です。BibiGPTの5ステップAIワークフロー — 字幕抽出、ノート生成、マインドマップ構築、コアインサイトのハイライト、ナレッジベースへのエクスポート — は受動的な視聴から能動的な知識定着までの完全な道筋を構築します。

100万+ユーザーがすでにこのワークフローで学習効率を向上させています。プログラミングを学ぶにしても、資格試験の準備をするにしても、研究を行うにしても、業界動向を追跡するにしても、この方法論とツールの組み合わせがより少ない時間でより多くの知識を習得する助けになります。

今すぐAI効率的な学習の旅を始めましょう:

- 🌐 公式ウェブサイト: https://aitodo.co

- 📱 モバイルダウンロード: https://aitodo.co/app

- 💻 デスクトップダウンロード: https://aitodo.co/download/desktop

- ✨ より多くの機能を学ぶ: https://aitodo.co/features

BibiGPT Team