Microsofts eigener Voice-Stack: Was MAI-Voice-1 + MAI-Transcribe-1 für BibiGPT-Podcast-Zusammenfassungen bedeuten

Microsofts eigener Voice-Stack: Was MAI-Voice-1 + MAI-Transcribe-1 für BibiGPT-Podcast-Zusammenfassungen bedeuten

Inhalt

- Was ist MAI-Transcribe-1 und warum ist es für KI-Podcast-Transkription wichtig?

- MAI-Voice-1: 60 Sekunden Audio in 1 Sekunde

- MAI-Transcribe-1 vs Whisper / Voxtral: Drei zentrale Unterschiede

- Was es für BibiGPT-Nutzer bedeutet: Eine robustere Basis für Podcast-Zusammenfassungen

- Wie BibiGPT mit der MAI-Serie koexistiert

- FAQ

- Fazit

Was ist MAI-Transcribe-1 und warum ist es für KI-Podcast-Transkription wichtig?

Kurze Antwort: MAI-Transcribe-1 ist Microsofts hauseigenes ASR-Modell (automatische Spracherkennung), im April 2026 zusammen mit MAI-Voice-1 vorgestellt. Der unmittelbare Effekt auf KI-Podcast-Transkription: niedrigere Wortfehlerrate (WER) in mehrsprachigen und verrauschten Szenarien bei geringeren Inferenzkosten — nachgelagerte Tools wie KI-Podcast-Zusammenfasser können auf genaueren Transkripten zu niedrigeren Kosten aufbauen.

Am 2. April 2026 hat das MAI-Team von Microsoft (Microsoft AI) zwei hauseigene Sprachmodelle gleichzeitig veröffentlicht:

- MAI-Voice-1 — Text-zu-Sprache (TTS). 60 Sekunden Audio in 1 Sekunde auf einer einzelnen GPU.

- MAI-Transcribe-1 — automatische Spracherkennung (ASR). Neuer SOTA bei mehrsprachigen Benchmarks mit deutlich niedrigerer Latenz.

Zum ersten Mal hat Microsoft beide Enden seines Voice-Stacks durch eigene Modelle ersetzt, statt auf OpenAI Whisper oder Drittanbieter-TTS zu setzen. Das Signal ist klar: Foundation-Sprachmodelle treten in eine Ära „hauseigen + Ende-zu-Ende mit niedriger Latenz” ein, und langes Audio (Podcasts, Interviews, Meetings) profitiert am meisten.

MAI-Voice-1: 60 Sekunden Audio in 1 Sekunde

Kurze Antwort: MAI-Voice-1 ist Microsofts hauseigenes TTS-Modell. Microsoft gibt 60 Sekunden Audio in 1 Sekunde auf einer einzelnen GPU an — eines der schnellsten TTS-Modelle in Produktion. Es läuft bereits in Copilot Daily / Podcasts mit klaren Auswirkungen auf Echtzeit-Assistenten, Synchronisation mit niedriger Latenz und längere narrative Texte.

Highlights:

- 60× Echtzeit: 60 Sekunden Text → 1 Sekunde Audio-Ausgabe, ideal für lange Erzählungen

- Läuft auf einer einzelnen GPU, anders als viele TTS-Systeme, die einen Cluster benötigen

- Bereits in Produktion in Copilot Daily News und Podcast-Workflows

Implikation für „Lange Audio-Video-Zusammenfassung → Podcast”-Szenarien wie BibiGPT: Sowohl Eingangsseite (Podcast-Transkription) als auch Ausgangsseite (Erzeugung von Audio mit „zwei Hosts”) laufen jetzt mit deutlich niedrigerer Latenz. Die Podcast-Erzeugung von BibiGPT verwandelt jedes Video bereits in ein Zwei-Host-Gespräch; sobald schnelles TTS wie MAI-Voice-1 reift, wird „in Echtzeit zusammenfassen und erzählen” möglich.

MAI-Transcribe-1 vs Whisper / Voxtral: Drei zentrale Unterschiede

Kurze Antwort: Im Vergleich zu OpenAI Whisper-v3 und Mistral Voxtral hebt sich MAI-Transcribe-1 in drei Achsen ab: niedrigere WER (besonders in lauten Umgebungen und bei Fachterminologie), schnellere Inferenz und enge Azure- / Copilot-Integration. Kurzfristig bleibt Whisper der Open-Source-Standard; MAI-Transcribe-1 wird der neue Benchmark für kommerzielle APIs.

| Dimension | MAI-Transcribe-1 | OpenAI Whisper-v3 | Mistral Voxtral |

|---|---|---|---|

| Open Source | Nein (kommerzielle API) | Ja (MIT) | Ja (Apache 2.0) |

| Mehrsprachig | 25+ Sprachen, stabiles CJK | 99 Sprachen, schwächer im Long-Tail | EN + EU-zentriert |

| Lange Audios | Nativer Kontext von 60+ Min | Benötigt Chunking | Langer Kontext unterstützt |

| Latenz | Deutlich niedriger als Whisper | Mittel | Schnell |

| Bereitstellung | Azure-gehostet | Self-Host oder Cloud | Self-Host Open Source |

| Preisgestaltung | Pro Minute | Open Source (GPU bezahlen) | Open Source |

Laut Microsoft AIs Blog soll die MAI-Serie den Voice-Stack von Microsofts Full-Stack-KI (Search, Copilot, Office, Gaming, Bing) auf hauseigener Technologie konsolidieren. Für nachgelagerte Apps bedeutet das stabilere SLAs und klarere Modell-Versionierung.

Für ein Produkt wie BibiGPT — das nicht an ein einzelnes Sprachmodell gebunden ist — ist MAI-Transcribe-1 eine weitere Option im Pool der benutzerdefinierten Transkriptions-Engine, kein Ersatz.

Was es für BibiGPT-Nutzer bedeutet: Eine robustere Basis für Podcast-Zusammenfassungen

Kurze Antwort: Drei konkrete Gewinne für BibiGPT-Nutzer — genauere Transkription für Podcasts und lange Audios, reibungsloserer mehrsprachiger Untertitel-Übersetzungs-Workflow und ein reicherer Pool von benutzerdefinierten Transkriptions-Engines zur Auswahl.

Fall 1: Lange Podcast- / Interview-Audios

Lange Audios (>30 Min) sind Whispers Schwachstelle — Chunking verliert Kontext. MAI-Transcribe-1s nativer Long-Context-Support bedeutet, dass Spotify-Podcasts und Branchen-Interviews sauberer transkribieren. Vergleiche im KI-Podcast-Zusammenfassungs-Workflow-Leitfaden.

Fall 2: Grenzüberschreitender mehrsprachiger Inhalt

Nachrichten über Regionen hinweg, JP- / KR-Interviews, EN-CN zweisprachige Meetings — die mehrsprachige WER von MAI ist in gemischten Szenarien stabiler. Für Creator, die global gehen, oder grenzüberschreitende Forscher erhält die Kette Auto-Übersetzung beim Hochladen (erkennen → übersetzen) eine genauere ASR-Basis.

Fall 3: Fachbegriff-dichter Domain-Inhalt

Medizin, Recht, Finanzen, Technik — dichte Terminologie hat sich lange auf Spezialisten-Engines wie ElevenLabs Scribe gestützt. Das Hinzufügen von MAI-Transcribe-1 erweitert den Pool, sodass Nutzer die Balance aus Preis / Genauigkeit / Sprache wählen können, die am besten zu ihrem Inhalt passt.

Wie BibiGPT mit der MAI-Serie koexistiert

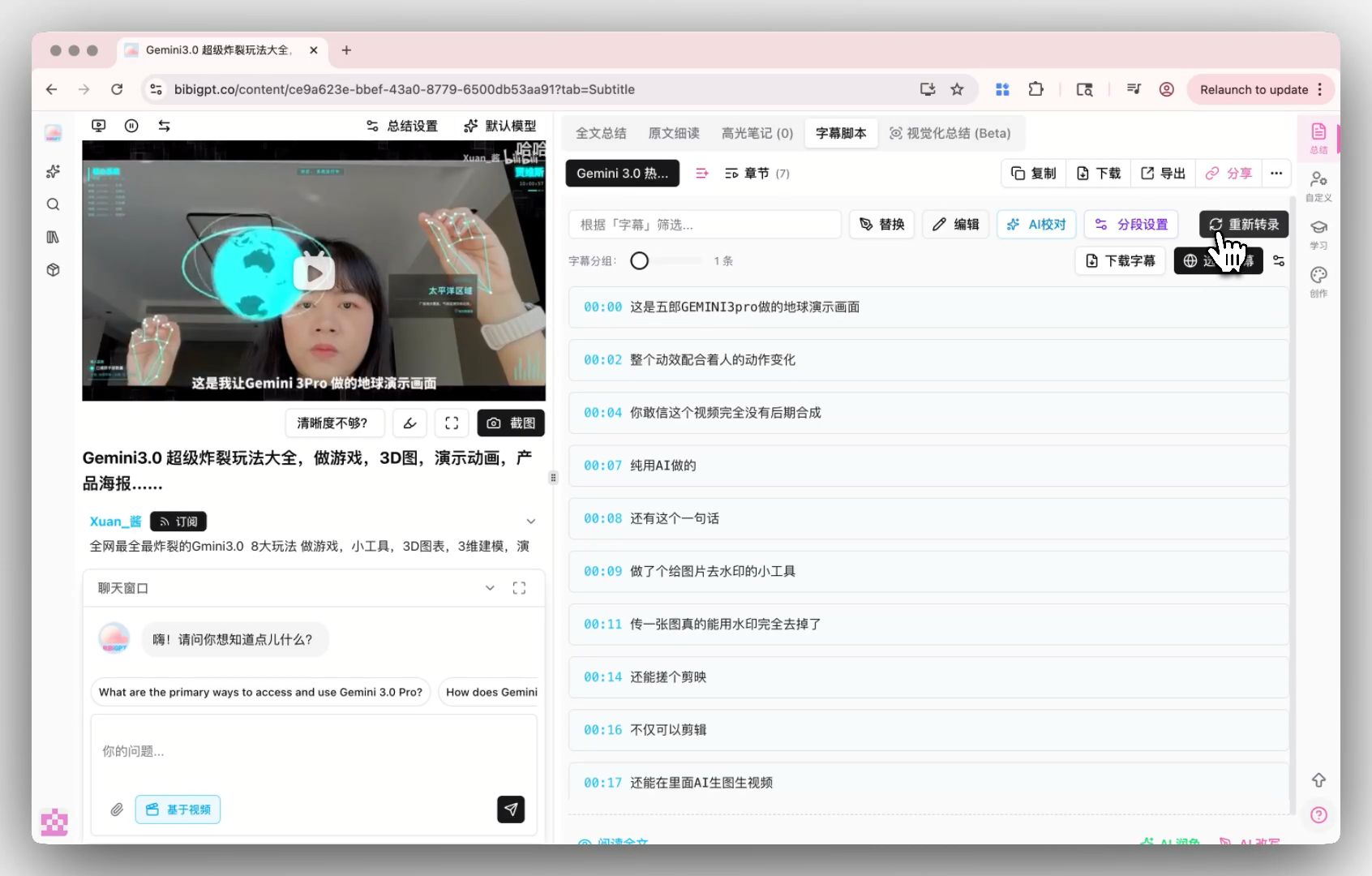

Kurze Antwort: BibiGPTs Positionierung war nie, auf ein einzelnes Sprachmodell zu setzen. MAI-Voice-1 / Transcribe-1 lassen den Kern-Workflow von BibiGPT (transkribieren → zusammenfassen → Mindmap → Artikel / Podcast) auf einer robusteren Basis laufen.

Kompatibilitätspfad: MAI-Transcribe-1 in die benutzerdefinierte Transkriptions-Engine einbinden

Die benutzerdefinierte Transkriptions-Engine von BibiGPT unterstützt heute OpenAI Whisper und das branchenführende ElevenLabs Scribe. MAI-Transcribe-1 ist derzeit nur Azure / Copilot; sobald öffentliche APIs reifen, wird BibiGPT die Aufnahme in den Pool prüfen, damit Nutzer Engines direkt im Untertitel-Editor wechseln können.

Ergänzungspfad: MAI als Basis, BibiGPT als Wissens-Artefakt-Schicht

Selbst mit dem besten ASR ist die Rohausgabe nur Text. Der einzigartige Wert von BibiGPT sitzt nachgelagert vom Transkript:

- Strukturierte Zusammenfassungen + Mindmaps — Aufschlüsselung langer Audios auf Kapitelebene

- KI-Highlight-Notizen — zeitstempelte Highlights mit einem Klick

- Sammlungs-Zusammenfassung — Synthese mehrerer Episoden in eine Wissenslandkarte

- Erzeugung von Zwei-Host-Podcasts — Zusammenfassung zurück in Audio verwandelt, schließt die Schleife „Podcast → Podcast”

Diese „Basis austauschen, Produktschicht behalten”-Architektur ist das, was BibiGPT erlaubt, die besten Sprachmodelle bei Erscheinen zu absorbieren. Vertiefende Lektüre: Microsoft Copilot vs BibiGPT Video-Zusammenfassung und die frühere Sichtweise zu MAI-Transcribe-1 vs Cohere Open-Source-ASR.

FAQ

Q1: Ist MAI-Transcribe-1 Open Source? Kann ich es selbst hosten?

A: Nein. MAI-Transcribe-1 ist derzeit ein kommerzielles Angebot über Azure / Copilot. Für Self-Hosting bleiben Sie bei OpenAI Whisper (MIT) oder Mistral Voxtral (Apache 2.0).

Q2: Verwendet BibiGPT MAI-Transcribe-1 standardmäßig?

A: Noch nicht. BibiGPT verwendet heute eine hauseigene + Whisper-Hybrid-Pipeline; Nutzer können in der benutzerdefinierten Transkriptions-Engine zu ElevenLabs Scribe wechseln. MAI-Transcribe-1 wird geprüft, sobald öffentliche APIs reifen.

Q3: Was bedeutet MAI-Voice-1 für Podcast-Creator?

A: Creator werden schließlich schnelles TTS wie MAI-Voice-1 nutzen können, um ein Transkript in Multi-Host-Audio umzuwandeln. Die Podcast-Erzeugung von BibiGPT verwandelt ein Video bereits in ein Zwei-Host-Gespräch; schnelleres TTS wird die Latenz weiter senken.

Q4: Wie viel besser ist MAI-Transcribe-1 als Whisper bei chinesischen Podcasts?

A: Öffentliche Benchmarks für Chinesisch sind begrenzt. Verwenden Sie BibiGPT, um Whisper vs ElevenLabs Scribe heute Seite an Seite zu testen; sobald MAI-Transcribe-1 öffnet, wird BibiGPT einen praxisnahen Vergleich veröffentlichen.

Q5: Warum nicht alle standardmäßig auf das stärkste Modell setzen?

A: Verschiedene Modelle wägen Kosten, Genauigkeit und Sprachabdeckung ab. Eine harte Bindung an ein einzelnes Modell würde Nutzern in Randfällen (seltene Sprachen, Fachterminologie) die Kontrolle nehmen. Die benutzerdefinierte Transkriptions-Engine gibt diese Wahl in die Hände der Nutzer zurück.

Fazit

Microsofts MAI-Voice-1 + MAI-Transcribe-1 markieren eine neue Phase für Foundation-Sprachmodelle: hauseigen und mit niedriger Ende-zu-Ende-Latenz. Für KI-Audio-Video-Tools ist das ein Upgrade des gesamten Stacks — genauere Transkription, schnellere Synthese, robustere lange Audios.

BibiGPTs Produktphilosophie war nie, sich an ein Sprachmodell zu binden — sondern jede starke Basis in nutzerorientierte Wissensartefakte zu verwandeln. Wenn MAI reift, wird BibiGPT es in den Pool der benutzerdefinierten Transkriptions-Engine aufnehmen und weiterhin die zuverlässigsten KI-Zusammenfassungen für Podcasts, grenzüberschreitende Videos und langes Lernen liefern.

Starten Sie jetzt Ihre KI-effiziente Lernreise:

- 🌐 Offizielle Website: https://bibigpt.co/de/desktop?utm_source=growth-pages&utm_medium=blog-inline-cta&utm_campaign=microsoft-mai-voice-1-mai-transcribe-1-bibigpt-2026

- 📱 Mobile-Download: https://aitodo.co/app

- 💻 Desktop-Download: https://aitodo.co/download/desktop

- ✨ Mehr Funktionen entdecken: https://aitodo.co/features

BibiGPT Team