La pile vocale propre de Microsoft : ce que MAI-Voice-1 + MAI-Transcribe-1 changent pour les résumés de podcasts BibiGPT

La pile vocale propre de Microsoft : ce que MAI-Voice-1 + MAI-Transcribe-1 changent pour les résumés de podcasts BibiGPT

Sommaire

- Qu’est-ce que MAI-Transcribe-1 et pourquoi est-il important pour la transcription de podcasts par IA ?

- MAI-Voice-1 : 60 secondes d’audio en 1 seconde

- MAI-Transcribe-1 vs Whisper / Voxtral : trois différences clés

- Ce que cela signifie pour les utilisateurs BibiGPT : une base plus solide pour les résumés de podcasts

- Comment BibiGPT prévoit de coexister avec la série MAI

- FAQ

- Conclusion

Qu’est-ce que MAI-Transcribe-1 et pourquoi est-il important pour la transcription de podcasts par IA ?

Réponse rapide : MAI-Transcribe-1 est le modèle ASR (reconnaissance vocale automatique) propriétaire de Microsoft, annoncé en avril 2026 aux côtés de MAI-Voice-1. Son effet immédiat sur la transcription de podcasts par IA est un taux d’erreur de mots (WER) plus faible dans les scénarios multilingues et bruyants, avec un coût d’inférence réduit — ainsi les outils en aval comme les résumeurs de podcasts par IA peuvent s’appuyer sur des transcriptions plus précises pour moins cher.

Le 2 avril 2026, l’équipe MAI (Microsoft AI) de Microsoft a livré deux modèles vocaux propriétaires d’un coup :

- MAI-Voice-1 — synthèse vocale (TTS). 60 secondes d’audio en 1 seconde sur un seul GPU.

- MAI-Transcribe-1 — reconnaissance vocale automatique (ASR). Nouveau SOTA sur les benchmarks multilingues avec une latence sensiblement plus faible.

C’est la première fois que Microsoft échange les deux extrémités de sa pile vocale pour des modèles internes au lieu de s’appuyer sur OpenAI Whisper ou des TTS tiers. Le signal est clair : les modèles vocaux fondamentaux entrent dans une ère « propriétaire + bout-en-bout à faible latence », et les contenus longs (podcasts, interviews, réunions) en bénéficieront le plus.

MAI-Voice-1 : 60 secondes d’audio en 1 seconde

Réponse rapide : MAI-Voice-1 est le modèle TTS propriétaire de Microsoft. Microsoft revendique 60 secondes d’audio en 1 seconde sur un seul GPU — parmi les modèles TTS les plus rapides en production. Il est déjà actif dans Copilot Daily / Podcasts, avec des implications claires pour les assistants temps réel, le doublage à faible latence et la narration de textes longs.

Points forts :

- 60× temps réel : 60 secondes de texte → 1 seconde de sortie audio, idéal pour la narration longue

- Tourne sur un seul GPU, contrairement à de nombreux systèmes TTS qui nécessitent un cluster

- Déjà en production dans les flux Copilot Daily News et Podcasts

Implication pour les scénarios « résumé long audio-vidéo → podcast » comme BibiGPT : tant le côté entrée (transcription de podcasts) que le côté sortie (génération d’audio « podcast à deux voix ») peuvent désormais fonctionner avec une latence bien plus faible. La génération de podcasts de BibiGPT transforme déjà n’importe quelle vidéo en conversation à deux voix ; à mesure que les TTS rapides comme MAI-Voice-1 mûrissent, « résumer en narrant » devient faisable en temps réel.

MAI-Transcribe-1 vs Whisper / Voxtral : trois différences clés

Réponse rapide : Comparé à OpenAI Whisper-v3 et Mistral Voxtral, MAI-Transcribe-1 se distingue sur trois axes : WER plus faible (surtout dans les environnements bruyants et sur le vocabulaire métier), inférence plus rapide, et intégration étroite à Azure / Copilot. À court terme, Whisper reste le défaut open source ; MAI-Transcribe-1 devient la nouvelle référence d’API commerciale.

| Dimension | MAI-Transcribe-1 | OpenAI Whisper-v3 | Mistral Voxtral |

|---|---|---|---|

| Open source | Non (API commerciale) | Oui (MIT) | Oui (Apache 2.0) |

| Multilingue | 25+ langues, CJK stable | 99 langues, plus faible sur la longue traîne | EN + centré UE |

| Audio long | Contexte natif 60+ min | Nécessite découpage | Long contexte pris en charge |

| Latence | Sensiblement plus faible que Whisper | Moyenne | Rapide |

| Déploiement | Hébergé sur Azure | Auto-hébergement ou cloud | Auto-hébergement open source |

| Tarification | À la minute | Open source (paiement GPU) | Open source |

Selon le blog de Microsoft AI, la série MAI vise à consolider la pile vocale de l’IA full-stack de Microsoft (Search, Copilot, Office, Gaming, Bing) sur des technologies propriétaires. Pour les applications en aval, cela se traduit par des SLA plus stables et un versionnage de modèles plus clair.

Pour un produit comme BibiGPT — qui ne se marie à aucun modèle vocal unique — MAI-Transcribe-1 est une option supplémentaire dans le pool moteur de transcription personnalisable, pas un remplacement.

Ce que cela signifie pour les utilisateurs BibiGPT : une base plus solide pour les résumés de podcasts

Réponse rapide : Trois gains concrets pour les utilisateurs BibiGPT — transcription plus précise pour les podcasts et l’audio long, flux de traduction de sous-titres multilingue plus fluide, et un pool plus riche de moteurs de transcription personnalisables au choix.

Cas 1 : podcast / interview audio long format

L’audio long (>30 min) est le point faible de Whisper — le découpage perd le contexte. Le support natif du long contexte de MAI-Transcribe-1 signifie que les podcasts Spotify et les interviews sectorielles se transcrivent plus proprement. Voir le guide du flux de résumé de podcasts par IA pour les comparaisons.

Cas 2 : contenu multilingue transfrontalier

Actualités entre régions, interviews JP / KR, réunions bilingues EN-CN — le WER multilingue de MAI est plus stable dans les scénarios mixtes. Pour les créateurs visant l’international ou les chercheurs transfrontaliers, la chaîne traduction automatique au téléversement (reconnaissance → traduction) obtient une base ASR plus précise.

Cas 3 : contenu métier dense en terminologie

Médical, juridique, financier, technique — la terminologie dense s’est longtemps appuyée sur des moteurs spécialisés comme ElevenLabs Scribe. Ajouter MAI-Transcribe-1 élargit le pool, donc les utilisateurs peuvent choisir l’équilibre prix / précision / langue qui convient le mieux à leur contenu.

Comment BibiGPT prévoit de coexister avec la série MAI

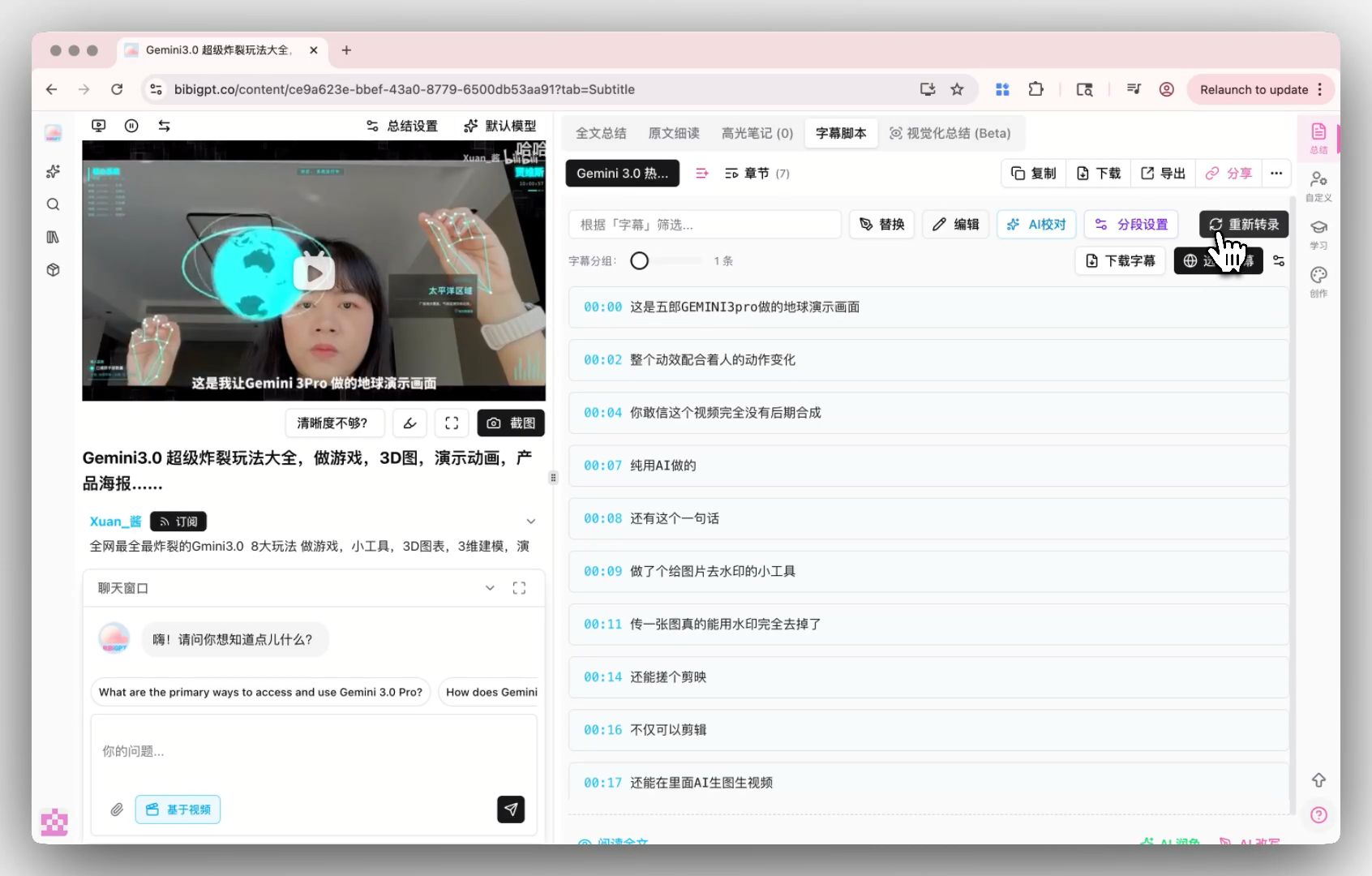

Réponse rapide : Le positionnement de BibiGPT n’a jamais été de parier sur un seul modèle vocal. MAI-Voice-1 / Transcribe-1 font fonctionner le flux central de BibiGPT (transcrire → résumer → carte mentale → article / podcast) sur une base plus solide.

Voie de compatibilité : brancher MAI-Transcribe-1 dans le moteur de transcription personnalisable

Le moteur de transcription personnalisable de BibiGPT prend aujourd’hui en charge OpenAI Whisper et le leader du secteur ElevenLabs Scribe. MAI-Transcribe-1 est actuellement réservé à Azure / Copilot ; une fois que les API publiques mûriront, BibiGPT évaluera son ajout au pool afin que les utilisateurs puissent changer de moteur directement depuis l’éditeur de sous-titres.

Voie complémentaire : MAI comme base, BibiGPT comme couche d’artefacts de connaissance

Même avec le meilleur ASR, la sortie brute reste du texte. La valeur unique de BibiGPT se situe en aval de la transcription :

- Résumés structurés + cartes mentales — découpage par chapitre des audios longs

- Notes de moments forts par IA — moments forts horodatés en un clic

- Résumé de collection — synthèse multi-épisodes en carte de connaissances

- Génération de podcast à deux voix — résumé reconverti en audio, fermant la boucle « podcast → podcast »

Cette architecture « échange la base, conserve la couche produit » est ce qui permet à BibiGPT d’absorber les meilleurs modèles vocaux dès leur apparition. Lectures plus poussées : Microsoft Copilot vs résumé vidéo BibiGPT et le précédent point de vue sur MAI-Transcribe-1 vs ASR open source Cohere.

FAQ

Q1 : MAI-Transcribe-1 est-il open source ? Puis-je l’auto-héberger ?

R : Non. MAI-Transcribe-1 est actuellement une offre commerciale via Azure / Copilot. Pour l’auto-hébergement, restez sur OpenAI Whisper (MIT) ou Mistral Voxtral (Apache 2.0).

Q2 : BibiGPT utilise-t-il MAI-Transcribe-1 par défaut ?

R : Pas encore. BibiGPT utilise aujourd’hui un pipeline hybride interne + Whisper ; les utilisateurs peuvent passer à ElevenLabs Scribe dans le moteur de transcription personnalisable. MAI-Transcribe-1 sera évalué une fois les API publiques matures.

Q3 : Que signifie MAI-Voice-1 pour les créateurs de podcasts ?

R : Les créateurs pourront finalement utiliser des TTS rapides comme MAI-Voice-1 pour transformer une transcription en audio multi-voix. La génération de podcasts de BibiGPT transforme déjà une vidéo en conversation à deux voix ; un TTS plus rapide réduira encore la latence.

Q4 : MAI-Transcribe-1 est-il vraiment meilleur que Whisper sur les podcasts chinois ?

R : Les benchmarks publics pour le chinois sont limités. Utilisez BibiGPT pour comparer Whisper et ElevenLabs Scribe côte à côte aujourd’hui ; une fois MAI-Transcribe-1 ouvert, BibiGPT publiera une comparaison pratique.

Q5 : Pourquoi ne pas mettre tout le monde sur le modèle le plus puissant par défaut ?

R : Différents modèles arbitrent entre coût, précision et couverture linguistique. Verrouiller un seul modèle priverait les utilisateurs de contrôle dans les cas limites (langues rares, vocabulaire métier). Le moteur de transcription personnalisable remet ce choix entre les mains de l’utilisateur.

Conclusion

MAI-Voice-1 + MAI-Transcribe-1 de Microsoft marquent une nouvelle phase pour les modèles vocaux fondamentaux : propriétaires et bout-en-bout à faible latence. Pour les outils audio-vidéo IA, c’est une mise à niveau de toute la pile — transcription plus précise, synthèse plus rapide, audio long plus solide.

La philosophie produit de BibiGPT n’a jamais été de verrouiller un seul modèle vocal — c’est de transformer toute base puissante en artefacts de connaissance pour l’utilisateur. Quand MAI mûrira, BibiGPT l’ajoutera au pool moteur de transcription personnalisable et continuera à livrer les résumés IA les plus fiables pour les podcasts, les vidéos transfrontalières et l’apprentissage long format.

Commencez votre voyage d’apprentissage efficace par IA dès maintenant :

- 🌐 Site officiel : https://bibigpt.co/fr/desktop?utm_source=growth-pages&utm_medium=blog-inline-cta&utm_campaign=microsoft-mai-voice-1-mai-transcribe-1-bibigpt-2026

- 📱 Téléchargement mobile : https://aitodo.co/app

- 💻 Téléchargement bureau : https://aitodo.co/download/desktop

- ✨ Découvrir plus de fonctionnalités : https://aitodo.co/features

BibiGPT Team