Lo stack vocale di Microsoft: cosa significano MAI-Voice-1 + MAI-Transcribe-1 per i riassunti dei podcast con BibiGPT

Lo stack vocale di Microsoft: cosa significano MAI-Voice-1 + MAI-Transcribe-1 per i riassunti dei podcast con BibiGPT

Indice

- Cos’è MAI-Transcribe-1 e perché è importante per la trascrizione di podcast con IA?

- MAI-Voice-1: 60 secondi di audio in 1 secondo

- MAI-Transcribe-1 vs Whisper / Voxtral: tre differenze chiave

- Cosa significa per gli utenti BibiGPT: una base più solida per i riassunti dei podcast

- Come BibiGPT prevede di coesistere con la serie MAI

- FAQ

- Conclusione

Cos’è MAI-Transcribe-1 e perché è importante per la trascrizione di podcast con IA?

Risposta rapida: MAI-Transcribe-1 è il modello ASR (riconoscimento vocale automatico) proprietario di Microsoft, annunciato ad aprile 2026 insieme a MAI-Voice-1. Il suo effetto immediato sulla trascrizione di podcast con IA è un tasso di errore (WER) più basso in scenari multilingua e rumorosi, con costi di inferenza inferiori — quindi strumenti a valle come i riassuntori di podcast con IA possono basarsi su trascrizioni più accurate spendendo meno.

Il 2 aprile 2026, il team MAI (Microsoft AI) ha rilasciato due modelli vocali proprietari contemporaneamente:

- MAI-Voice-1 — sintesi vocale (TTS). 60 secondi di audio in 1 secondo su una singola GPU.

- MAI-Transcribe-1 — riconoscimento vocale automatico (ASR). Nuovo SOTA su benchmark multilingua con latenza notevolmente inferiore.

È la prima volta che Microsoft sostituisce entrambe le estremità del proprio stack vocale con modelli interni invece di affidarsi a OpenAI Whisper o a TTS di terze parti. Il segnale è chiaro: i modelli vocali fondamentali stanno entrando in un’era “proprietaria + end-to-end a bassa latenza”, e i contenuti audio lunghi (podcast, interviste, riunioni) ne trarranno il maggior beneficio.

MAI-Voice-1: 60 secondi di audio in 1 secondo

Risposta rapida: MAI-Voice-1 è il modello TTS proprietario di Microsoft. Microsoft dichiara 60 secondi di audio in 1 secondo su una singola GPU — tra i modelli TTS più veloci in produzione. È già attivo all’interno di Copilot Daily / Podcasts, con implicazioni chiare per assistenti in tempo reale, doppiaggio a bassa latenza e narrazione di testi lunghi.

Punti salienti:

- 60× tempo reale: 60 secondi di testo → 1 secondo di audio in uscita, ideale per narrazioni lunghe

- Funziona su una singola GPU, a differenza di molti sistemi TTS che richiedono un cluster

- Già in produzione all’interno dei flussi di Copilot Daily News e Podcasts

Implicazione per scenari come BibiGPT “riassunto audio-video lungo → podcast”: sia il lato di ingresso (trascrizione del podcast) sia il lato di uscita (generazione di audio “podcast a due conduttori”) possono ora funzionare con una latenza molto inferiore. La generazione di podcast di BibiGPT trasforma già qualsiasi video in una conversazione tra due conduttori; man mano che TTS veloci come MAI-Voice-1 maturano, “riassumere mentre si narra” diventa fattibile in tempo reale.

MAI-Transcribe-1 vs Whisper / Voxtral: tre differenze chiave

Risposta rapida: Rispetto a OpenAI Whisper-v3 e Mistral Voxtral, MAI-Transcribe-1 si distingue su tre assi: WER inferiore (specialmente in ambienti rumorosi e su termini di dominio), inferenza più veloce e integrazione stretta con Azure / Copilot. A breve termine, Whisper resta il default open source; MAI-Transcribe-1 diventa il nuovo benchmark per le API commerciali.

| Dimensione | MAI-Transcribe-1 | OpenAI Whisper-v3 | Mistral Voxtral |

|---|---|---|---|

| Open source | No (API commerciale) | Sì (MIT) | Sì (Apache 2.0) |

| Multilingua | 25+ lingue, CJK stabile | 99 lingue, più debole sulle lingue di nicchia | EN + focus europeo |

| Audio lungo | Contesto nativo 60+ min | Richiede chunking | Contesto lungo supportato |

| Latenza | Significativamente inferiore a Whisper | Media | Veloce |

| Deployment | Hosted su Azure | Self-host o cloud | Self-host open source |

| Prezzo | Al minuto | Open source (paghi la GPU) | Open source |

Secondo il blog di Microsoft AI, la serie MAI è pensata per consolidare lo stack vocale dell’IA full-stack di Microsoft (Search, Copilot, Office, Gaming, Bing) su tecnologia proprietaria. Per le applicazioni a valle, ciò si traduce in SLA più stabili e versionamento dei modelli più chiaro.

Per un prodotto come BibiGPT — che non si lega a un singolo modello vocale — MAI-Transcribe-1 è un’opzione in più nel pool del motore di trascrizione personalizzabile, non un sostituto.

Cosa significa per gli utenti BibiGPT: una base più solida per i riassunti dei podcast

Risposta rapida: Tre vittorie concrete per gli utenti BibiGPT — trascrizione più accurata per podcast e audio lungo, flusso di traduzione dei sottotitoli multilingua più fluido, e un pool più ricco di motori di trascrizione personalizzabili tra cui scegliere.

Caso 1: podcast lunghi / audio di interviste

L’audio lungo (>30 min) è il punto debole di Whisper — il chunking perde il contesto. Il supporto al contesto lungo nativo di MAI-Transcribe-1 fa sì che i podcast Spotify e le interviste di settore vengano trascritti in modo più pulito. Vedi la guida al flusso di lavoro per il riassunto di podcast con IA per i confronti.

Caso 2: contenuti multilingua transfrontalieri

Notiziari di varie regioni, interviste JP / KR, riunioni bilingue EN-CN — il WER multilingua di MAI è più stabile in scenari misti. Per i creator che si espandono a livello globale o per i ricercatori transfrontalieri, la catena di traduzione automatica al caricamento (riconosci → traduci) ottiene una base ASR più accurata.

Caso 3: contenuti di dominio densi di terminologia

Medico, legale, finanziario, tecnico — la terminologia densa si è a lungo affidata a motori specialistici come ElevenLabs Scribe. L’aggiunta di MAI-Transcribe-1 amplia il pool, così gli utenti possono scegliere il bilanciamento tra prezzo / accuratezza / lingua più adatto ai propri contenuti.

Come BibiGPT prevede di coesistere con la serie MAI

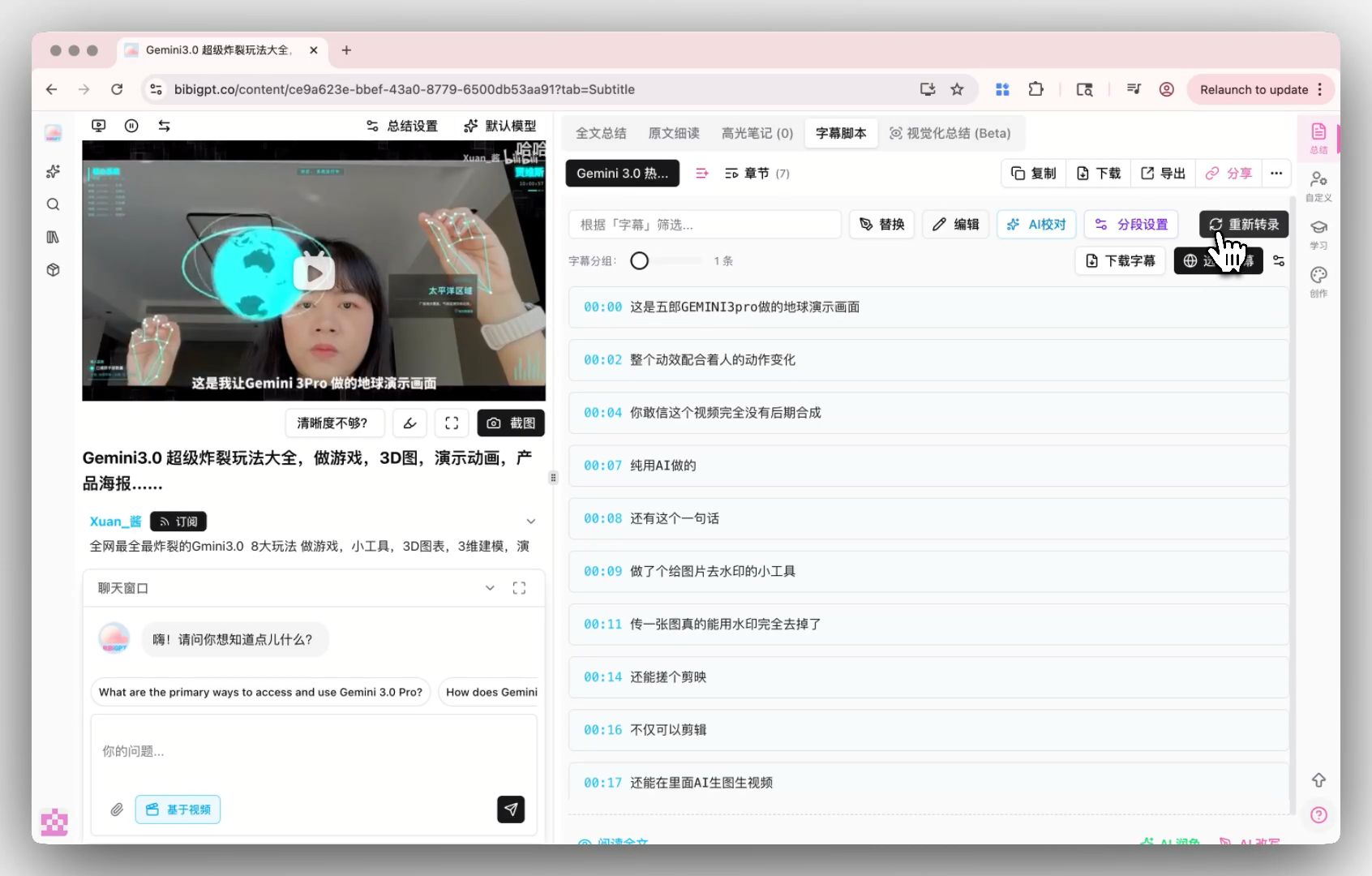

Risposta rapida: Il posizionamento di BibiGPT non è mai stato puntare su un singolo modello vocale. MAI-Voice-1 / Transcribe-1 fanno sì che il flusso centrale di BibiGPT (trascrivi → riassumi → mappa mentale → articolo / podcast) funzioni su una base più solida.

Percorso di compatibilità: collegare MAI-Transcribe-1 al motore di trascrizione personalizzabile

Il motore di trascrizione personalizzabile di BibiGPT supporta oggi OpenAI Whisper e l’ElevenLabs Scribe leader del settore. MAI-Transcribe-1 è attualmente solo Azure / Copilot; una volta che le API pubbliche maturano, BibiGPT valuterà se aggiungerlo al pool affinché gli utenti possano cambiare motore direttamente dall’editor dei sottotitoli.

Percorso complementare: MAI come base, BibiGPT come strato di artefatti di conoscenza

Anche con il miglior ASR, l’output grezzo è ancora solo testo. Il valore unico di BibiGPT si trova a valle della trascrizione:

- Riassunti strutturati + mappe mentali — suddivisione a livello di capitolo dell’audio lungo

- Note evidenziate con IA — punti salienti con timestamp con un solo clic

- Riassunto di raccolta — sintesi multi-episodio in una mappa di conoscenza

- Generazione di podcast a due conduttori — il riassunto trasformato di nuovo in audio, chiudendo il ciclo “podcast → podcast”

Questa architettura “scambia la base, mantieni lo strato di prodotto” è ciò che permette a BibiGPT di assorbire i migliori modelli vocali man mano che appaiono. Approfondimento: Microsoft Copilot vs riassunto video di BibiGPT e l’analisi precedente su MAI-Transcribe-1 vs ASR open source di Cohere.

FAQ

Q1: MAI-Transcribe-1 è open source? Posso fare self-host?

R: No. MAI-Transcribe-1 è attualmente un’offerta commerciale tramite Azure / Copilot. Per il self-hosting, attieniti a OpenAI Whisper (MIT) o Mistral Voxtral (Apache 2.0).

Q2: BibiGPT usa MAI-Transcribe-1 per impostazione predefinita?

R: Non ancora. Oggi BibiGPT usa una pipeline ibrida interna + Whisper; gli utenti possono passare a ElevenLabs Scribe nel motore di trascrizione personalizzabile. MAI-Transcribe-1 sarà valutato una volta che le API pubbliche maturano.

Q3: Cosa significa MAI-Voice-1 per i creator di podcast?

R: I creator potranno alla fine usare TTS veloci come MAI-Voice-1 per invertire una trascrizione in audio multi-conduttore. La generazione di podcast di BibiGPT trasforma già un video in una conversazione tra due conduttori; un TTS più veloce ridurrà ulteriormente la latenza.

Q4: Quanto è migliore MAI-Transcribe-1 rispetto a Whisper sui podcast cinesi?

R: I benchmark pubblici per il cinese sono limitati. Usa BibiGPT per confrontare oggi Whisper vs ElevenLabs Scribe fianco a fianco; una volta che MAI-Transcribe-1 si apre, BibiGPT pubblicherà un confronto pratico.

Q5: Perché non impostare per tutti il modello più potente come default?

R: Modelli diversi fanno trade-off tra costo, accuratezza e copertura linguistica. Vincolare rigidamente un singolo modello toglierebbe agli utenti il controllo nei casi limite (lingue rare, termini di dominio). Il motore di trascrizione personalizzabile rimette quella scelta nelle mani dell’utente.

Conclusione

MAI-Voice-1 + MAI-Transcribe-1 di Microsoft segnano una nuova fase per i modelli vocali fondamentali: proprietari ed end-to-end a bassa latenza. Per gli strumenti audio-video con IA, è un upgrade dell’intero stack — trascrizione più accurata, sintesi più veloce, audio lungo più solido.

La filosofia di prodotto di BibiGPT non è mai stata legarsi a un solo modello vocale — è trasformare qualsiasi base potente in artefatti di conoscenza per l’utente. Quando MAI maturerà, BibiGPT lo aggiungerà al pool del motore di trascrizione personalizzabile e continuerà a fornire i riassunti con IA più affidabili per podcast, video transfrontalieri e apprendimento di contenuti lunghi.

Inizia ora il tuo percorso di apprendimento efficiente con l’IA:

- 🌐 Sito ufficiale: https://bibigpt.co/it/desktop?utm_source=growth-pages&utm_medium=blog-inline-cta&utm_campaign=microsoft-mai-voice-1-mai-transcribe-1-bibigpt-2026

- 📱 Download mobile: https://aitodo.co/app

- 💻 Download desktop: https://aitodo.co/download/desktop

- ✨ Scopri altre funzionalità: https://aitodo.co/features

BibiGPT Team