Własny stos głosowy Microsoftu: co MAI-Voice-1 + MAI-Transcribe-1 oznaczają dla streszczeń podcastów BibiGPT

Własny stos głosowy Microsoftu: co MAI-Voice-1 + MAI-Transcribe-1 oznaczają dla streszczeń podcastów BibiGPT

Spis treści

- Czym jest MAI-Transcribe-1 i dlaczego ma znaczenie dla transkrypcji podcastów AI?

- MAI-Voice-1: 60 sekund audio w 1 sekundę

- MAI-Transcribe-1 vs Whisper / Voxtral: trzy kluczowe różnice

- Co to oznacza dla użytkowników BibiGPT: solidniejsza baza streszczeń podcastów

- Jak BibiGPT planuje współistnieć z serią MAI

- FAQ

- Podsumowanie

Czym jest MAI-Transcribe-1 i dlaczego ma znaczenie dla transkrypcji podcastów AI?

Szybka odpowiedź: MAI-Transcribe-1 to własny model ASR (automatycznego rozpoznawania mowy) Microsoftu, ogłoszony w kwietniu 2026 r. wraz z MAI-Voice-1. Jego natychmiastowy wpływ na transkrypcję podcastów AI to niższy współczynnik błędów słów (WER) w scenariuszach wielojęzycznych i głośnych, przy niższym koszcie inferencji — dzięki czemu narzędzia downstream, takie jak streszczenia podcastów AI, mogą bazować na dokładniejszych transkrypcjach za mniejsze pieniądze.

2 kwietnia 2026 r. zespół MAI (Microsoft AI) wypuścił jednocześnie dwa własne modele głosowe:

- MAI-Voice-1 — text-to-speech (TTS). 60 sekund audio w 1 sekundę na pojedynczym GPU.

- MAI-Transcribe-1 — automatyczne rozpoznawanie mowy (ASR). Nowy SOTA w benchmarkach wielojęzycznych przy znacząco niższej latencji.

To pierwszy raz, kiedy Microsoft wymienił oba końce swojego stosu głosowego na modele własne, zamiast polegać na OpenAI Whisper lub TTS firm trzecich. Sygnał jest jasny: fundamentalne modele głosowe wchodzą w erę “własne + niska latencja end-to-end”, a najwięcej skorzystają długie nagrania (podcasty, wywiady, spotkania).

MAI-Voice-1: 60 sekund audio w 1 sekundę

Szybka odpowiedź: MAI-Voice-1 to własny model TTS Microsoftu. Microsoft twierdzi, że generuje 60 sekund audio w 1 sekundę na pojedynczym GPU — wśród najszybszych modeli TTS w produkcji. Jest już aktywny w Copilot Daily / Podcasts, z wyraźnymi konsekwencjami dla asystentów czasu rzeczywistego, dubbingu o niskiej latencji i narracji długich tekstów.

Kluczowe punkty:

- 60× czasu rzeczywistego: 60 sekund tekstu → 1 sekunda wyjścia audio, idealne do narracji długich tekstów

- Działa na pojedynczym GPU, w przeciwieństwie do wielu systemów TTS wymagających klastra

- Już w produkcji w workflow Copilot Daily News i Podcasts

Implikacja dla scenariuszy “streszczenie długiego wideo-audio → podcast” jak BibiGPT: zarówno strona wejściowa (transkrypcja podcastu), jak i wyjściowa (generowanie audio “dwóch prowadzących”) mogą teraz działać z dużo niższą latencją. Generowanie podcastu BibiGPT już zamienia dowolne wideo w rozmowę dwóch prowadzących; gdy szybkie TTS jak MAI-Voice-1 dojrzeje, “streszczanie z jednoczesną narracją” stanie się wykonalne w czasie rzeczywistym.

MAI-Transcribe-1 vs Whisper / Voxtral: trzy kluczowe różnice

Szybka odpowiedź: W porównaniu z OpenAI Whisper-v3 i Mistral Voxtral, MAI-Transcribe-1 wyróżnia się trzema osiami: niższym WER (zwłaszcza w głośnych środowiskach i terminologii branżowej), szybszą inferencją oraz ścisłą integracją z Azure / Copilot. Krótkoterminowo Whisper pozostaje domyślną opcją open source; MAI-Transcribe-1 staje się nowym benchmarkiem komercyjnego API.

| Wymiar | MAI-Transcribe-1 | OpenAI Whisper-v3 | Mistral Voxtral |

|---|---|---|---|

| Open source | Nie (komercyjne API) | Tak (MIT) | Tak (Apache 2.0) |

| Wielojęzyczność | 25+ języków, stabilne CJK | 99 języków, słabsze w długim ogonie | EN + skupienie na UE |

| Długie audio | Natywny kontekst 60+ min | Wymaga dzielenia | Długi kontekst obsługiwany |

| Latencja | Znacząco niższa od Whisper | Średnia | Szybka |

| Wdrożenie | Hostowane w Azure | Self-host lub chmura | Self-host open source |

| Cennik | Za minutę | Open source (płatność za GPU) | Open source |

Według bloga Microsoft AI, seria MAI ma na celu konsolidację stosu głosowego w pełnym stosie AI Microsoftu (Search, Copilot, Office, Gaming, Bing) na technologii własnej. Dla aplikacji downstream przekłada się to na stabilniejsze SLA i jaśniejsze wersjonowanie modeli.

Dla produktu takiego jak BibiGPT — który nie wiąże się z żadnym pojedynczym modelem głosowym — MAI-Transcribe-1 to jeszcze jedna opcja w puli konfigurowalnego silnika transkrypcji, a nie zamiennik.

Co to oznacza dla użytkowników BibiGPT: solidniejsza baza streszczeń podcastów

Szybka odpowiedź: Trzy konkretne korzyści dla użytkowników BibiGPT — dokładniejsza transkrypcja podcastów i długiego audio, płynniejszy workflow tłumaczenia napisów wielojęzycznych oraz bogatsza pula konfigurowalnych silników transkrypcji do wyboru.

Przypadek 1: Długie podcasty / wywiady audio

Długie audio (>30 min) to słaby punkt Whispera — dzielenie traci kontekst. Natywna obsługa długiego kontekstu w MAI-Transcribe-1 oznacza, że podcasty Spotify i wywiady branżowe transkrybują się czyściej. Zobacz przewodnik po workflow streszczenia podcastów AI dla porównań.

Przypadek 2: Wielojęzyczne treści transgraniczne

Wiadomości z różnych regionów, wywiady JP / KR, dwujęzyczne spotkania EN-CN — WER MAI w warunkach mieszanych jest stabilniejsze. Dla twórców wchodzących na rynek globalny lub badaczy transgranicznych łańcuch auto-tłumaczenia przy wgraniu (rozpoznawanie → tłumaczenie) zyskuje dokładniejszą bazę ASR.

Przypadek 3: Treści branżowe nasycone terminologią

Medycyna, prawo, finanse, technika — gęsta terminologia od dawna polega na wyspecjalizowanych silnikach jak ElevenLabs Scribe. Dodanie MAI-Transcribe-1 poszerza pulę, więc użytkownicy mogą wybrać równowagę cena / dokładność / język najlepiej pasującą do ich treści.

Jak BibiGPT planuje współistnieć z serią MAI

Szybka odpowiedź: Pozycjonowanie BibiGPT nigdy nie polegało na stawianiu na jeden model głosowy. MAI-Voice-1 / Transcribe-1 sprawiają, że główny przepływ BibiGPT (transkrypcja → streszczenie → mapa myśli → artykuł / podcast) działa na solidniejszej bazie.

Ścieżka kompatybilności: podpięcie MAI-Transcribe-1 do konfigurowalnego silnika transkrypcji

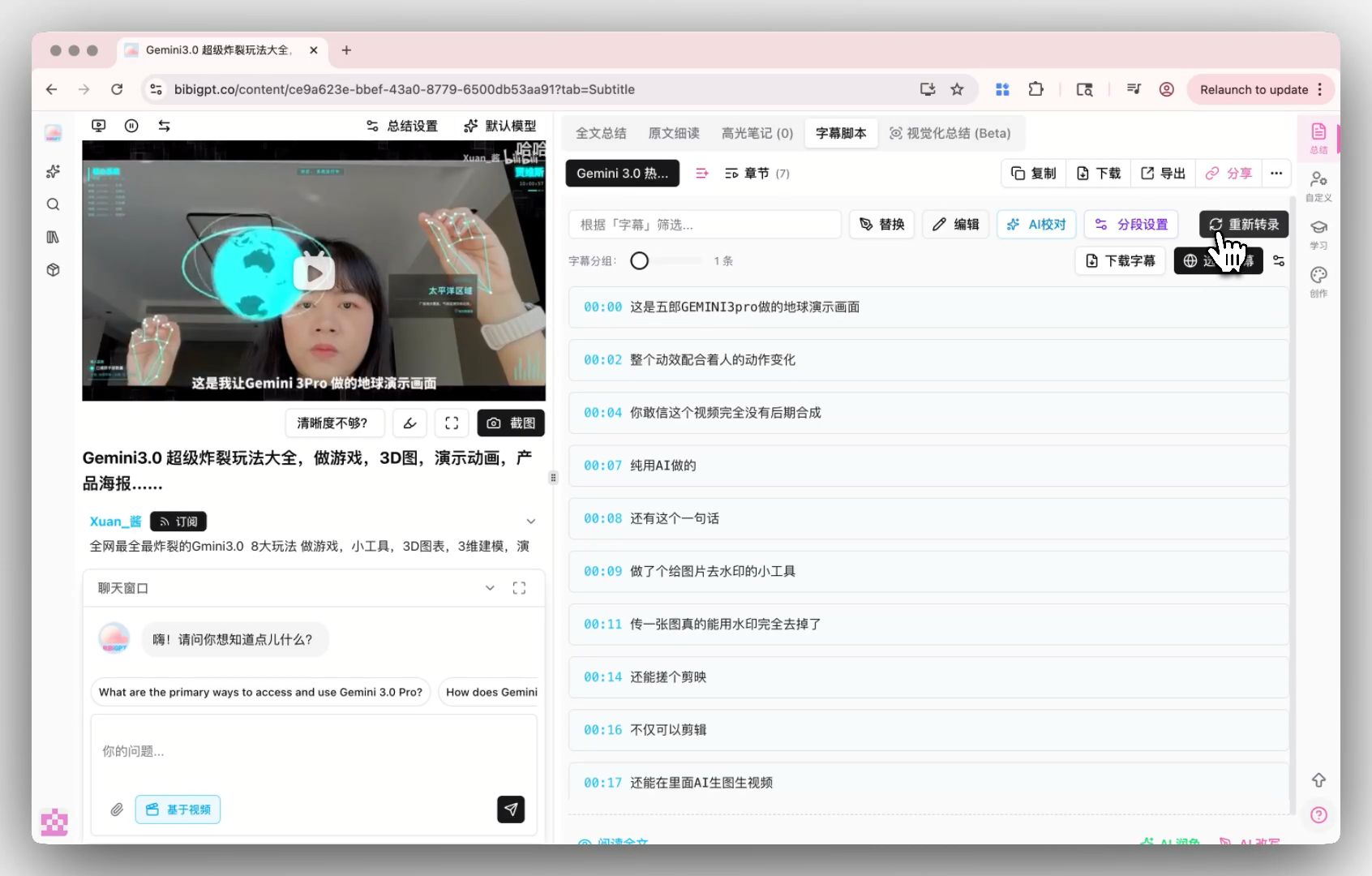

Konfigurowalny silnik transkrypcji BibiGPT obecnie obsługuje OpenAI Whisper i wiodący w branży ElevenLabs Scribe. MAI-Transcribe-1 jest obecnie dostępny tylko przez Azure / Copilot; gdy publiczne API dojrzeje, BibiGPT oceni dodanie go do puli, aby użytkownicy mogli przełączać silniki bezpośrednio z edytora napisów.

Ścieżka uzupełniająca: MAI jako baza, BibiGPT jako warstwa artefaktów wiedzy

Nawet z najlepszym ASR surowe wyjście to wciąż tylko tekst. Unikalna wartość BibiGPT leży za transkrypcją:

- Strukturalne streszczenia + mapy myśli — podział długiego audio na rozdziały

- Notatki AI z highlightami — najważniejsze momenty z timestampami jednym kliknięciem

- Streszczenie kolekcji — synteza wielu odcinków w mapę wiedzy

- Generowanie podcastu z dwoma prowadzącymi — streszczenie zamienione z powrotem w audio, zamykające pętlę “podcast → podcast”

Ta architektura “wymień bazę, zachowaj warstwę produktową” pozwala BibiGPT absorbować najlepsze modele głosowe w miarę ich pojawiania się. Pogłębione lektury: Microsoft Copilot vs streszczenie wideo BibiGPT oraz wcześniejsza analiza MAI-Transcribe-1 vs Cohere open-source ASR.

FAQ

P1: Czy MAI-Transcribe-1 jest open source? Czy mogę self-hostować?

O: Nie. MAI-Transcribe-1 to obecnie oferta komercyjna przez Azure / Copilot. Do self-hostingu pozostań przy OpenAI Whisper (MIT) lub Mistral Voxtral (Apache 2.0).

P2: Czy BibiGPT używa MAI-Transcribe-1 domyślnie?

O: Jeszcze nie. BibiGPT obecnie używa hybrydowego pipeline’u własnego + Whisper; użytkownicy mogą przełączyć się na ElevenLabs Scribe w konfigurowalnym silniku transkrypcji. MAI-Transcribe-1 zostanie oceniony, gdy publiczne API dojrzeje.

P3: Co MAI-Voice-1 oznacza dla twórców podcastów?

O: Twórcy w końcu będą mogli używać szybkiego TTS jak MAI-Voice-1 do odwracania transkrypcji w audio z wieloma prowadzącymi. Generowanie podcastu BibiGPT już zamienia wideo w rozmowę dwóch prowadzących; szybsze TTS jeszcze obniży latencję.

P4: O ile MAI-Transcribe-1 jest lepsze od Whisper na chińskich podcastach?

O: Publiczne benchmarki dla chińskiego są ograniczone. Użyj BibiGPT, aby uruchomić Whisper vs ElevenLabs Scribe równolegle dziś; gdy MAI-Transcribe-1 się otworzy, BibiGPT opublikuje praktyczne porównanie.

P5: Dlaczego nie ustawić wszystkich domyślnie na najsilniejszy model?

O: Różne modele balansują koszt, dokładność i pokrycie językowe. Twarde związanie z jednym modelem pozbawiłoby użytkowników kontroli w przypadkach brzegowych (rzadkie języki, terminologia branżowa). Konfigurowalny silnik transkrypcji zwraca ten wybór w ręce użytkownika.

Podsumowanie

MAI-Voice-1 + MAI-Transcribe-1 Microsoftu wyznaczają nową fazę dla fundamentalnych modeli głosowych: własne i end-to-end o niskiej latencji. Dla narzędzi audio-wideo AI to ulepszenie całego stosu — dokładniejsza transkrypcja, szybsza synteza, solidniejsze długie audio.

Filozofia produktowa BibiGPT nigdy nie polegała na zamykaniu się w jednym modelu głosowym — polega na zamienianiu dowolnej silnej bazy w artefakty wiedzy dla użytkownika. Gdy MAI dojrzeje, BibiGPT doda go do puli konfigurowalnego silnika transkrypcji i będzie nadal dostarczać najbardziej niezawodne streszczenia AI dla podcastów, transgranicznych wideo i nauki długich treści.

Rozpocznij swoją podróż efektywnej nauki z AI już teraz:

- 🌐 Strona oficjalna: https://bibigpt.co/pl/desktop?utm_source=growth-pages&utm_medium=blog-inline-cta&utm_campaign=microsoft-mai-voice-1-mai-transcribe-1-bibigpt-2026

- 📱 Pobierz aplikację mobilną: https://aitodo.co/app

- 💻 Pobierz aplikację desktop: https://aitodo.co/download/desktop

- ✨ Poznaj więcej funkcji: https://aitodo.co/features

BibiGPT Team