DeepSeek-V4 Hadir! BibiGPT Rilis Empat Model Baru + 1M Context di Hari Pertama — Ringkasan Video & Podcast AI Naik Level

DeepSeek-V4 Hadir! BibiGPT Rilis Empat Model Baru + 1M Context di Hari Pertama — Ringkasan Video & Podcast AI Naik Level

Hari ini (24 April 2026) DeepSeek-V4 Preview resmi diluncurkan dan menjadi sepenuhnya open-source — 1M context kini default, dan kemampuan agent telah menutup kesenjangan dengan Sonnet 4.5. BibiGPT telah menyelesaikan integrasi hari yang sama, dan DeepSeek V4 Pro, V4 Pro Thinking, V4 Flash, dan V4 Flash Thinking kini dapat dipilih langsung di model picker, siap untuk dokumenter sepanjang penuh, wawancara dua jam, atau seluruh musim podcast.

Kami menjalankan model melalui beberapa skenario nyata segera. Postingan ini adalah catatan hands-on yang dibagikan pada saat yang sama, untuk siapa pun yang bekerja dengan jenis konten yang sama.

Daftar Isi

- Apa yang baru di DeepSeek-V4

- Empat model DeepSeek V4 kini live di BibiGPT

- Beralih ke DeepSeek V4 dalam tiga langkah

- Hands-on: meringkas video peluncuran DeepSeek sendiri dengan V4 Pro

- Skenario di mana beralih ke V4 berlaku langsung

- Era AI: yang langka bukan model, melainkan seberapa cepat Anda mengonsumsi konten

- FAQ

Apa yang baru di DeepSeek-V4

DeepSeek-V4 menggerakkan tiga dial kunci sekaligus. Masing-masing pantas catatan terpisah.

Pertama, 1M context menjadi default di seluruh layanan resmi DeepSeek. Mekanisme attention baru mengompres sepanjang dimensi token dan menggabungkan dengan DSA (DeepSeek Sparse Attention) untuk memotong biaya memori dan compute. Secara praktis, mengumpan satu jam subtitle tidak lagi memerlukan rutinitas “chunk-and-stitch” — model membacanya sebagai satu badan kontinu.

Kedua, kemampuan agent mengambil langkah jelas ke atas. Menurut pengukuran DeepSeek sendiri, V4-Pro memimpin semua model open-source di Agentic Coding dan memberikan kualitas dekat Opus 4.6 non-thinking; mereka sudah menggunakannya sebagai model coding internal default. Untuk pengguna sehari-hari, ini diterjemahkan menjadi structuring teks panjang yang lebih andal — chaptering, ekstraksi poin kunci, generasi mindmap — dengan stabilitas yang nyata lebih baik.

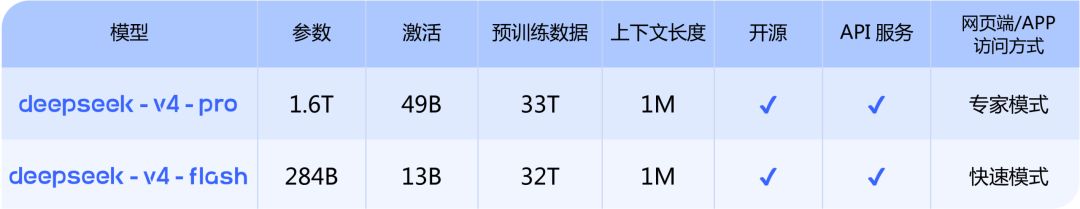

Ketiga, Pro dan Flash saling melengkapi. Pro (1.6T param / 49B aktif / 33T pre-training token) menargetkan model closed-source teratas; Flash (284B / 13B / 32T) adalah opsi cost-efficient. Keduanya mendukung mode thinking dan non-thinking, dan mode thinking mendukung tuning reasoning_effort. Flash untuk tugas sederhana, Pro untuk yang berat — keduanya terasa solid.

Pengumuman asli (dalam Mandarin) di sini: DeepSeek-V4 Preview: Era Million-Token Menjadi Mainstream. Bobot model tersedia di koleksi DeepSeek V4 Hugging Face (Pro / Pro-Base / Flash / Flash-Base, empat repo); laporan teknis di DeepSeek_V4.pdf.

Empat model DeepSeek V4 kini live di BibiGPT

Buka pengaturan ringkasan video atau audio mana pun, ketik deepseek di model picker, dan Anda akan melihat empat entri baru yang ditandai New:

| Model | Use case | Thinking |

|---|---|---|

| DeepSeek V4 Pro | Kualitas top untuk konten panjang dan berat logika | Non-thinking |

| DeepSeek V4 Pro Thinking | V4 Pro dengan reasoning eksplisit — agent dan analisis mendalam | Thinking |

| DeepSeek V4 Flash | Cost-efficient, bagus untuk konten pendek dan kasual | Non-thinking |

| DeepSeek V4 Flash Thinking | Flash dengan reasoning, menyeimbangkan kecepatan dan kedalaman | Thinking |

Mana yang dipilih? Aturan keputusan sederhana:

- Konten lebih panjang (lebih dari satu jam, musim podcast penuh, wawancara panjang) → Pro atau Pro Thinking untuk reasoning lebih dalam di seluruh karya

- Konten lebih pendek (di bawah 30 menit, rapat, vlog harian) → Flash, lebih cepat dan lebih ekonomis

- Ingin model bernalar selangkah demi selangkah, membandingkan sudut pandang, masuk lebih dalam → pilih varian Thinking

- Hanya butuh ringkasan bersih, tanpa jejak reasoning → pilih varian non-thinking

Jika Anda tidak ingin membandingkan dengan hati-hati, mulai dengan V4 Pro Thinking — ia memberikan hasil konsisten di sebagian besar skenario konten panjang.

Beralih ke DeepSeek V4 dalam tiga langkah

- Buka BibiGPT, tempel link YouTube / podcast / file lokal ke input box

- Klik Default Model di bawah input, ketik

deepseekdi search bar - Pilih salah satu dari empat entri New dan tekan tombol summarize

Pemilihan persisten lintas sesi. Power user dapat menyematkan V4 Pro Thinking sebagai default custom summary, sehingga setiap video mendatang berjalan melaluinya secara otomatis.

Ingin merasakan kualitas ringkasan BibiGPT sebelum mengubah model? Drop link apa pun ke widget di bawah:

Hands-on: meringkas video peluncuran DeepSeek sendiri dengan V4 Pro

Hal pertama yang kami lakukan adalah menjalankan V4 Pro pada video peluncuran DeepSeek sendiri. Ini sekitar satu setengah menit, dan dengan mode thinking aktif, model membaginya menjadi tujuh bab terstruktur, masing-masing dengan ringkasan, highlight, refleksi, dan critical review tersendiri.

Beberapa detail yang perlu disebutkan:

- Cakupan fakta penuh: kelima klaim utama dari rilis (1M context sebagai default, lompatan agent, lead world-knowledge, fleksibilitas dual-tier, kompatibilitas ekosistem agent) datang akurat, termasuk angka parameter

- Setiap kesimpulan dapat dilacak: setiap poin menautkan kembali ke timestamp video yang dapat diklik, melompat langsung ke momen yang relevan

- Pertanyaan follow-up muncul otomatis: di bawah ringkasan model menyarankan ekstensi seperti “apa perbedaan antara dua tier V4” dan “bagaimana saya memanggilnya melalui API,” siap untuk deep dive sekali tap

Peningkatan di sini terutama berasal dari reasoning lebih dalam mode thinking. Konteks panjang sudah merupakan jalur default di model utama BibiGPT, dan kedatangan V4 membawa kombinasi “reasoning mendalam + stabilitas full-transcript” itu ke tier open-source dengan kualitas first-rate.

Skenario di mana beralih ke V4 berlaku langsung

Model open-source terus turun. Anda dapat bertanya: tidak bisakah saya hanya menggunakan website DeepSeek atau API langsung? Mengapa rute melalui BibiGPT?

Itu turun ke skenario. Website DeepSeek adalah chatbox generik — Anda masih perlu mengunduh video, transkripsi, tempel, dan mencari tahu cara prompt. BibiGPT telah melakukan satu hal selama bertahun-tahun: membuat video dan podcast panjang semudah dikonsumsi sebagai membaca artikel. V4 adalah kemampuan terbaru yang ditambahkan ke stack itu; yang sebenarnya membuat “tempel link, dapatkan pemahaman nyata” bekerja adalah lapisan produk yang telah kami sempurnakan di sekitar model.

Di dalam BibiGPT, kemampuan berikut langsung mengikuti model yang Anda pilih sebagai “Default Model” Anda — dengan kata lain, setelah Anda beralih ke DeepSeek V4, fitur-fitur ini berjalan di V4.

📝 Ringkasan Video (Default + Custom Prompt)

Hal yang paling sering Anda gunakan — menekan “Summarize” setelah menempel link — berjalan pada model apa pun yang telah Anda pilih. Setiap prompt kustom tersimpan (hal-hal seperti “Counterintuitive Analyst”, “Critical Thinking”, atau “Investment Analyst”) melalui model yang sama juga. Beralih ke DeepSeek V4 Pro Thinking, jalankan ulang video yang sama dengan prompt yang sama, dan Anda mendapat perbandingan side-by-side langsung pada kedalaman reasoning dan struktur. Ini salah satu skenario yang masih kami eksplorasi sendiri — jalankan pada konten Anda sendiri dan lihat apakah hasilnya lebih cocok dengan ekspektasi Anda.

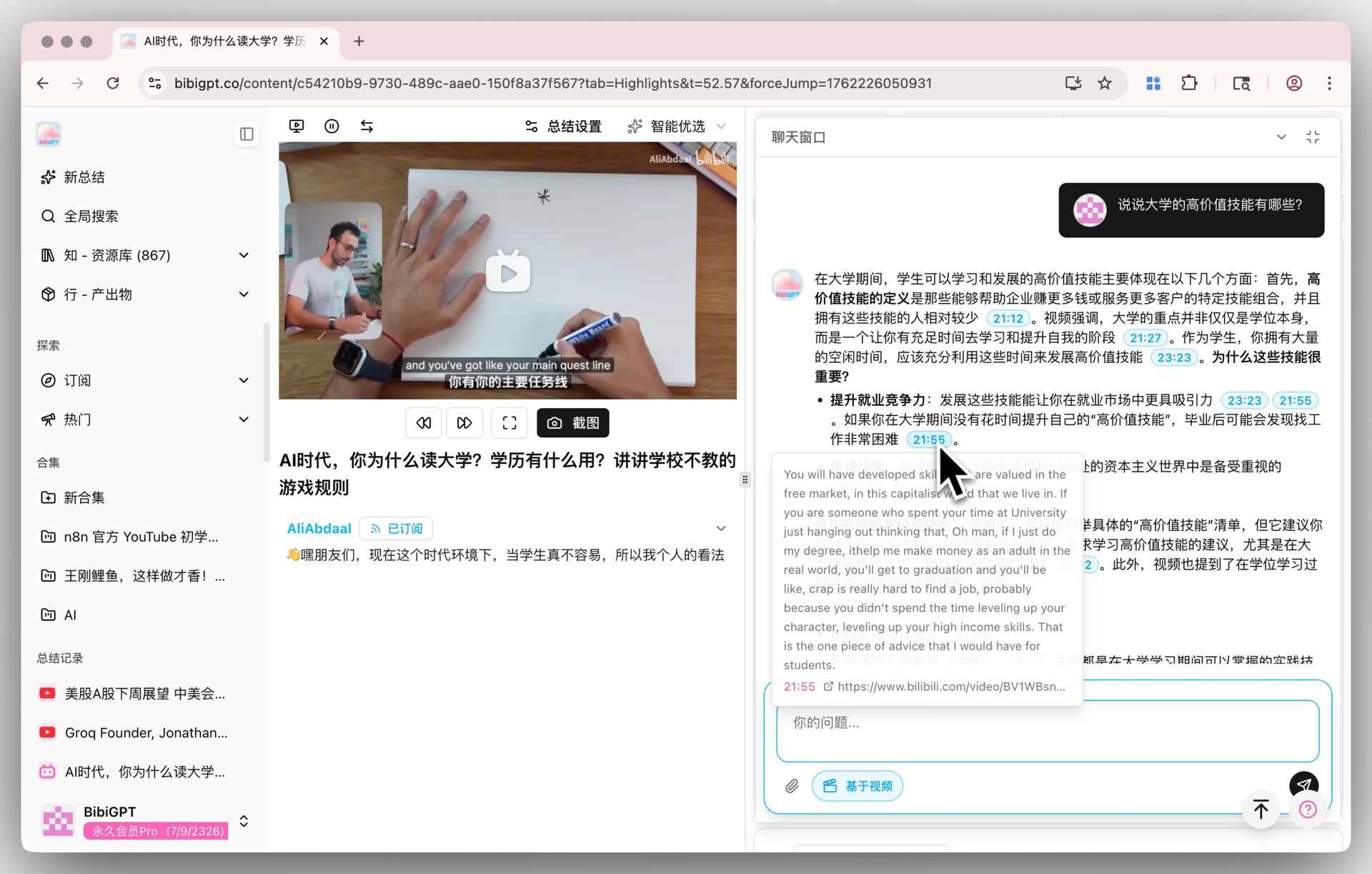

🎯 AI Video Chat dengan Source Tracing

Window chat di bawah halaman detail video juga mengikuti model default. Setiap jawaban membawa timestamp yang dapat diklik — “ia membuat poin sebaliknya pada 1:12:30”, sekali tap dan Anda melompat ke sana. Setelah Anda beralih ke V4, pilih wawancara 1+ jam dan ajukan beberapa putaran pertanyaan follow-up — ini skenario di mana perbedaan antar model cenderung muncul cepat, dan layak dijalankan secara langsung.

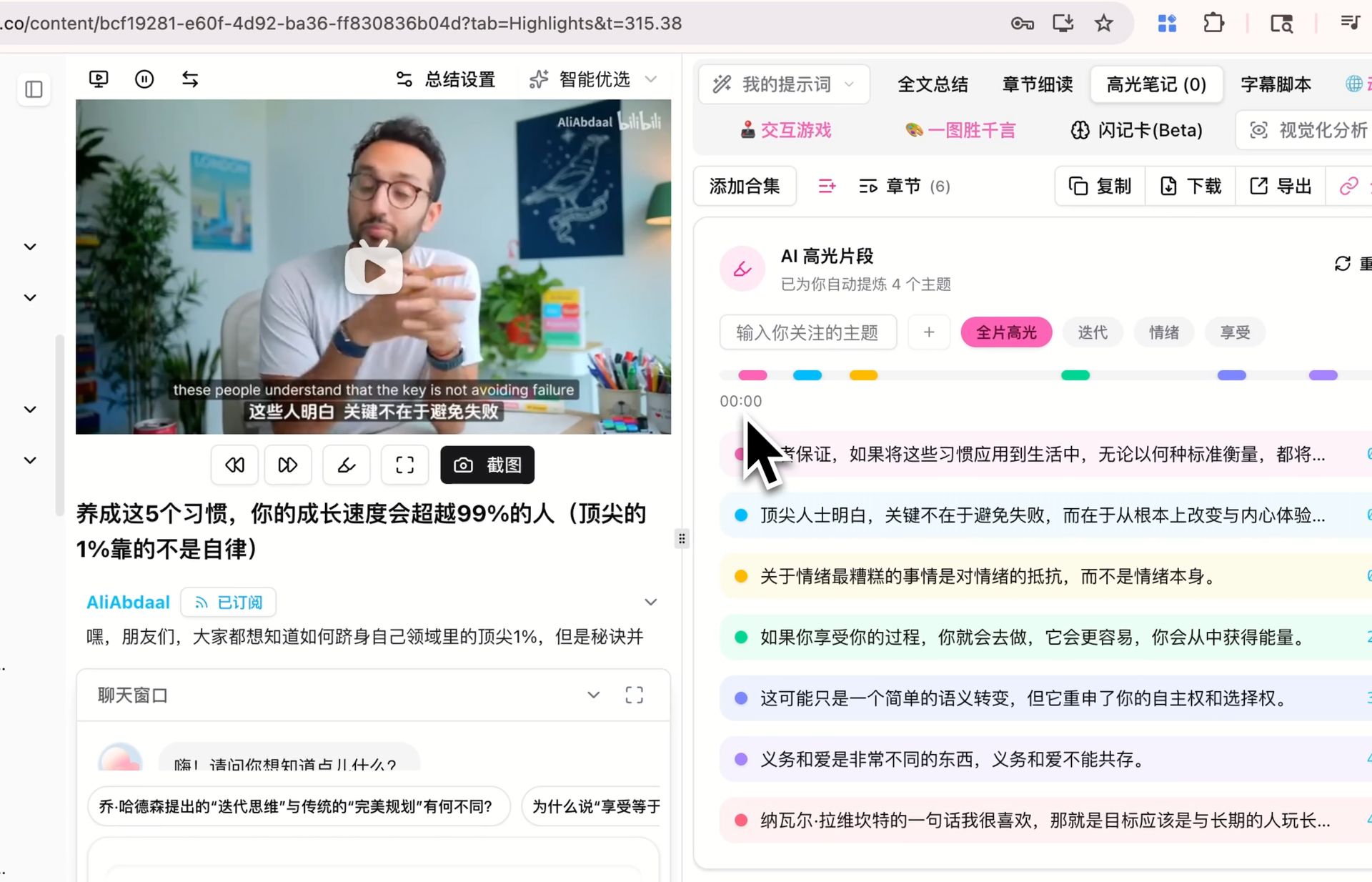

🔖 AI Highlight Notes

Mengekstrak klip highlight dari video dengan timestamp — dikelompokkan berdasarkan topik — juga berjalan pada model default. Jika Anda sudah menghasilkan highlight notes untuk beberapa video pada model lain, jalankan ulang pada V4 dan bandingkan klip mana yang ditandai sebagai highlight dan bagaimana topik mengelompok. Apakah perbedaan bermakna pada konten Anda paling mudah dinilai dengan melakukannya sendiri.

Ketiganya adalah skenario yang masih kami evaluasi sendiri — hasil bervariasi di seluruh konten, prompt, dan bahasa berbeda, dan take paling andal adalah yang Anda bentuk setelah beberapa run di dalam alur kerja Anda sendiri.

Beberapa area lain menggunakan model khusus — visual content analysis berjalan pada model vision, dan video-to-illustrated-article menggunakan pipeline tetap — sehingga mereka tidak merespons switch default-model dan tidak menjadi bagian dari perbandingan di atas.

BibiGPT telah melayani 1M+ pengguna dan menghasilkan 5M+ ringkasan AI hingga saat ini. Skala itu membantu kami memetakan setiap model baru ke skenario dunia nyata dengan cepat, alih-alih tinggal di lapisan benchmark-comparison.

Era AI: yang langka bukan model, melainkan seberapa cepat Anda mengonsumsi konten

Pada 2026, model AI pada dasarnya seperti air mengalir — DeepSeek V4, Gemini 3.1 Pro, Claude Opus 4.6 semua dalam jangkauan. Model tidak lagi langka.

Apa yang langka? Seberapa cepat Anda mengubah informasi menjadi pendapat, dan pendapat menjadi tindakan.

Audio dan video adalah format dengan kepadatan terendah, terlama untuk dikonsumsi di internet. Wawancara dua jam yang ditranskripsi adalah 8.000 kata, tapi tesis nyata mungkin 300. Musim podcast 30 jam menghasilkan mungkin 20 kutipan tahan lama. Selama bertahun-tahun satu-satunya trik adalah pemutaran 1.5x atau 2x — menukar perhatian dengan kepadatan. Dengan model terbaru, matematika berbalik:

- Tidak ada lagi mendengarkan pasif, cukup tanya pertanyaan yang Anda pedulikan — model menarik jawaban dari transkrip

- Tidak perlu menyelesaikan sebelum menilai, baca ringkasan dulu, lalu putuskan apakah pantas satu jam

- Tidak ada lagi membalik satu video pada satu waktu, cari di semuanya — “siapa di antara 100 kreator yang saya ikuti telah berbicara tentang topik ini”

BibiGPT melakukan satu hal: menyambungkan model terbaik yang tersedia ke format terbesar tetapi tersulit-untuk-dikonsumsi — audio dan video — sehingga siapa pun dapat mengompres dua jam video menjadi lima belas menit bacaan kepadatan tinggi. DeepSeek V4 menambahkan satu opsi andal lagi ke stack itu.

FAQ

Q1: Apa perbedaan antara DeepSeek V4 Pro dan V4 Pro Thinking?

Perbedaan inti adalah apakah reasoning eksplisit. Non-thinking adalah latensi lebih rendah dengan output lebih pendek, bagus untuk ringkasan bersih. Mode thinking menghasilkan rantai reasoning dulu — lebih baik untuk logika multi-langkah, perbandingan cross-chapter, atau analisis argumen. Anda dapat menyetel kedalaman dengan reasoning_effort=high/max; reasoning lebih dalam, output lebih lambat.

Q2: Apakah saya pilih V4 Pro atau V4 Flash?

Pikirkan dalam istilah “panjang × kompleksitas reasoning.” Lebih dari satu jam atau reasoning multi-langkah → Pro. Di bawah tiga puluh menit dan ringkasan bersih cukup → Flash. Saat ragu, mulai dengan Flash dan beralih ke Pro jika kurang — BibiGPT cache transkrip sehingga re-summarizing melewatkan langkah transkripsi sepenuhnya.

Q3: Mengapa melalui BibiGPT alih-alih menggunakan website DeepSeek langsung?

Website DeepSeek adalah chatbox generik — Anda masih perlu mengunduh, transkripsi, tempel, dan prompt sendiri. BibiGPT menangani pipeline hulu (parsing link 30+ platform, transkripsi, visual analysis, alignment timestamp), dan DeepSeek V4 hanya perlu mencakup langkah memahami-dan-menghasilkan terakhir. Input sama, dan Anda tambahan mendapat mindmap, highlight notes, illustrated articles, dan ekspor terstruktur tanpa perakitan ekstra.

Q4: Berapa panjang video yang dapat ditangani DeepSeek V4?

V4 Pro dan Flash keduanya memiliki konteks 1M token — sekitar 1,5 juta karakter Mandarin, atau lebih dari 20 jam dialog — cukup untuk satu musim podcast penuh. BibiGPT secara otomatis memutuskan antara ringkasan single-pass dan chunk-then-consolidate berdasarkan konteks efektif model.

Q5: Apakah bobot DeepSeek V4 open-source?

Sepenuhnya open-source. Bobot di Hugging Face deepseek-ai/deepseek-v4 dan ModelScope; laporan teknis di DeepSeek_V4.pdf. Peneliti dan self-hoster dapat mengambilnya langsung.

Coba V4 sekarang

Cara paling langsung untuk merasakan V4: pilih video panjang yang sudah lama ingin Anda tonton sebenarnya — kuliah, episode podcast, dokumenter, apa pun — dan jalankan melalui DeepSeek V4 Pro Thinking. Lihat bagaimana V4 menangani sesuatu yang benar-benar Anda pedulikan.

Mulai perjalanan pembelajaran efisien AI Anda sekarang:

- 🌐 Website Resmi: https://bibigpt.co/id/desktop?utm_source=growth-pages&utm_medium=blog-inline-cta&utm_campaign=bibigpt-integrates-deepseek-v4-1m-context

- 📱 Download Mobile: https://aitodo.co/app

- 💻 Download Desktop: https://aitodo.co/download/desktop

- ✨ Pelajari Lebih Banyak Fitur: https://aitodo.co/features

BibiGPT Team