DeepSeek-V4 burada! BibiGPT ilk gün dört yeni modeli + 1M context'i devreye aldı — AI video ve podcast özetleme bir üst seviyeye geçti

DeepSeek-V4 burada! BibiGPT ilk gün dört yeni modeli + 1M context’i devreye aldı — AI video ve podcast özetleme bir üst seviyeye geçti

Bugün (24 Nisan 2026) DeepSeek-V4 Preview resmi olarak yayınlandı ve tamamen açık kaynak oldu — 1M context artık varsayılan ve agent yeteneği Sonnet 4.5 ile arayı kapattı. BibiGPT aynı gün entegrasyonunu tamamladı ve DeepSeek V4 Pro, V4 Pro Thinking, V4 Flash ve V4 Flash Thinking model seçicisinden doğrudan seçilebilir; uzun bir belgesel, iki saatlik bir röportaj veya tüm bir podcast sezonu için hazır.

Modelleri hemen birkaç gerçek senaryoda çalıştırdık. Bu yazı, aynı tip içeriklerle uğraşan herkese hitaben aynı anda paylaşılan uygulamalı bir not.

İçindekiler

- DeepSeek-V4’te yeni olan ne

- BibiGPT’de canlı dört DeepSeek V4 modeli

- Üç adımda DeepSeek V4’e geç

- Uygulamalı: DeepSeek’in kendi tanıtım videosunu V4 Pro ile özetlemek

- V4’e geçmenin doğrudan uygulandığı senaryolar

- AI çağı: kıt olan modeller değil, içeriği ne kadar hızlı tükettiğindir

- SSS

DeepSeek-V4’te yeni olan ne

DeepSeek-V4 üç önemli kadranı aynı anda hareket ettiriyor. Her biri ayrı bir nota değer.

Birincisi, 1M context DeepSeek’in resmi servislerinde varsayılan oluyor. Yeni dikkat mekanizması token boyutunda sıkıştırıyor ve bellek + hesaplama maliyetini düşürmek için DSA (DeepSeek Sparse Attention) ile birleşiyor. Pratik olarak, bir saatlik altyazı beslemek artık “parçala-ve-birleştir” rutinini gerektirmiyor — model bunu sürekli bir gövde olarak okur.

İkincisi, agent yeteneği belirgin bir adım atıyor. DeepSeek’in kendi ölçümüne göre V4-Pro, Agentic Coding’de tüm açık kaynak modelleri geride bırakıyor ve Opus 4.6 non-thinking’e yakın kalite veriyor; zaten varsayılan iç kodlama modeli olarak kullanıyorlar. Günlük kullanıcılar için bu, daha güvenilir uzun metin yapılandırmasına dönüşür — bölümlere ayırma, ana nokta çıkarma, zihin haritası oluşturma — ve istikrar gözle görülür biçimde daha iyidir.

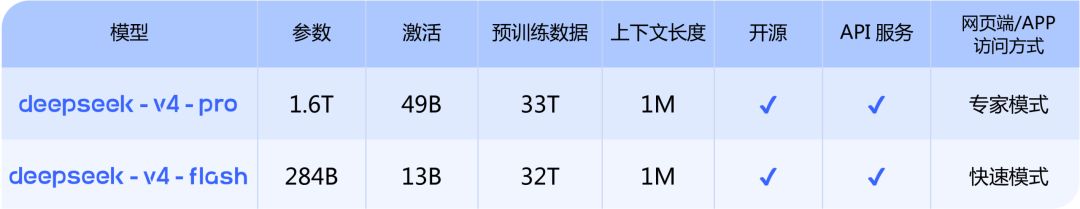

Üçüncüsü, Pro ve Flash birbirini tamamlar. Pro (1.6T parametre / 49B aktif / 33T ön eğitim tokeni) en üst kapalı kaynak modelleri hedef alır; Flash (284B / 13B / 32T) maliyet verimli seçenektir. İkisi de thinking ve non-thinking modlarını destekler ve thinking modu reasoning_effort ayarını destekler. Basit görevler için Flash, ağır görevler için Pro — ikisi de sağlam hissettirir.

Orijinal duyuru (Çince) burada: DeepSeek-V4 Preview: Milyon Token Çağı Ana Akıma Geçiyor. Model ağırlıkları Hugging Face DeepSeek V4 koleksiyonunda mevcut (Pro / Pro-Base / Flash / Flash-Base, dört repo); teknik rapor DeepSeek_V4.pdf içinde.

BibiGPT’de canlı dört DeepSeek V4 modeli

Herhangi bir video veya ses özet ayarını aç, model seçicisinde deepseek yaz, New etiketli dört yeni giriş göreceksin:

| Model | Kullanım örneği | Thinking |

|---|---|---|

| DeepSeek V4 Pro | Uzun, mantık yoğun içerik için en üst kalite | Non-thinking |

| DeepSeek V4 Pro Thinking | Açık akıl yürütme ile V4 Pro — agent ve derin analiz | Thinking |

| DeepSeek V4 Flash | Maliyet verimli, kısa ve günlük içerik için harika | Non-thinking |

| DeepSeek V4 Flash Thinking | Hız ve derinliği dengeleyen akıl yürütmeli Flash | Thinking |

Hangisini seçmeli? Basit bir karar kuralı:

- Daha uzun içerik (bir saatten fazla, tam podcast sezonları, uzun röportajlar) → tüm parça boyunca daha derin akıl yürütme için Pro veya Pro Thinking

- Daha kısa içerik (30 dakikadan az, toplantılar, günlük vlog’lar) → Flash, daha hızlı ve daha ekonomik

- Modelin adım adım akıl yürütmesini, görüşleri karşılaştırmasını, daha derine inmesini istiyorsan → bir Thinking varyantı seç

- Sadece temiz bir özete ihtiyacın varsa, akıl yürütme izi yok → bir non-thinking varyantı seç

Dikkatlice karşılaştırmak istemiyorsan V4 Pro Thinking ile başla — çoğu uzun içerik senaryosunda tutarlı sonuçlar verir.

Üç adımda DeepSeek V4’e geç

- BibiGPT’yi aç, giriş kutusuna bir YouTube / podcast / yerel dosya bağlantısı yapıştır

- Girdinin altındaki Default Model’a tıkla, arama çubuğuna

deepseekyaz - Dört New girişten herhangi birini seç ve özetle düğmesine bas

Seçim oturumlar arasında kalır. Güç kullanıcıları V4 Pro Thinking’i varsayılan özel özet olarak sabitleyebilir, böylece her gelecek video otomatik olarak bunun üzerinden geçer.

Modelleri değiştirmeden önce BibiGPT’nin özet kalitesini hissetmek ister misin? Aşağıdaki widget’a herhangi bir bağlantı bırak:

Uygulamalı: DeepSeek’in kendi tanıtım videosunu V4 Pro ile özetlemek

Yaptığımız ilk şey V4 Pro’yu DeepSeek’in kendi tanıtım videosunda çalıştırmaktı. Yaklaşık bir buçuk dakika ve thinking modu açıkken model bunu yedi yapılandırılmış bölüme ayırdı; her birinin kendi özeti, öne çıkanları, yansıması ve eleştirel incelemesi vardı.

Üzerinde durulması gereken birkaç ayrıntı:

- Tam olgu kapsamı: yayındaki beş manşet iddianın tümü (varsayılan olarak 1M context, agent sıçraması, dünya bilgisi liderliği, ikili katmanlı esneklik, agent ekosistem uyumluluğu) parametre numaraları dahil doğru biçimde geldi

- Her sonuç izlenebilir: her madde tıklanabilir bir video zaman damgasına geri bağlanır ve ilgili ana doğrudan atlar

- Takip soruları otomatik görünür: özetin altında model “iki V4 katmanı arasındaki fark nedir” ve “API üzerinden nasıl çağırırım” gibi uzantılar önerir, tek dokunuşla derin daldırma için hazırdır

Buradaki iyileşme esas olarak thinking modunun daha derin akıl yürütmesinden gelir. Uzun context, BibiGPT’deki ana modeller arasında zaten varsayılan bir yoldur ve V4’ün gelişi, “derin akıl yürütme + tam transkript istikrarı” kombinasyonunu açık kaynak katmanına birinci sınıf kalitede getirir.

V4’e geçmenin doğrudan uygulandığı senaryolar

Açık kaynak modeller düşmeye devam ediyor. Şunu sorabilirsin: doğrudan DeepSeek web sitesini veya API’yi kullanamaz mıyım? Neden BibiGPT üzerinden yönlendireyim?

Mesele senaryoya iniyor. DeepSeek web sitesi genel bir sohbet kutusudur — yine de videoyu indirmek, transkribe etmek, yapıştırmak ve nasıl prompt vereceğini bulmak zorundasın. BibiGPT yıllardır tek bir şey yapıyor: uzun video ve podcastleri bir makale okumak kadar kolay tüketilebilir hale getirmek. V4 o yığına eklenen en yeni yetenektir; “bağlantı yapıştır, gerçek anlayış al”ı işler hale getiren şey aslında modelin etrafında rafine ettiğimiz ürün katmanıdır.

BibiGPT içinde, aşağıdaki yetenekler “Default Model” olarak seçtiğin modeli doğrudan takip eder — başka bir deyişle, DeepSeek V4’e geçtiğinde bu özellikler V4’te çalışır.

📝 Video Özetleri (Varsayılan + Özel Prompt)

En sık kullandığın şey — bir bağlantı yapıştırdıktan sonra “Özetle”ye basmak — seçtiğin modelin üzerinde çalışır. Kayıtlı tüm özel promptlar (“Karşı sezgisel Analist”, “Eleştirel Düşünme” veya “Yatırım Analisti” gibi şeyler) aynı modelden geçer. DeepSeek V4 Pro Thinking’e geç, aynı videoyu aynı promptla yeniden çalıştır ve akıl yürütme derinliği ile yapı üzerinde doğrudan yan yana karşılaştırma elde et. Bu kendimizin hala araştırdığı senaryolardan biri — kendi içeriğin üzerinde çalıştır ve sonucun beklentilerine daha iyi uyup uymadığını gör.

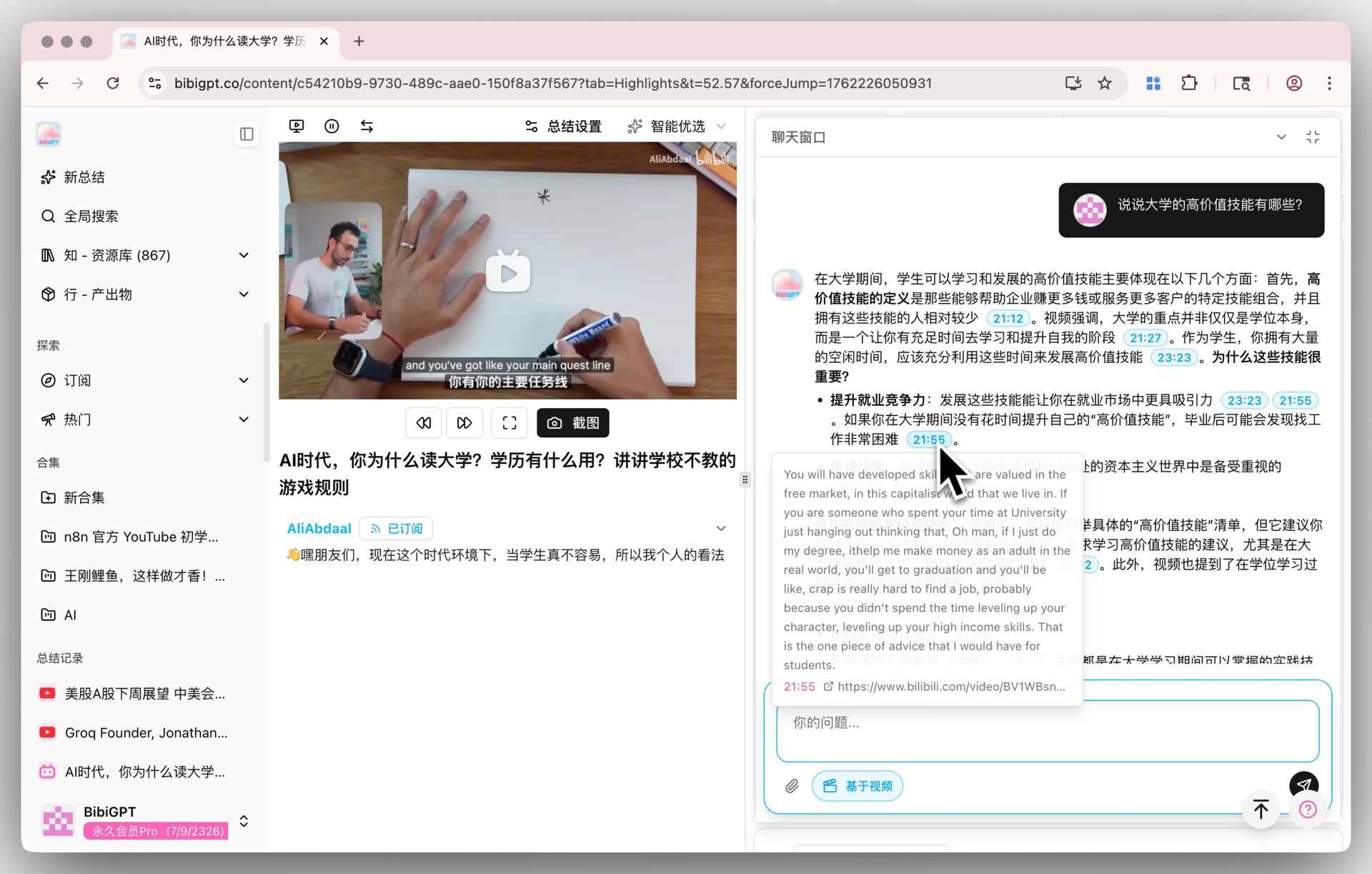

🎯 Kaynak İzlemeli AI Video Sohbeti

Video detay sayfasının altındaki sohbet penceresi de varsayılan modeli takip eder. Her cevap tıklanabilir bir zaman damgası taşır — “tam tersi noktayı 1:12:30’da yaptı”, tek dokunuş ve oraya atlarsın. V4’e geçtikten sonra, 1+ saatlik bir röportaj seç ve birkaç tur takip sorusu sor — bu modeller arasındaki farkların hızla ortaya çıkma eğiliminde olduğu bir senaryo ve doğrudan deneme değer.

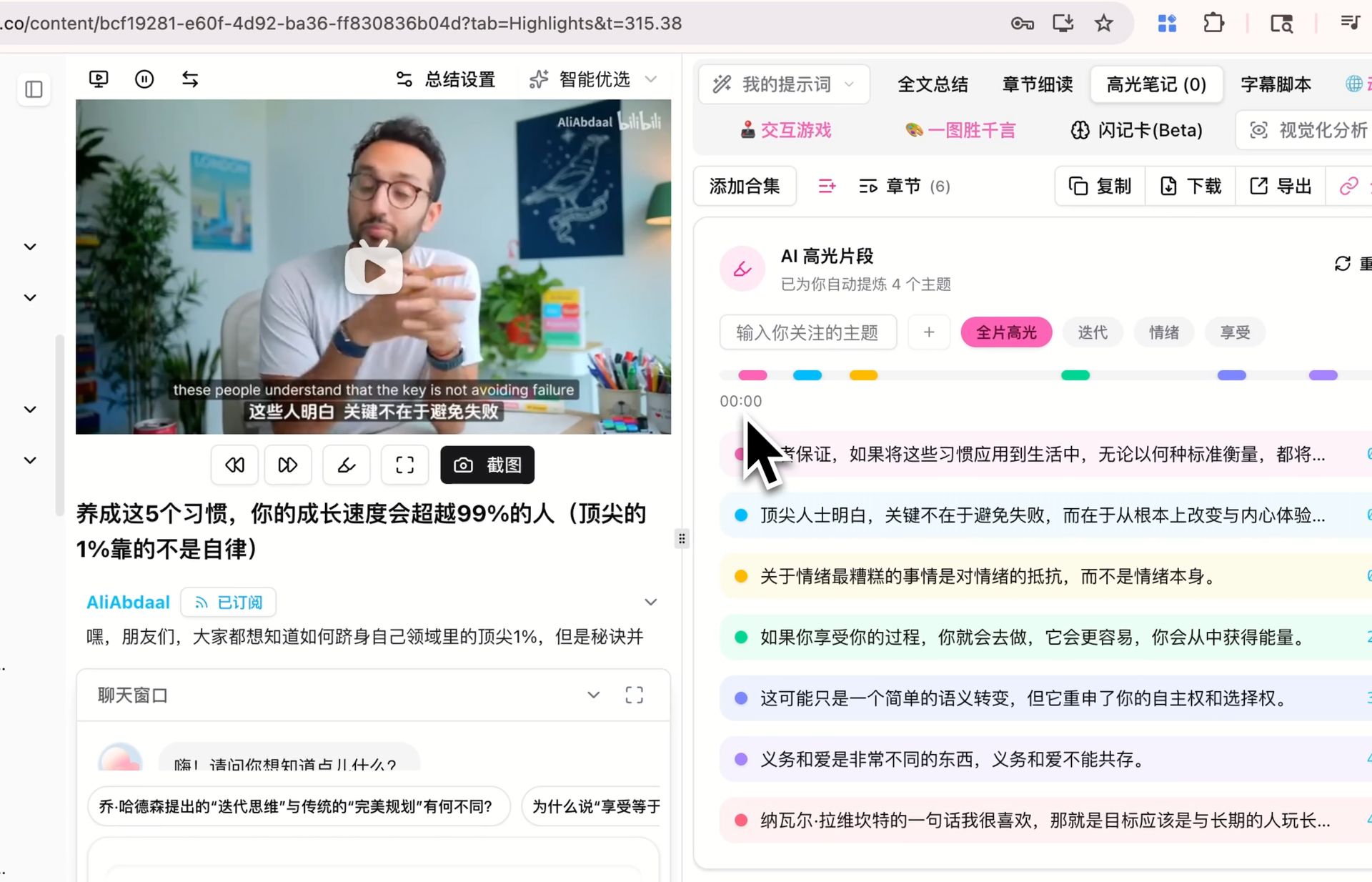

🔖 AI Öne Çıkan Notları

Bir videodan zaman damgalı öne çıkan klipleri çıkarmak — konuya göre gruplandırılmış — da varsayılan modelde çalışır. Başka bir modelde bir video için zaten öne çıkan notlar oluşturduysan, bunları V4’te yeniden çalıştır ve hangi kliplerin öne çıkan olarak işaretlendiğini ve konuların nasıl kümelendiğini karşılaştır. İçeriğindeki farkın anlamlı olup olmadığını yargılamanın en kolay yolu kendin yapmaktır.

Üçü de hala kendimizin değerlendirdiği senaryolardır — sonuçlar farklı içerik, prompt ve diller arasında değişir ve en güvenilir görüş kendi iş akışınızda birkaç çalışmadan sonra oluşturduğunuzdur.

Birkaç başka alan özel modeller kullanır — görsel içerik analizi bir vision modelinde çalışır ve video-to-illustrated-article sabit bir pipeline kullanır — bu yüzden varsayılan model değişimine yanıt vermezler ve yukarıdaki karşılaştırmanın parçası değildirler.

BibiGPT bugüne kadar 1M+ kullanıcıya hizmet etti ve 5M+ AI özeti üretti. Bu ölçek her yeni modeli benchmark karşılaştırma katmanında kalmak yerine gerçek dünya senaryolarına hızla eşlememize yardımcı olur.

AI çağı: kıt olan modeller değil, içeriği ne kadar hızlı tükettiğindir

2026’da AI modelleri esasen akan su gibi — DeepSeek V4, Gemini 3.1 Pro, Claude Opus 4.6 hepsi erişilebilir. Modeller artık kıt değil.

Kıt olan ne? Bilgiyi ne kadar hızlı görüşe ve görüşü eyleme dönüştürdüğün.

Ses ve video, internetteki en düşük yoğunluklu, tüketmesi en uzun süren formattır. İki saatlik bir röportajın transkripsiyonu 8.000 kelimedir, ancak gerçek tez 300 olabilir. 30 saatlik bir podcast sezonu belki 20 kalıcı alıntı verir. Yıllarca tek hile 1.5x veya 2x oynatmaydı — yoğunluk için dikkati takas etmek. En son modellerle hesap tersine döner:

- Pasif dinleme yok, sadece umursadığın soruları sor — model cevapları transkriptten çeker

- Yargılamadan önce bitirmeye gerek yok, önce özeti oku, sonra saati hak edip etmediğine karar ver

- Bir defada bir video çevirmek yok, tümünde ara — “takip ettiğim 100 yaratıcıdan kim bu konu hakkında konuştu”

BibiGPT tek bir şey yapar: mevcut en iyi modeli en büyük ama tüketmesi en zor formatta — ses ve video — devreye sokar — böylece herkes iki saatlik videoyu on beş dakikalık yüksek yoğunluklu okumaya sıkıştırabilir. DeepSeek V4 o yığına bir güvenilir seçenek daha ekler.

SSS

S1: DeepSeek V4 Pro ile V4 Pro Thinking arasındaki fark nedir?

Temel fark akıl yürütmenin açık olup olmadığıdır. Non-thinking daha düşük gecikmeli ve daha kısa çıktıdır, temiz bir özet için iyidir. Thinking modu önce bir akıl yürütme zinciri oluşturur — çok adımlı mantık, bölümler arası karşılaştırma veya argüman analizi için daha iyi. Derinliği reasoning_effort=high/max ile ayarlayabilirsin; daha derin akıl yürütme, daha yavaş çıktı.

S2: V4 Pro mu V4 Flash mı seçmeliyim?

“Uzunluk × akıl yürütme karmaşıklığı” cinsinden düşün. Bir saatten fazla veya çok adımlı akıl yürütme → Pro. Otuz dakikadan az ve temiz bir özet yeterli → Flash. Şüphedeyken Flash ile başla ve yetersiz kalırsa Pro’ya geç — BibiGPT transkripti önbelleğe alır, böylece yeniden özetlemek transkripsiyon adımını tamamen atlar.

S3: Doğrudan DeepSeek web sitesi yerine neden BibiGPT üzerinden gideyim?

DeepSeek web sitesi genel bir sohbet kutusudur — yine de kendin indirmek, transkribe etmek, yapıştırmak ve prompt vermek zorundasın. BibiGPT yukarı akış pipeline’ını (30+ platform bağlantı ayrıştırma, transkripsiyon, görsel analiz, zaman damgası hizalama) ele alır ve DeepSeek V4’ün yalnızca son anla-ve-üret adımını kapsaması gerekir. Aynı girdi ve ek olarak hiçbir ek montaj olmadan zihin haritaları, öne çıkan notlar, resimli makaleler ve yapılandırılmış dışa aktarımlar elde edersin.

S4: DeepSeek V4 ne kadar uzun bir videoyu işleyebilir?

V4 Pro ve Flash’ın her ikisinin de 1M token context’i vardır — yaklaşık 1,5 milyon Çince karakter veya 20 saatten fazla diyalog — tam bir podcast sezonu için yeterli. BibiGPT, modelin etkili context’ine göre tek geçişli özetleme ile parçala-sonra-birleştir arasında otomatik karar verir.

S5: DeepSeek V4 ağırlıkları açık kaynak mı?

Tamamen açık kaynak. Ağırlıklar Hugging Face deepseek-ai/deepseek-v4 ve ModelScope’ta; teknik rapor DeepSeek_V4.pdf içinde. Araştırmacılar ve self-hoster’lar bunları doğrudan alabilir.

Şimdi V4’ü dene

V4’ü hissetmenin en doğrudan yolu: aslında izlemeyi düşündüğün uzun bir video seç — bir ders, bir podcast bölümü, bir belgesel, ne olursa olsun — ve DeepSeek V4 Pro Thinking üzerinden çalıştır. V4’ün gerçekten umursadığın bir şeyi nasıl ele aldığını gör.

AI verimli öğrenme yolculuğunu şimdi başlat:

- 🌐 Resmi web sitesi: https://bibigpt.co/tr/desktop?utm_source=growth-pages&utm_medium=blog-inline-cta&utm_campaign=bibigpt-integrates-deepseek-v4-1m-context

- 📱 Mobil indirme: https://aitodo.co/app

- 💻 Masaüstü indirme: https://aitodo.co/download/desktop

- ✨ Daha fazla özellik öğren: https://aitodo.co/features

BibiGPT Team