DeepSeek-V4 来啦!BibiGPT 当天上线 4 款新模型 + 1M 上下文,AI 音视频总结体验再升级

DeepSeek-V4 来啦!BibiGPT 当天上线 4 款新模型 + 1M 上下文,AI 音视频总结体验再升级

今天(2026 年 4 月 24 日),DeepSeek-V4 预览版正式发布并同步开源——百万 token 上下文成为标配,Agent 能力直追 Sonnet 4.5。BibiGPT 已经第一时间完成接入,DeepSeek V4 Pro、V4 Pro Thinking、V4 Flash、V4 Flash Thinking 四款新模型现在可以直接在模型选择器里选用,适合处理一整部纪录片、一场两小时的访谈、或者一整季的播客。

我们也在第一时间用几个真实场景跑了一遍,这篇是同步整理的上手记录,供有同类使用需求的朋友参考。

目录

- DeepSeek-V4 这次改了什么

- BibiGPT 同步上线的四款 DeepSeek V4 模型

- 三步切换到 DeepSeek V4

- 实战:用 DeepSeek V4 Pro 总结 DeepSeek 自己的发布视频

- 这几个场景,切到 V4 会直接生效

- AI 时代,真正稀缺的不是模型,是消费内容的速度

- 常见问题(FAQ)

DeepSeek-V4 这次改了什么

DeepSeek-V4 一次升级同时动了三个关键维度,每一项都值得单独说。

第一,1M 上下文成为所有官方服务的标配。 新的注意力机制在 token 维度做压缩,再配上 DSA 稀疏注意力(DeepSeek Sparse Attention),显存与算力消耗被大幅压下来。换句话说,投入一小时视频的字幕不再需要「分段再拼接」那套流程,模型可以当成一整段内容一次性理解。

第二,Agent 能力迈上一个台阶。 按 DeepSeek 自己的测评,V4-Pro 在 Agentic Coding 上已达到当前开源模型最佳水平,交付质量接近 Opus 4.6 非思考模式,他们内部也已经把它作为默认编码模型在使用。对普通用户来说,意味着长文本的结构化处理——划章节、抽要点、生成导图——稳定度有了明显提升。

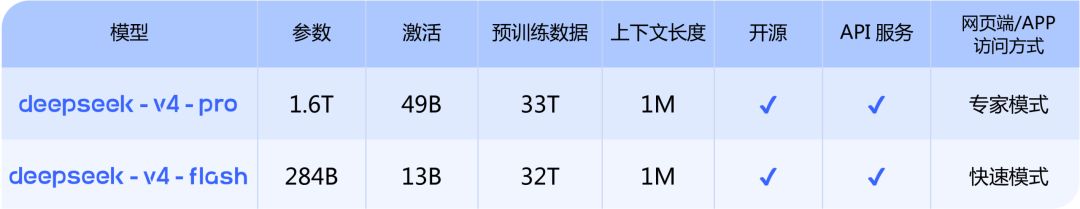

第三,Pro 与 Flash 双版本互补。 Pro(1.6T 参数 / 49B 激活 / 33T 预训练)对标顶级闭源模型,Flash(284B / 13B / 32T)更偏重性价比,两者都支持思考与非思考模式,思考模式还支持 reasoning_effort 调节。简单任务上 Flash,硬核任务上 Pro,两边的使用体验都相当扎实。

详细的 blog 原文可以参考 DeepSeek 官方公众号的这篇:《DeepSeek-V4 预览版:迈入百万上下文普惠时代》。模型权重可以在 Hugging Face 的 DeepSeek V4 合集(Pro / Pro-Base / Flash / Flash-Base 四个 repo)下载,技术报告可以直接看 DeepSeek_V4.pdf。

BibiGPT 同步上线的四款 DeepSeek V4 模型

打开任意视频或音频的总结设置,在模型选择器里搜索 deepseek,可以看到四个带 New 标签的新条目:

| 模型 | 定位 | 思考模式 |

|---|---|---|

| DeepSeek V4 Pro | 顶级性能,高质量结论与长逻辑链的首选 | 非思考 |

| DeepSeek V4 Pro Thinking | V4 Pro + 显式推理,Agent 与深度分析任务首选 | 思考 |

| DeepSeek V4 Flash | 性价比优先,日常短内容 | 非思考 |

| DeepSeek V4 Flash Thinking | Flash + 推理,速度与深度的平衡版本 | 思考 |

怎么挑? 可以参考这个简单的决策规则:

- 内容较长(1 小时以上的纪录片、整季播客、长访谈)→ 选 Pro 或 Pro Thinking,配合深度推理更稳

- 内容较短(30 分钟以内的会议、日常 Vlog)→ 选 Flash,更快且更经济

- 希望 AI 分步推理、对比观点、给出更深分析 → 选 Thinking 版本

- 只需要干净的摘要、不需要思考过程 → 选非思考版本

如果不想仔细比较,可以先从 V4 Pro Thinking 开始——它在大多数长内容场景都能给出稳定表现。

三步切换到 DeepSeek V4

- 打开 BibiGPT,把 YouTube / B 站 / 播客 / 本地文件的链接贴进输入框

- 点击输入框下方的「默认模型」,在搜索框里输入

deepseek - 从四个 New 条目里选一款,点击「一键总结」

选好的模型会在下一次打开时保留。如果你是重度用户,建议把 V4 Pro Thinking 设为自定义总结置顶默认,之后任意视频都会走它处理。

想在正式切换模型之前先感受一下 BibiGPT 的总结效果?在下面的组件里直接贴一个链接就可以:

实战:用 DeepSeek V4 Pro 总结 DeepSeek 自己的发布视频

我们第一件事就是用 V4 Pro 跑了一遍 DeepSeek 自己的发布视频。约一分半的短片,开启思考模式后,模型把它切成 7 个结构化章节,每一章都带摘要、亮点、思考与批判性反思。

几个值得提一下的细节:

- 事实覆盖完整:DeepSeek 发布中的五大亮点(百万上下文普惠化、Agent 能力跃升、世界知识领先、双版本灵活、Agent 生态适配)全部准确复现,参数数字也没有错乱

- 结论可追溯:每一条结论都挂有可点击的时间戳,直接跳回视频的对应片段

- 自动延伸:摘要下方会自动生成延伸问题(「两个 V4 版本有什么区别?」「如何通过 API 调用?」),点开即可继续深入对话

这里的提升主要来自 思考模式 带来的深度推理。BibiGPT 本身在各主流模型上都默认走长上下文路径,V4 的加入让开源阵营也能在「深度推理 + 稳定覆盖全文」这条线上提供第一梯队的体验。

这几个场景,切到 V4 会直接生效

开源模型一家接一家发,有人可能会问:直接在 DeepSeek 官网或者自己接 API 就能用 V4,为什么还要经过 BibiGPT?

原因在于场景。DeepSeek 官网本身是一个通用聊天框,需要你自己把视频下载、转写、粘贴、再思考怎么提问。BibiGPT 做的事情比较纯粹:把长视频和播客变得像阅读文章一样好消化。V4 是最新加进来的一块能力,真正让「粘一个链接就能深度理解一段音视频」跑通的,是我们在模型之外已经打磨多年的产品能力。

在 BibiGPT 的现有能力里,以下几个场景直接跟随你在「默认模型」里选中的模型——换句话说,一旦切到 DeepSeek V4,这些能力就是在用 V4 运行。

📝 视频总结(默认总结 + 自定义总结)

视频粘进来之后最常用的那一下——「一键总结」本身就是用你当前选中的模型生成的。如果你保存过自定义 Prompt(比如「反常识专家」「批判性思考」「投资分析」等),它们也会走同一个模型。切到 DeepSeek V4 Pro Thinking,同一个视频、同一条 Prompt 再跑一次,就可以直接对比推理链和结构化这两块的变化——这一块我们自己也还在持续体验,欢迎你先跑起来,看看结果是否更贴合你的使用预期。

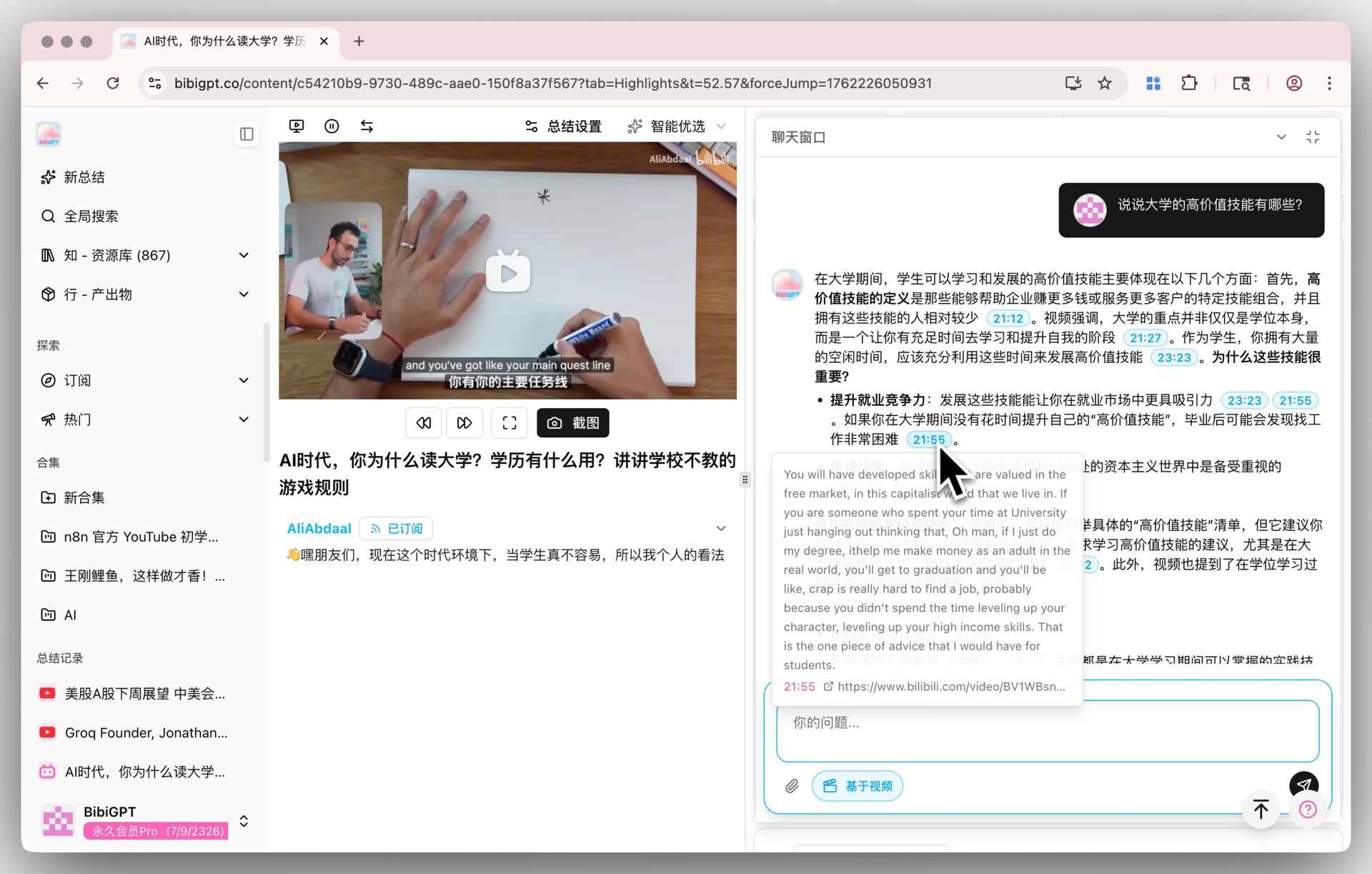

🎯 AI 视频对话与智能溯源

视频详情页下方的「聊天窗口」也跟着默认模型走。每一条答案都附带可点击的时间戳——比如「他在 1:12:30 提到过相反的观点」,一点就能精准跳到那一秒。建议你切到 V4 之后,挑一段 1 小时以上的访谈连着问几轮追问,这是一个很容易感受到不同模型差异的场景,值得亲自跑一次。

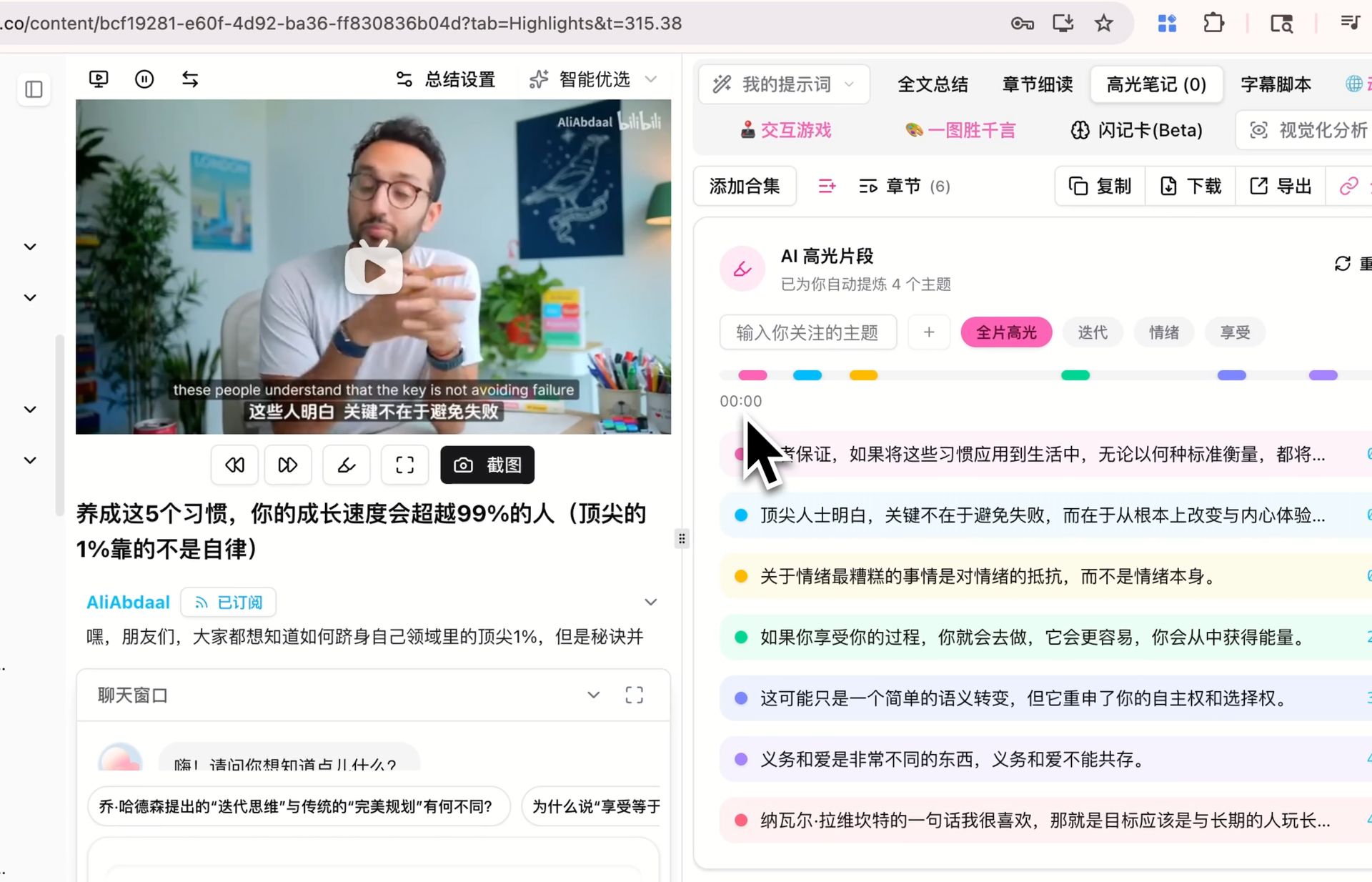

🔖 AI 高光笔记

自动从视频里挑出带时间戳的高光片段并按主题聚类,这个过程同样走默认模型。如果你过去已经用其他模型给某个视频生成过高光笔记,现在切到 V4 再生成一次,对比一下「哪些被挑成高光」「主题是怎么聚类的」——差异是否明显、是否更合你口味,直接比一比就清楚。

上面三个场景都是我们目前仍在持续体验 V4 表现的地方——不同内容、不同 Prompt、不同语言下的效果可能都有差异,结论这事最可靠的办法还是在你自己的日常工作流里多跑几次。

另外,画面内容分析走的是视觉模型、视频转图文文章有固定的管线,这些场景目前不会因默认模型的切换而变化,不在本次的对比范围内。

BibiGPT 至今已服务 100 万+ 用户,累计生成 500 万+ AI 总结。这些规模让我们在接入新模型时能更快地把它对上真实的用户场景,而不是停留在 benchmark 对比层面。

AI 时代,真正稀缺的不是模型,是消费内容的速度

2026 年的 AI 模型已经像自来水一样——DeepSeek V4、Gemini 3.1 Pro、Claude Opus 4.6,谁都能调。模型本身不再稀缺。

那什么变成稀缺了?把信息消化成观点、再转化为行动的速度。

音视频是互联网上信息密度最低、消耗时间最长的载体。一场两小时的访谈,文字转下来 8000 字,真正值得记住的结论可能只有 300 字;一整季播客 30 小时,长期被引用的观点也许只有 20 条。过去大家只能 1.5 倍速、2 倍速去扛,用注意力换取密度。大模型能力爆发之后,这笔账可以重新算了:

- 不必被动听完,主动提问即可——只问关心的点,模型从字幕中定位答案

- 不必看完再判断,先读摘要再决定要不要深入

- 不必一个视频接一个视频地翻,直接跨视频检索——「订阅的博主里谁讨论过这个话题」一次搜出来

BibiGPT 做的事情只有一件:把最好的大模型接到「消费音视频」这个最大但最难啃的场景里,让每个人都能把 2 小时的视频压成 15 分钟的高密度阅读。DeepSeek V4 的加入让这件事又多了一个可靠的选项。

常见问题(FAQ)

Q1:DeepSeek V4 Pro 和 V4 Pro Thinking 有什么区别?

核心区别是「是否显式推理」。非思考模式延迟更低、输出更短,适合干净的摘要;思考模式会先生成一段推理链,适合多步逻辑、跨章节对比、论证推演等任务。思考模式还可以通过 reasoning_effort=high/max 调节深度,越深越慢但也越细致。

Q2:我应该选 V4 Pro 还是 V4 Flash?

可以用「长度 × 推理复杂度」来判断:1 小时以上、或需要多步推演的内容建议 Pro;30 分钟以内、只需要干净摘要的日常视频 Flash 已经足够。拿不准时可以先用 Flash,不够满意再切到 Pro——BibiGPT 会缓存原始字幕,重新总结不会重复转写。

Q3:为什么要经过 BibiGPT 而不是直接用 DeepSeek 官网?

DeepSeek 官网是通用聊天框,需要你自己完成视频下载 → 语音转写 → 粘贴 → 提问的全过程。BibiGPT 已经把前置的处理环节(30+ 平台链接解析、转录、画面识别、时间戳对齐)完成好,DeepSeek V4 只需要负责最后一公里的理解与生成。同一份输入,你还能额外拿到思维导图、高光笔记、图文文章、结构化导出等产物,不需要再自己拼接。

Q4:DeepSeek V4 能处理多长的视频?

V4 Pro 与 Flash 都是 1M token 上下文,中文大约对应 150 万字,相当于 20 小时的对话内容,或是一整季的长播客。BibiGPT 会根据模型的有效上下文自动决定是做整体总结还是分段之后再合并。

Q5:DeepSeek V4 的权重开源吗?

完全开源。权重在 Hugging Face deepseek-ai/deepseek-v4 与 ModelScope,技术报告可以直接打开 DeepSeek_V4.pdf 阅读。需要自行研究或部署的用户可以按自己的节奏下载。

现在就体验 V4

感受 V4 最直接的方式:挑一条你最近本来就想认真看一遍的长视频——一场讲座、一期播客、一部纪录片都行——选上 DeepSeek V4 Pro Thinking 跑一次,看看 V4 在你关心的内容上是什么手感。

立即访问 BibiGPT 官网,开启你的 AI 高效学习之旅:

- 🌐 官网: https://bibigpt.co/zh/desktop?utm_source=growth-pages&utm_medium=blog-inline-cta&utm_campaign=bibigpt-integrates-deepseek-v4-1m-context

- 📱 移动端下载: https://bibigpt.co/app

- 💻 桌面端下载: https://bibigpt.co/download/desktop

- ✨ 了解更多功能: https://bibigpt.co/features

BibiGPT 团队