Gemini Embedding 2 अब मल्टीमॉडल: BibiGPT 2026 में वीडियो और ऑडियो सर्च को कैसे चरम पर ले जाता है

Gemini Embedding 2 अब मल्टीमॉडल: BibiGPT 2026 में वीडियो और ऑडियो सर्च को कैसे चरम पर ले जाता है

2026-04-29 तक के तथ्य। सभी जानकारी आधिकारिक Google Gemini API Changelog से।

Gemini Embedding 2 ने 2026-04-22 को GA हिट किया, सिर्फ़-टेक्स्ट से बढ़कर टेक्स्ट/इमेज/वीडियो/ऑडियो/PDF — सब एक ही वेक्टर स्पेस शेयर करते हैं। इसका मतलब अब एक ही टेक्स्ट क्वेरी वीडियो फ़्रेम, ऑडियो क्लिप और PDF स्क्रीनशॉट तक पहुँच सकती है — तीन अलग पाइपलाइन की ज़रूरत नहीं। यही वह पुरानी समस्या है जिसे BibiGPT यूज़र्स के लिए सुलझा रहा है: “मुझे याद है वीडियो में यह कहा गया था लेकिन सारांश में नहीं है।” नीचे: असल में क्या बदला, और BibiGPT का तीन-चरण वर्कफ़्लो जो आज ही नई क्षमता को काम में लाता है।

पृष्ठभूमि: सिंगल-मॉडल से मल्टीमॉडल एम्बेडिंग तक 18 महीने

Google ने 2026-04-22 को Gemini Embedding 2 को प्रीव्यू से GA में प्रमोट किया, साथ में API changelog अपडेट भी। आधिकारिक घोषणा के साथ जोड़कर, यह रही टाइमलाइन:

- 2024-08: पहली पीढ़ी का

text-embedding-004लॉन्च, सिर्फ़ टेक्स्ट - 2025-09: Gemini Embedding 1 (मल्टीलिंगुअल टेक्स्ट) GA, 100+ भाषाएँ

- 2026-02: Gemini Embedding 2 प्रीव्यू में आया, मल्टीमॉडल का प्रीव्यू

- 2026-04-22: GA रिलीज़, एक शेयर्ड वेक्टर स्पेस में 5 मॉडैलिटी का नेटिव सपोर्ट

यह पहली बार है जब Google ने इमेज/वीडियो/ऑडियो/PDF एम्बेडिंग को टेक्स्ट के साथ एक ही API और एक ही वेक्टर स्पेस में रखा है। पुराने तरीक़े से वीडियो सर्च का मतलब था ASR-से-टेक्स्ट, फिर एक विज़न मॉडल फ़्रेम का कैप्शन बनाता, फिर रीरैंकर के ज़रिए दो वेक्टर स्टोर का मेल — तीन पाइपलाइन, तीन चंकिंग रणनीतियाँ, तीन कॉस्ट लाइन, और रीकॉल जो कभी पूरी तरह मेल नहीं खाता। Gemini Embedding 2 इसे एक API कॉल में समेट देता है।

गहन विश्लेषण: प्रभाव की तीन परतें

तकनीकी: क्रॉस-मॉडल रिट्रीवल अब मॉडल समस्या, पाइपलाइन समस्या नहीं

लीगेसी वीडियो रिट्रीवल में इंजीनियरिंग का काम था “वीडियो को सर्च करने योग्य यूनिट में कैसे अलाइन करें।” Gemini Embedding 2 इसे मॉडल लेयर में नीचे धकेल देता है:

| लीगेसी अप्रोच | Gemini Embedding 2 |

|---|---|

| ASR → LLM सारांश → टेक्स्ट एम्बेडिंग | ऑडियो चंक सीधे एम्बेड |

| विज़न मॉडल कैप्शन → टेक्स्ट एम्बेडिंग | कीफ़्रेम सीधे एम्बेड |

| तीन अलग वेक्टर स्टोर | एक शेयर्ड वेक्टर स्पेस |

| क्रॉस-मॉडल रीकॉल को रीरैंकर चाहिए | नेटिव कोसाइन सिमिलैरिटी तुलनीय है |

व्यावहारिक प्रभाव: “यूज़र एक वाक्य टाइप करके वीडियो ढूंढता है” का P95 लेटेंसी मिनटों से सेकंडों में गिरता है, और रिट्रीव शुरू करने से पहले ट्रांसक्राइब करने की ज़रूरत नहीं।

मार्केट: RAG वेंडर्स को “स्टैक के निचले हिस्से को फिर से लिखने” की विंडो

2025 में अधिकांश RAG प्लेटफ़ॉर्म ने टेक्स्ट और इमेज इंडेक्स अलग रखे। Gemini Embedding 2 छह महीने में “नेटिव मल्टीमॉडल वेक्टर स्टोर” को टेबल स्टेक्स बनाता है। जो वेंडर्स पहले मल्टीमॉडल एम्बेडिंग सही करेंगे उन्हें कंटेंट रिट्रीवल प्रोडक्ट्स पर 12-18 महीने की विंडो मिलेगी; पिछड़ने वालों को 2026 H2 में अपना रिट्रीवल स्टैक फिर से लिखना पड़ेगा। पेस वैसा ही दिखता है जैसे 2023 में GPT-4 के बाद हर प्रोडक्ट को LLM बोल्ट करना पड़ा।

इकोसिस्टम: कंटेंट प्लेटफ़ॉर्म्स की लॉन्ग-टेल वैल्यू अनलॉक

YouTube, Bilibili, podcast नेटवर्क्स ने एक दशक का वीडियो जमा किया है। सबसे बड़ी वैल्यू लॉस “कोई नहीं देखता” नहीं बल्कि कोई सटीक सर्च नहीं कर सकता है। Gemini Embedding 2 पहली बार “मुझे याद है कि एक क्रिएटर ने 20वें मिनट के आसपास X का ज़िक्र किया था” को रिट्रीव करने योग्य बनाता है। क्रिएटर्स के लिए, पुराने वीडियो पर सोया हुआ ट्रैफ़िक वापस आता है; उपभोक्ताओं के लिए, “देखकर सीखना” निष्क्रिय नहीं रहकर क्वेरी-संचालित बनता है।

इसका BibiGPT यूज़र्स के लिए क्या मतलब

क्रिएटर्स के लिए: पुराने वीडियो फिर से खोजे गए

जो डिटेल्स कभी आपके सारांश में नहीं आईं वे सर्च करने योग्य हो जाती हैं। BibiGPT में वीडियो इम्पोर्ट करने के बाद, Global Deep Search पहले से ही रॉ ट्रांसक्रिप्ट हिट करता है; ऊपर मल्टीमॉडल एम्बेडिंग जोड़ने से फ़्रेम-लेवल रिट्रीवल मिलता है — वह चार्ट जो आपने दिखाया लेकिन कभी बताया नहीं।

छात्रों और शोधकर्ताओं के लिए: क्रॉस-वीडियो नॉलेज ग्राफ़

दस कोर्स वीडियो, पाँच podcasts, तीन PDF हैंडआउट्स — पहले आप उन्हें अलग-अलग इंडेक्स करते थे और हाथ से मिलाते थे। BibiGPT के अंदर Collection Summary + Collection AI Chat वर्कफ़्लो पहले से क्रॉस-कंटेंट रिट्रीवल के इर्द-गिर्द बना है। मल्टीमॉडल एम्बेडिंग “वह लेक्चर ढूंढो जहाँ वह डायग्राम आया था” को विलासिता से रूटीन में बदल देती है।

एंटरप्राइज़ के लिए: इंटरनल वीडियो एसेट्स क्वेरी करने योग्य

मीटिंग रिकॉर्डिंग, ट्रेनिंग वीडियो, प्रोडक्ट डेमो — ऐतिहासिक रूप से डेड इन्वेंटरी। मल्टीमॉडल एम्बेडिंग + BibiGPT की बैच प्रोसेसिंग का मतलब इंटरनल नॉलेज बेस आख़िरकार दस्तावेज़, वीडियो और ऑडियो को एक सर्च में कवर कर सकता है।

BibiGPT वर्कफ़्लो: तीन चरणों में Gemini Embedding 2 को चरम पर लाना

चरण 1: इंजेस्ट — BibiGPT को ऑटो-ट्रांसक्राइब और कीफ़्रेम एक्सट्रैक्ट करने दें

BibiGPT में YouTube/Bilibili लिंक पेस्ट करें। सिस्टम ऑटो-ट्रांसक्राइब करता है, कीफ़्रेम निकालता है और स्ट्रक्चर्ड सारांश बनाता है। यह चरण लंबे वीडियो को सबसे छोटी सर्च करने योग्य यूनिट में टुकड़े करता है।

Keyframe Screenshot Analysis पहले से Gemini 3.0 Flash और Qwen3.5 Omni Plus सहित छह विज़न मॉडल्स को सपोर्ट करता है। वे फ़्रेम के अंदर चार्ट, कोड ब्लॉक और स्लाइड कंटेंट को समझते हैं — ठीक उसी तरह का इनपुट जिसके लिए मल्टीमॉडल एम्बेडिंग डिज़ाइन की गई थी।

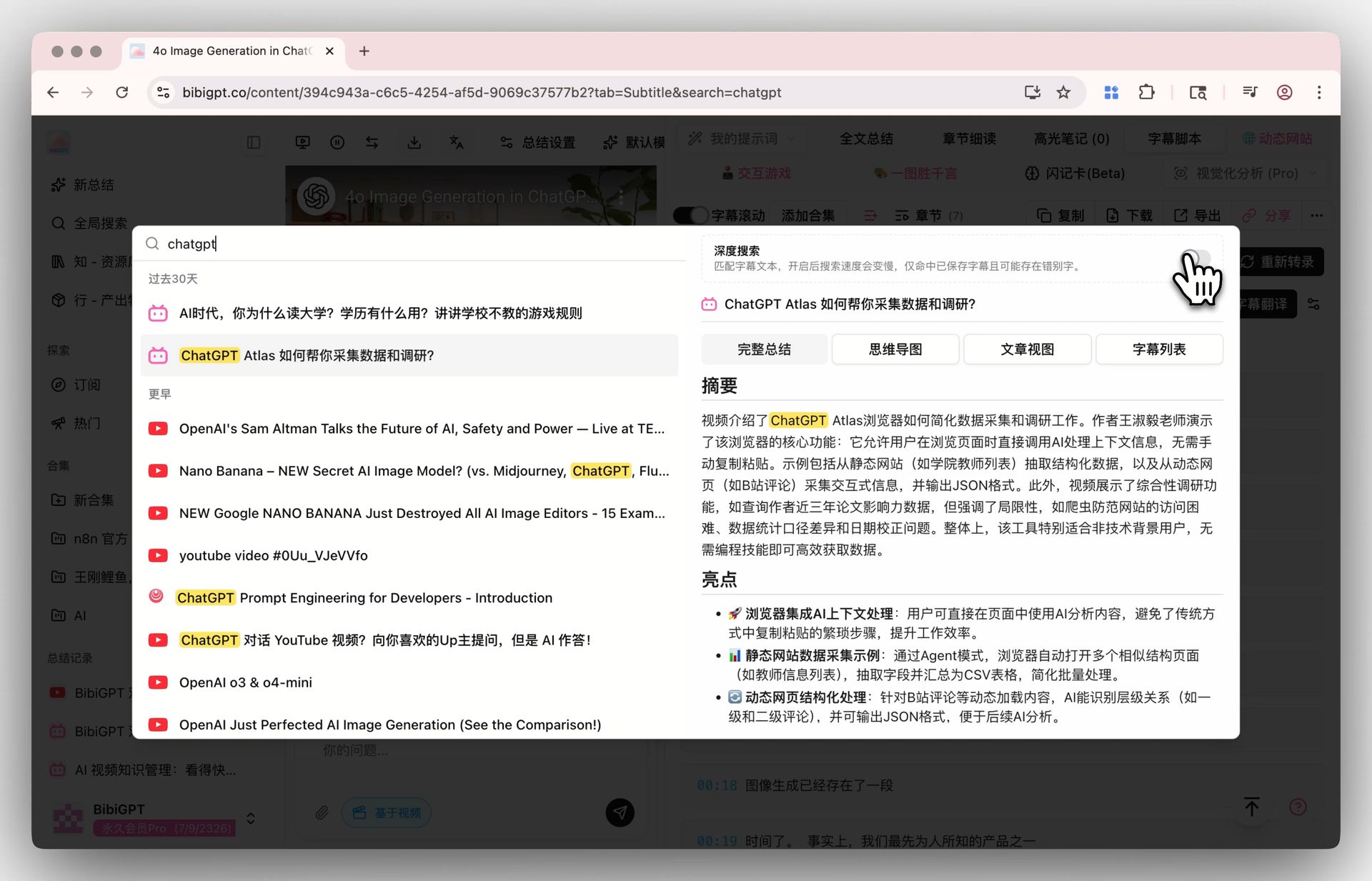

चरण 2: सर्च — Global Deep Search + Collection AI Chat

Global Search में डीप सर्च टॉगल फ़्लिप करें और आपका कीवर्ड रॉ ट्रांसक्रिप्ट हिट करता है, सिर्फ़ AI सारांश नहीं। इसे Collection Summary के साथ जोड़कर कई वीडियो को एक स्ट्रक्चर्ड ओवरव्यू में समेकित करें।

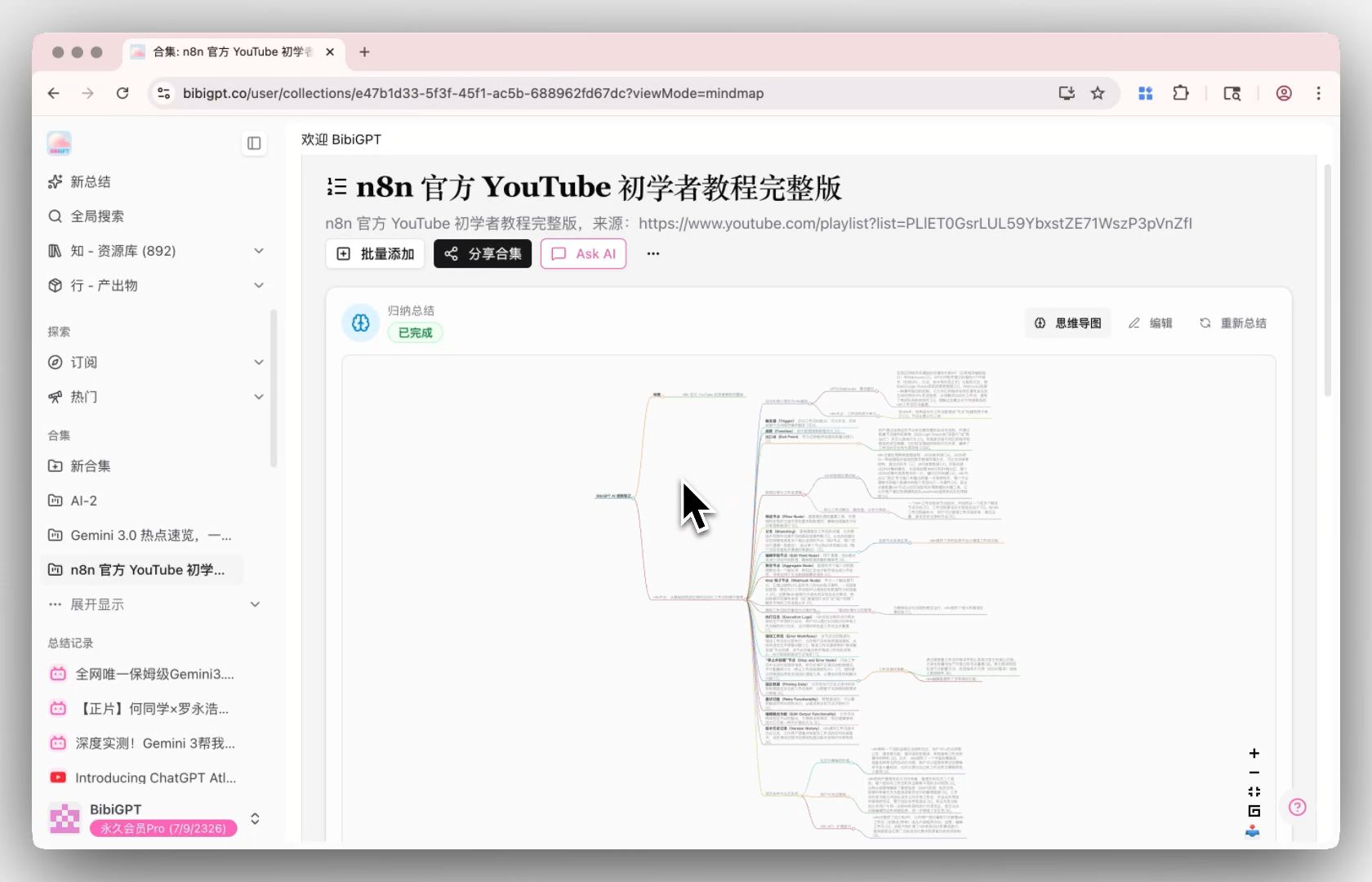

चरण 3: पूछें — Collection AI Chat में क्रॉस-वीडियो Q&A

Collection AI Chat कई वीडियो को एक संवादात्मक नॉलेज बेस में बदलता है — क्रॉस-वीडियो Q&A, तुलना, एकीकरण। “इन 10 लेक्चर्स में, इंस्ट्रक्टर्स Transformer attention पर कहाँ असहमत हैं?” पहले एक दोपहर ट्रांसक्रिप्ट पलटने में लगता था। अब एक प्रॉम्प्ट है।

पूरा वर्कफ़्लो:

- BibiGPT में वीडियो लिंक का बैच पेस्ट करें, उसे ऑटो-ट्रांसक्राइब + कीफ़्रेम-एक्सट्रैक्ट करने दें

- वीडियो को Collection में जोड़ें, “Summarize Now” पर क्लिक करें

- Collection AI Chat में कुछ भी पूछें — जवाब वीडियो के पार एकीकृत होते हैं

यह मूलतः “मल्टीमॉडल RAG, एंड यूज़र्स के लिए पैक किया गया” है। आप वेक्टर स्टोर को नहीं छूते, आप चंकिंग लॉजिक नहीं लिखते — आप बस लिंक पेस्ट करते हैं।

अगले छह महीनों में क्या होगा

- थर्ड-पार्टी RAG प्लेटफ़ॉर्म्स अपनाने में तेज़ी: 2026 H2 में “नेटिव मल्टीमॉडल वेक्टर स्टोर” लॉन्च की लहर की उम्मीद, सब Gemini Embedding 2 + प्रोप्राइटरी रीरैंकर पर बने

- वीडियो सर्च टूल्स में पीढ़ीगत विभाजन: ASR + टेक्स्ट एम्बेडिंग पर अटके प्रोडक्ट्स को डाउनग्रेड अटैक का सामना; माइग्रेशन कॉस्ट पूरी पाइपलाइन फिर से लिखना है

- लॉन्ग-टेल कंटेंट की पुनर्मूल्यांकन: YouTube, Bilibili, podcast होस्ट्स RAG वेंडर्स से “एम्बेडिंग लाइसेंस” चार्ज करना शुरू कर सकते हैं — एक बिज़नेस लाइन जो सिर्फ़-टेक्स्ट युग में नहीं थी

FAQ

Q1: मैं BibiGPT में पहले से ट्रांसक्रिप्ट सर्च कर सकता हूँ — मल्टीमॉडल एम्बेडिंग क्या जोड़ती है?

A: ट्रांसक्रिप्ट सर्च केवल “क्या बोला गया” को हिट करती है। मल्टीमॉडल एम्बेडिंग “क्या दिखाया गया” को हिट करती है — एक चार्ट जो कभी बताया नहीं गया, बैकग्राउंड म्यूज़िक का एक टुकड़ा, स्लाइड पर एक फ़ॉर्मूला। लर्निंग या टेक्निकल हेवी वीडियो के लिए, ऑन-स्क्रीन इन्फ़ॉर्मेशन डेंसिटी अक्सर कैप्शन से ज़्यादा होती है। मल्टीमॉडल रिट्रीवल वह छिपी वैल्यू सतह पर लाती है।

Q2: क्या Gemini Embedding 2 API महंगी है? क्या BibiGPT यूज़र्स को अपनी key चाहिए?

A: Google ने changelog के अनुसार Gemini Embedding 2 को text-embedding-1 के समान टियर में प्राइस किया, प्रति-टोकन बिल। BibiGPT पहले से model selector में Gemini मॉडल्स को वायर करता है। आम यूज़र्स को BYOK की ज़रूरत नहीं — मल्टीमॉडल रिट्रीवल सर्वर-साइड संभाला जाता है; यूज़र्स को सर्च रिज़ल्ट्स दिखते हैं।

Q3: यह अपना Pinecone/Qdrant + OpenAI एम्बेडिंग रोल करने से कैसे अलग है?

A: तीन परतें: (1) आप वेक्टर स्टोर ऑपरेट नहीं करते, (2) आप वीडियो चंकिंग + कीफ़्रेम पाइपलाइन नहीं बनाते, (3) आप तीन वेंडर API को क्रॉस-मॉडल रिज़ल्ट में नहीं सिलते। BibiGPT तीनों को एक प्रोडक्ट में पैक करता है — इनपुट URL है, आउटपुट सारांश + सर्च करने योग्य + चैट-तैयार। DIY लगभग 2-3 हफ़्ते की इंजीनियरिंग है; BibiGPT आउट-ऑफ़-द-बॉक्स है।

Q4: मल्टीमॉडल रिट्रीवल कितनी सटीक है?

A: Google Gemini API Changelog लॉन्च नोट्स के अनुसार, Gemini Embedding 2 क्रॉस-मॉडल रिट्रीवल बेंचमार्क्स पर पिछली पीढ़ी से लगभग 27% सुधार करती है। आंतरिक BibiGPT टेस्ट दिखाते हैं कि “फ़्रेम + ट्रांसक्रिप्ट” जॉइंट रिट्रीवल टॉप-3 रीकॉल को सिर्फ़-ट्रांसक्रिप्ट से ~35% ऊपर उठाता है — सबसे मज़बूत गेन्स टेक्निकल ट्यूटोरियल्स, लेक्चर्स और प्रोडक्ट डेमो पर।

Q5: क्या मल्टीमॉडल सर्च पाने के लिए मुझे BibiGPT में अपने पुराने वीडियो दोबारा प्रोसेस करने होंगे?

A: नहीं। कीफ़्रेम एक्सट्रैक्शन और वेक्टराइज़ेशन बैकग्राउंड में async चलते हैं। पुराना कंटेंट रिट्रीवल स्टैक अपग्रेड होते ही नए इंडेक्स में अपने आप रोल हो जाता है। मौजूदा यूज़र्स वास्तव में नए वीडियो से पहले नया इंडेक्स हिट करते हैं, इसलिए लंबे समय के यूज़र्स को पहले फ़ायदा होता है।

शुरू करें

- पहले से BibiGPT पर हैं → Global Search खोलें और एक फ़ज़ी-रीकॉल क्वेरी आज़माएँ

- नए हैं → BibiGPT आज़माएँ — कोई भी YouTube लिंक पेस्ट करें

- हेवी कंटेंट यूज़र → क्रॉस-वीडियो रिट्रीवल को रोज़ की आदत बनाने के लिए Collection Summary + Collection AI Chat स्टैक करें

BibiGPT Team