Gemini Embedding 2 стал мультимодальным: как BibiGPT раскрывает поиск по видео и аудио в 2026

Gemini Embedding 2 стал мультимодальным: как BibiGPT раскрывает поиск по видео и аудио в 2026

По состоянию на 2026-04-29. Все факты — из официального Google Gemini API Changelog.

Gemini Embedding 2 вышел в GA 2026-04-22, расширившись с «только текст» до текста / изображения / видео / аудио / PDF — все в одном векторном пространстве. Это означает, что один текстовый запрос теперь может искать по кадрам видео, аудио-фрагментам и скриншотам PDF без трёх отдельных пайплайнов. Это ровно та давняя проблема «помню, в видео это говорили, но в резюме этого нет», которую BibiGPT решает для пользователей. Ниже: что именно изменилось и трёхшаговый воркфлоу BibiGPT, который вводит новую возможность в работу уже сегодня.

Контекст: 18 месяцев от одномодальных к мультимодальным эмбеддингам

Google перевёл Gemini Embedding 2 из preview в GA 2026-04-22, сопроводив это обновлением API changelog. С учётом официального анонса хронология такая:

- 2024-08: первое поколение

text-embedding-004, только текст - 2025-09: Gemini Embedding 1 (мультиязычный текст) GA, 100+ языков

- 2026-02: Gemini Embedding 2 в preview, мультимодальность анонсирована

- 2026-04-22: GA-релиз, нативная поддержка 5 модальностей в едином векторном пространстве

Это первый раз, когда Google поместил эмбеддинги изображений / видео / аудио / PDF в тот же API и то же векторное пространство, что и текст. Поиск по видео по-старому означал: ASR в текст, потом vision-модель описывает кадры, потом два векторных хранилища согласуются реранкером — три пайплайна, три стратегии чанкинга, три статьи затрат и recall, который никогда не сходился. Gemini Embedding 2 сворачивает всё это в один API-вызов.

Глубокий анализ: три слоя влияния

Технологии: кросс-модальный поиск становится задачей модели, а не пайплайна

Инженерные усилия в legacy-поиске по видео уходили на «как привести видео к ищущейся единице». Gemini Embedding 2 опускает это в слой модели:

| Старый подход | Gemini Embedding 2 |

|---|---|

| ASR → LLM-резюме → текстовый эмбеддинг | Эмбеддинг аудио-чанков напрямую |

| Vision-модель описывает → текстовый эмбеддинг | Эмбеддинг ключевых кадров напрямую |

| Три отдельных векторных хранилища | Одно общее векторное пространство |

| Кросс-модальный recall требует реранкера | Нативное косинусное сходство сравнимо |

Практический эффект: P95-латентность для «пользователь печатает фразу — находит видео» падает с минут до секунд, и больше не нужно транскрибировать, чтобы начать искать.

Рынок: вендоры RAG получают «окно переписать дно стека»

В 2025 году большинство RAG-платформ всё ещё держали текстовый и графический индексы раздельно. Gemini Embedding 2 делает «нативно мультимодальное векторное хранилище» обязательным минимумом в течение полугода. Вендоры, которые быстрее всех освоят мультимодальный эмбеддинг, удержат окно в 12-18 месяцев на продуктах поиска по контенту; отстающие будут вынуждены переписывать стек поиска во второй половине 2026 года. Темп выглядит так же, как когда после GPT-4 в 2023 каждому продукту пришлось прикручивать LLM.

Экосистема: разблокируется длинный хвост ценности контентных платформ

YouTube, Bilibili, подкастные сети накопили десятилетие видео. Главная потеря ценности — не «никто не смотрит», а никто не может точно искать. Gemini Embedding 2 впервые делает «помню, автор упоминал X где-то на 20-й минуте» извлекаемым. Для авторов — спящий трафик старых видео возвращается; для зрителей «смотреть, чтобы учиться» перестаёт быть пассивным и становится управляемым запросом.

Что это значит для пользователей BibiGPT

Авторам: старые видео переоткрыты

Детали, которые никогда не попадали в Ваше резюме, становятся ищущимися. После импорта видео в BibiGPT глобальный глубокий поиск уже бьёт по сырым транскрипциям; добавление мультимодального эмбеддинга поверх даёт поиск на уровне кадра — ту схему, которую Вы показали, но не озвучили.

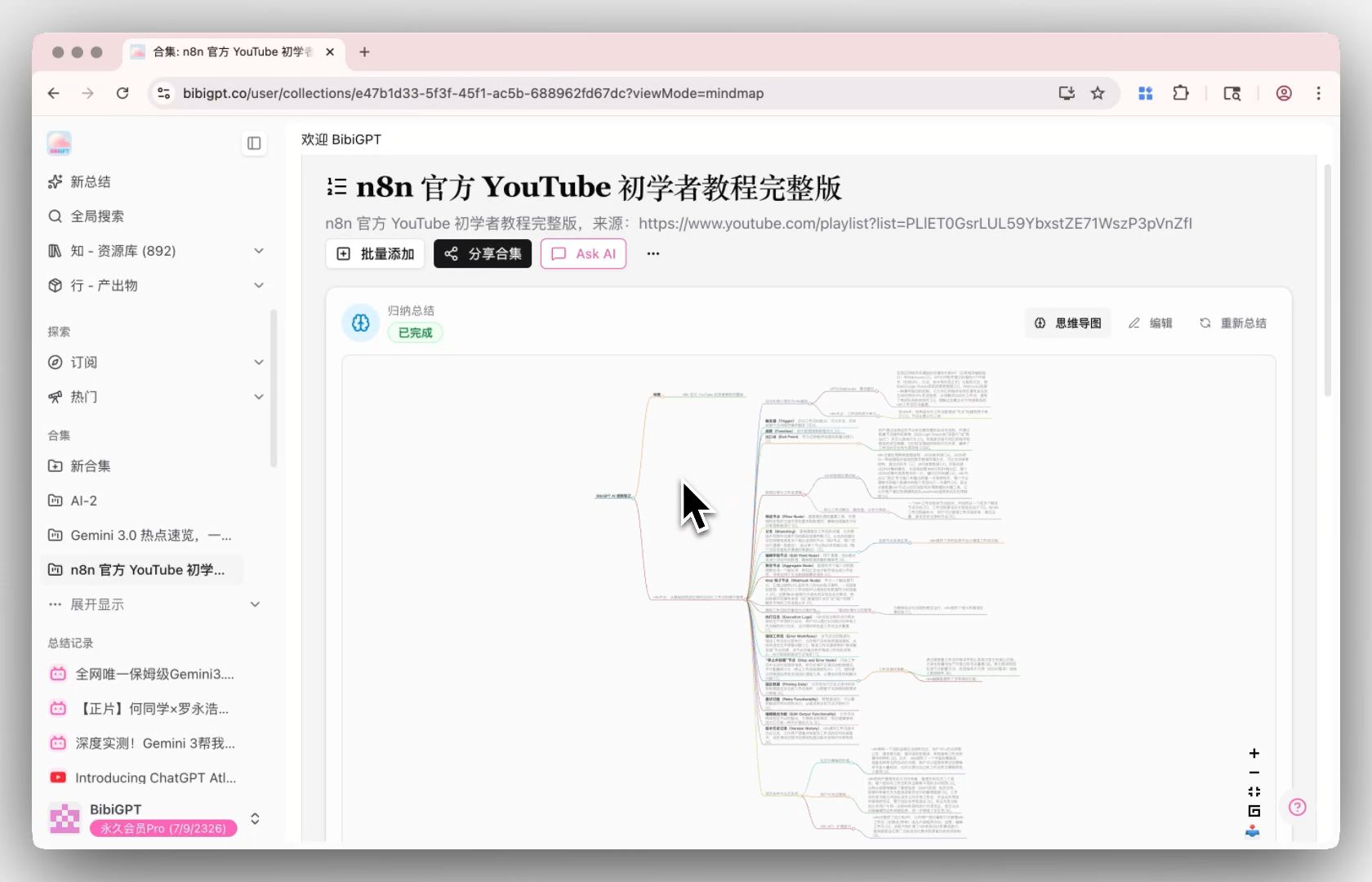

Студентам и исследователям: кросс-видео графы знаний

Десять учебных видео, пять подкастов, три PDF-конспекта — раньше Вы индексировали их раздельно и сводили вручную. Воркфлоу Сводка коллекции + чат коллекции внутри BibiGPT уже построен вокруг кросс-контентного поиска. Мультимодальные эмбеддинги превращают «найди лекцию, где появилась та диаграмма» из роскоши в рутину.

Корпорациям: внутренние видеоактивы становятся ищущимися

Записи совещаний, обучающие видео, демо продуктов — исторически мёртвый запас. Мультимодальные эмбеддинги + пакетная обработка BibiGPT означают, что внутренняя база знаний наконец сможет покрывать документы, видео и аудио в одном поиске.

Воркфлоу BibiGPT: Gemini Embedding 2 в трёх шагах

Шаг 1. Загрузка — пусть BibiGPT автоматически транскрибирует и извлекает ключевые кадры

Вставьте ссылку YouTube / Bilibili в BibiGPT. Система автоматически транскрибирует, вытягивает ключевые кадры и выдаёт структурированное резюме. Этот шаг разбивает длинное видео на минимальные ищущиеся единицы.

Анализ скриншотов ключевых кадров уже поддерживает шесть vision-моделей, включая Gemini 3.0 Flash и Qwen3.5 Omni Plus. Они понимают графики, блоки кода и содержимое слайдов внутри кадра — ровно тот вход, под который мультимодальные эмбеддинги и были спроектированы.

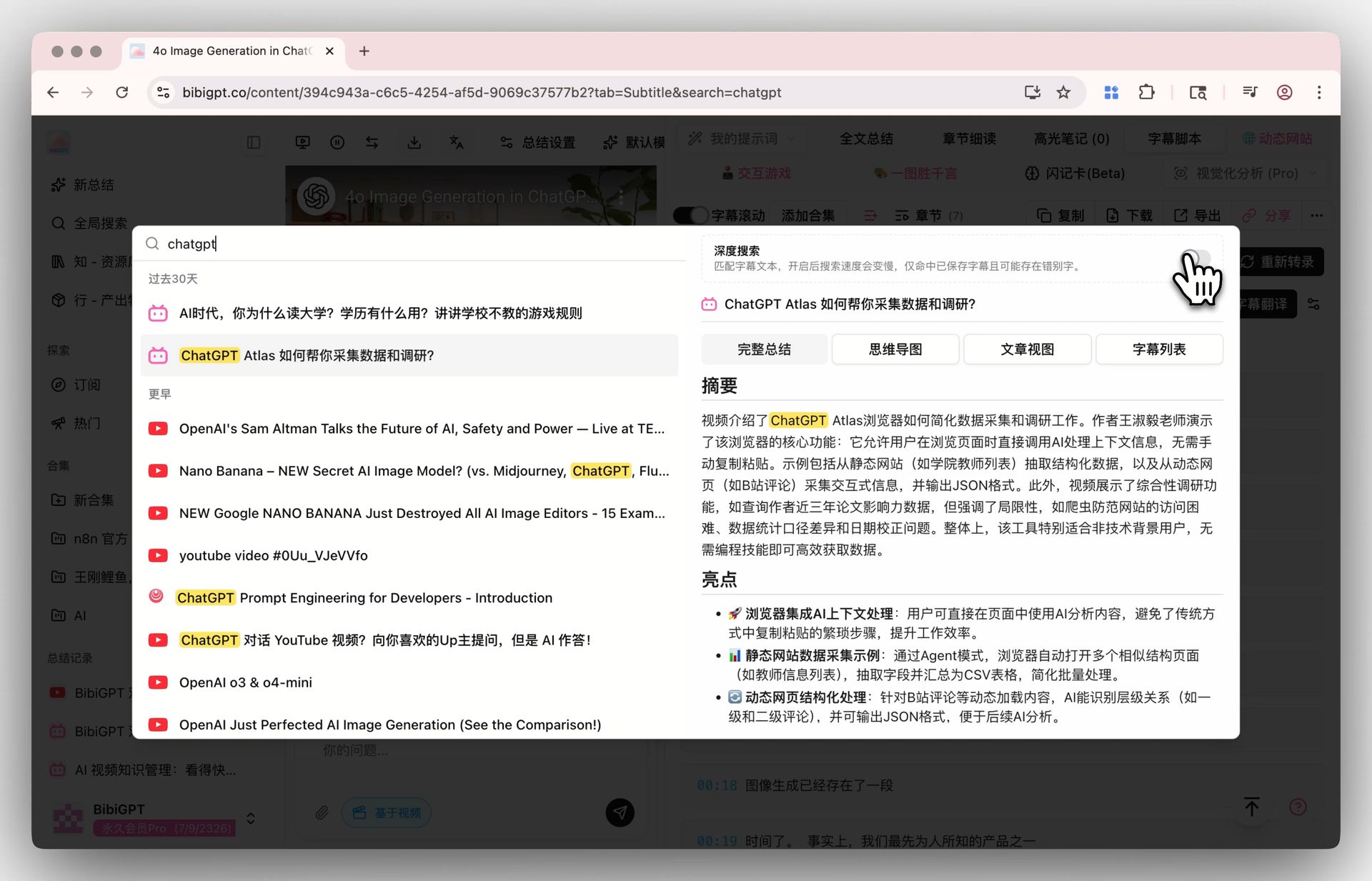

Шаг 2. Поиск — глобальный глубокий поиск + чат коллекции

Включите переключатель глубокого поиска в глобальном поиске, и Ваше ключевое слово ударит по сырой транскрипции, а не только по ИИ-резюме. Скомбинируйте с Сводкой коллекции, чтобы свести несколько видео в один структурированный обзор.

Шаг 3. Спрашивайте — кросс-видео Q&A в чате коллекции

Чат коллекции превращает несколько видео в одну разговорную базу знаний — кросс-видео Q&A, сравнение, интеграция. «По этим 10 лекциям — где преподаватели расходятся в трактовке Transformer-внимания?» раньше требовало вечера перелистывания транскрипций. Теперь — один запрос.

Полный воркфлоу:

- Вставьте партию ссылок видео в BibiGPT, дайте автоматически транскрибировать + извлечь ключевые кадры

- Добавьте видео в коллекцию, нажмите «Суммировать сейчас»

- Спрашивайте что угодно в чате коллекции — ответы интегрируются между видео

По сути это «мультимодальный RAG, упакованный для конечных пользователей». Вы не трогаете векторное хранилище, не пишете логику чанкинга — просто вставляете ссылки.

Что произойдёт за следующие полгода

- Сторонние RAG-платформы ускоряют адопцию: ждите волны запусков «нативно мультимодальных векторных хранилищ» во второй половине 2026 года, все на Gemini Embedding 2 + проприетарном реранкере

- Жёсткий поколенческий разрыв в инструментах поиска по видео: продукты, всё ещё на ASR + текстовых эмбеддингах, столкнутся с downgrade-атакой; стоимость миграции — переписывание всего пайплайна

- Длинный хвост контента переоценивается: YouTube, Bilibili, хостинги подкастов могут начать брать с RAG-вендоров «лицензии на эмбеддинги» — статья доходов, которой не существовало в эпоху «только текст»

FAQ

Q1: Я уже могу искать по транскрипциям в BibiGPT — что добавляет мультимодальный эмбеддинг?

A: Поиск по транскрипции бьёт только по «что было сказано». Мультимодальный эмбеддинг бьёт по «что показано» — графику, который никогда не комментировали; куску фоновой музыки; формуле на слайде. Для учебного и технического видео плотность экранной информации часто превышает то, что несут субтитры. Мультимодальный поиск вытаскивает эту скрытую ценность.

Q2: Дорогой ли API Gemini Embedding 2? Нужен ли пользователям BibiGPT свой ключ?

A: Google по changelog поставил Gemini Embedding 2 в тот же тариф, что и text-embedding-1 — оплата по токенам. BibiGPT уже подключил модели Gemini в селекторе моделей. Обычным пользователям не нужно нести свой ключ — мультимодальный поиск обрабатывается на стороне сервера, пользователь видит результаты поиска.

Q3: Чем это отличается от своего Pinecone/Qdrant + эмбеддингов OpenAI?

A: Три слоя: (1) Вы не эксплуатируете векторное хранилище, (2) Вы не строите пайплайн чанкинга видео + извлечения ключевых кадров, (3) Вы не сшиваете три вендорских API в кросс-модальный результат. BibiGPT упаковывает всё это в один продукт — вход URL, выход — резюме + поиск + чат. DIY — примерно 2-3 недели разработки; BibiGPT — из коробки.

Q4: Насколько точен мультимодальный поиск?

A: По заметкам запуска в Google Gemini API Changelog, Gemini Embedding 2 улучшает бенчмарки кросс-модального поиска примерно на 27% по сравнению с предыдущим поколением. Внутренние тесты BibiGPT показывают: совместный поиск «кадр + транскрипция» поднимает top-3 recall примерно на 35% по сравнению с поиском только по транскрипции — самый сильный прирост на технических туториалах, лекциях и демо продуктов.

Q5: Нужно ли переобрабатывать старые видео в BibiGPT, чтобы получить мультимодальный поиск?

A: Нет. Извлечение ключевых кадров и векторизация выполняются асинхронно в фоне. Старый контент автоматически попадает в новый индекс по мере обновления стека поиска. Существующие пользователи фактически попадают в новый индекс раньше новых видео — так что давние пользователи получают выгоду первыми.

Начните

- Уже на BibiGPT → откройте глобальный поиск и попробуйте размытый запрос

- Вы новичок → Попробуйте BibiGPT — вставьте любую ссылку YouTube

- Тяжёлый пользователь контента → совместите Сводку коллекции + чат коллекции, сделав кросс-видео поиск ежедневной привычкой

BibiGPT Team