Gemini Embedding 2 staje się multimodalny: jak BibiGPT wykorzystuje wyszukiwanie wideo i audio w 2026

Gemini Embedding 2 staje się multimodalny: jak BibiGPT wykorzystuje wyszukiwanie wideo i audio w 2026

Stan na 2026-04-29. Wszystkie fakty pochodzą z oficjalnego Google Gemini API Changelog.

Gemini Embedding 2 osiągnął GA 2026-04-22, rozszerzając się z text-only na text/image/video/audio/PDF — wszystkie dzielące tę samą przestrzeń wektorową. Oznacza to, że pojedyncze tekstowe zapytanie może teraz pobierać wyniki z klatek wideo, fragmentów audio i screenshotów PDF bez trzech osobnych pipeline’ów. To dokładnie ten długoletni problem „pamiętam, że wideo to powiedziało, ale nie ma tego w streszczeniu”, który BibiGPT rozwiązuje dla użytkowników. Poniżej: co faktycznie się zmieniło i trzy-stopniowy workflow BibiGPT, który wykorzystuje nową możliwość już dziś.

Tło: 18 miesięcy od jednomodalnych do multimodalnych embeddings

Google przeniosło Gemini Embedding 2 z preview do GA 2026-04-22, w towarzystwie aktualizacji API changelog. W połączeniu z oficjalnym ogłoszeniem oto oś czasu:

- 2024-08: Pierwsza generacja

text-embedding-004rusza, tylko tekst - 2025-09: Gemini Embedding 1 (wielojęzyczny tekst) GA, 100+ języków

- 2026-02: Gemini Embedding 2 wchodzi w preview, multimodalność w preview

- 2026-04-22: Wydanie GA, natywne wsparcie 5 modalności w wspólnej przestrzeni wektorowej

To pierwszy raz, gdy Google umieszcza embeddings obrazu/wideo/audio/PDF w tym samym API i tej samej przestrzeni wektorowej co tekst. Robienie wyszukiwania wideo po staremu oznaczało ASR-na-tekst, potem model wizyjny opisujący klatki, potem dwa magazyny wektorów uzgadniane przez reranker — trzy pipeline’y, trzy strategie chunkingu, trzy linie kosztów i recall, który nigdy zupełnie się nie zgadzał. Gemini Embedding 2 sprowadza to do jednego wywołania API.

Głęboka analiza: trzy warstwy wpływu

Techniczna: cross-modalny retrieval staje się problemem modelu, nie problemem pipeline’u

Wysiłek inżynieryjny w starszym video retrieval polegał na „jak dopasować wideo w jednostkę podlegającą wyszukiwaniu”. Gemini Embedding 2 spycha to do warstwy modelu:

| Stare podejście | Gemini Embedding 2 |

|---|---|

| ASR → streszczenie LLM → text embedding | Embed audio chunks bezpośrednio |

| Caption modelu wizyjnego → text embedding | Embed kluczowych klatek bezpośrednio |

| Trzy oddzielne magazyny wektorów | Jedna wspólna przestrzeń wektorowa |

| Cross-modalny recall potrzebuje rerankera | Natywne podobieństwo cosinus jest porównywalne |

Praktyczny wpływ: P95 latency dla „użytkownik wpisuje jedno zdanie, by znaleźć wideo” spada z minut do sekund i nie musisz już transkrybować, zanim zaczniesz pobierać.

Rynkowa: dostawcy RAG mają okno „przepisz dno stosu”

W 2025 większość platform RAG nadal trzymała indeksy tekstu i obrazu osobno. Gemini Embedding 2 sprawia, że „natywnie multimodalny magazyn wektorów” staje się standardem w ciągu sześciu miesięcy. Dostawcy, którzy najpierw dobrze zrobią multimodalny embedding utrzymają 12-18-miesięczne okno na produktach pobierania treści; spóźnialscy będą zmuszeni przepisać swój stos retrieval w 2026 H2. Tempo wygląda identycznie jak to, w którym każdy produkt musiał doczepić LLM po GPT-4 w 2023.

Ekosystemowa: długoogonowa wartość platform treściowych zostaje odblokowana

YouTube, Bilibili, sieci podcastowe zgromadziły dekadę wideo. Największa utrata wartości to nie „nikt nie ogląda”, ale nikt nie umie precyzyjnie wyszukać. Gemini Embedding 2 sprawia, że „pamiętam, że twórca wspomniał o X koło 20 minuty” jest po raz pierwszy wyszukiwalne. Dla twórców uśpiony ruch na starych filmach wraca; dla konsumentów „oglądanie, by się uczyć” przestaje być bierne i staje się napędzane zapytaniem.

Co to znaczy dla użytkowników BibiGPT

Dla twórców: stare wideo odkryte na nowo

Szczegóły, które nigdy nie trafiły do twojego streszczenia, stają się wyszukiwalne. Po zaimportowaniu wideo do BibiGPT, Global Deep Search już trafia w surowe transkrypcje; nałożenie multimodalnego embeddingu na wierzch dodaje pobieranie na poziomie klatek — wykres, który pokazałeś, ale nigdy nie omówiłeś.

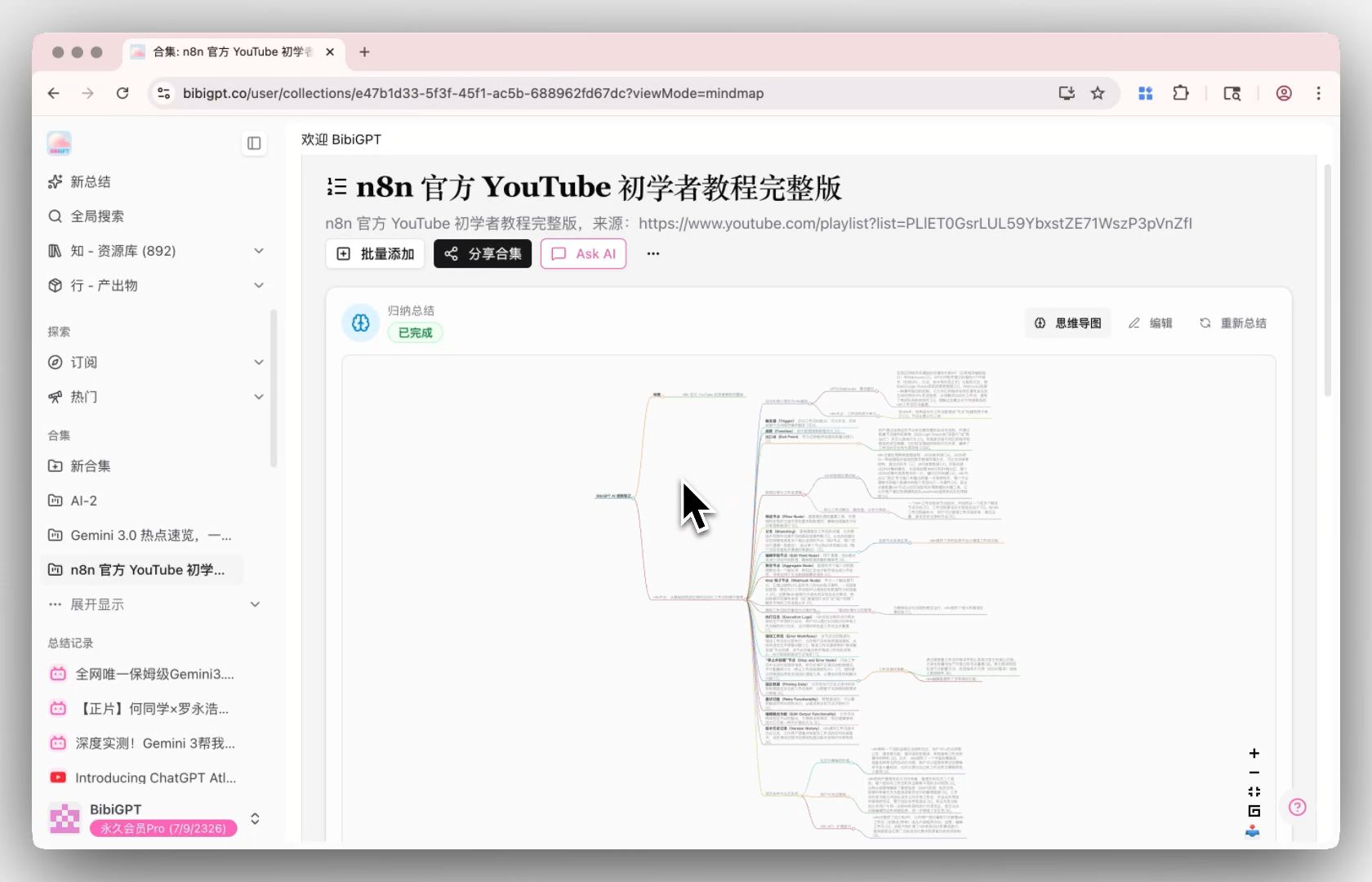

Dla studentów i badaczy: cross-wideo grafy wiedzy

Dziesięć filmów z kursu, pięć podcastów, trzy materiały PDF — wcześniej indeksowałeś je osobno i uzgadniałeś ręcznie. Workflow Collection Summary + Collection AI Chat wewnątrz BibiGPT był już zbudowany wokół cross-content retrieval. Multimodalne embeddings zamieniają „znajdź wykład, na którym pojawił się ten diagram” z luksusu w rutynę.

Dla firm: wewnętrzne aktywa wideo stają się przeszukiwalne

Nagrania spotkań, filmy szkoleniowe, dema produktów — historycznie martwy zapas. Multimodalne embeddings + wsadowe przetwarzanie BibiGPT oznaczają, że wewnętrzna baza wiedzy może wreszcie objąć dokumenty, wideo i audio w jednym wyszukiwaniu.

Workflow BibiGPT: maksymalne wykorzystanie Gemini Embedding 2 w trzech krokach

Krok 1: Wczytanie — pozwól BibiGPT auto-transkrybować i wyciągnąć kluczowe klatki

Wklej link YouTube/Bilibili do BibiGPT. System auto-transkrybuje, ciągnie kluczowe klatki i produkuje ustrukturyzowane streszczenie. Ten krok rozdziera długie wideo na najmniejszą wyszukiwalną jednostkę.

Keyframe Screenshot Analysis wspiera już sześć modeli wizyjnych włącznie z Gemini 3.0 Flash i Qwen3.5 Omni Plus. Rozumieją wykresy, bloki kodu i treść slajdów wewnątrz klatki — dokładnie ten rodzaj inputu, dla którego zaprojektowano multimodalne embeddings.

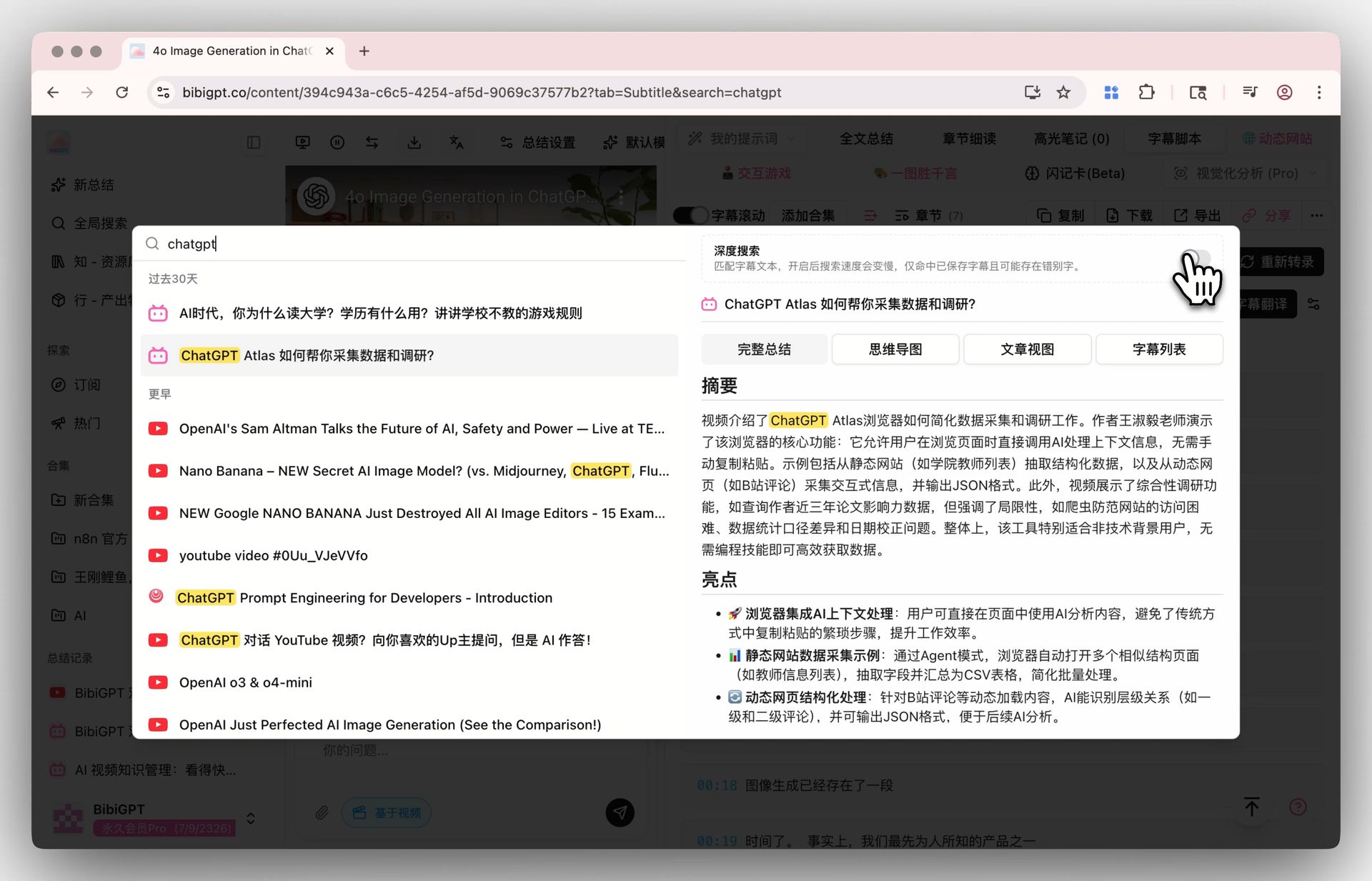

Krok 2: Wyszukiwanie — Global Deep Search + Collection AI Chat

Włącz przełącznik deep search w Global Search, a twoje słowo kluczowe trafi w surową transkrypcję, nie tylko w streszczenia AI. Sparuj to z Collection Summary, by skonsolidować wiele filmów w jeden ustrukturyzowany przegląd.

Krok 3: Pytaj — cross-wideo Q&A w Collection AI Chat

Collection AI Chat zamienia wiele filmów w jedną konwersacyjną bazę wiedzy — cross-wideo Q&A, porównanie, integracja. „W tych 10 wykładach, gdzie wykładowcy się różnią co do uwagi w Transformerach?” zajmowało popołudnie wertowania transkrypcji. Teraz to jeden prompt.

Pełny workflow:

- Wklej wsad linków wideo do BibiGPT, pozwól mu auto-transkrybować + wyciągnąć kluczowe klatki

- Dodaj filmy do kolekcji, kliknij „Streszczaj teraz”

- Pytaj o wszystko w Collection AI Chat — odpowiedzi integrują się cross-wideo

To w istocie „multimodalny RAG, zapakowany dla użytkowników końcowych”. Nie dotykasz magazynu wektorów, nie piszesz logiki chunkingu — po prostu wklejasz linki.

Co stanie się w ciągu najbliższych sześciu miesięcy

- Platformy RAG firm trzecich przyspieszają adopcję: Spodziewaj się fali launchy „natywnie multimodalnego magazynu wektorów” w 2026 H2, wszystkie zbudowane na Gemini Embedding 2 + autorskim rerankerze

- Twardy generacyjny rozłam w narzędziach do wyszukiwania wideo: Produkty wciąż na ASR + tekstowych embeddings stają w obliczu downgrade attack; koszt migracji to przepisanie całego pipeline’u

- Treści długoogonowe zostaną przewartościowane: YouTube, Bilibili, hosty podcastowe mogą zacząć pobierać od dostawców RAG „licencje na embedding” — linia biznesowa, która nie istniała w erze tylko-tekstu

FAQ

Q1: Mogę już wyszukiwać transkrypcje w BibiGPT — co dodaje multimodalny embedding?

A: Wyszukiwanie transkrypcji trafia tylko w „to, co zostało powiedziane”. Multimodalny embedding trafia w „to, co jest pokazane” — wykres nigdy nie omówiony, fragment muzyki w tle, formuła na slajdzie. Dla filmów uczących lub technicznych gęstość informacji na ekranie często przekracza to, co niosą napisy. Multimodalne pobieranie wydobywa tę ukrytą wartość.

Q2: Czy Gemini Embedding 2 API jest drogie? Czy użytkownicy BibiGPT potrzebują własnego klucza?

A: Google wycenił Gemini Embedding 2 w tej samej taryfie co text-embedding-1 zgodnie z changelogiem, rozliczane per token. BibiGPT już ma podpięte modele Gemini w selektorze modeli. Casualni użytkownicy nie potrzebują BYOK — multimodalne pobieranie odbywa się po stronie serwera; użytkownicy widzą wyniki wyszukiwania.

Q3: Czym to się różni od własnego Pinecone/Qdrant + OpenAI embeddings?

A: Trzy warstwy: (1) nie operujesz magazynem wektorów, (2) nie budujesz pipeline’u chunkingu wideo + kluczowych klatek, (3) nie zszywasz trzech API dostawców w cross-modalny wynik. BibiGPT pakuje wszystkie trzy w jeden produkt — wejście to URL, wyjście to streszczenie + wyszukiwalne + gotowe do czatu. DIY to z grubsza 2-3 tygodnie inżynierii; BibiGPT jest out-of-the-box.

Q4: Jak dokładny jest multimodalny retrieval?

A: Według notatek launchu z Google Gemini API Changelog, Gemini Embedding 2 poprawia benchmarki cross-modalnego retrieval o około 27% nad poprzednią generacją. Wewnętrzne testy BibiGPT pokazują, że wspólne pobieranie „klatka + transkrypcja” podnosi top-3 recall o ~35% wobec samej transkrypcji — najsilniejsze zyski na tutorialach technicznych, wykładach i demach produktowych.

Q5: Czy muszę przetworzyć ponownie moje stare filmy w BibiGPT, by dostać multimodalne wyszukiwanie?

A: Nie. Wyciąganie kluczowych klatek i wektoryzacja działają async w tle. Stare treści wpadają do nowego indeksu automatycznie, gdy stos retrieval się aktualizuje. Istniejący użytkownicy faktycznie trafiają w nowy indeks przed nowymi filmami, więc długoletni użytkownicy korzystają pierwsi.

Zacznij

- Już na BibiGPT → otwórz Global Search i wypróbuj zapytanie z fuzzy-recall

- Nowy tutaj → Wypróbuj BibiGPT — wklej dowolny link YouTube

- Heavy content user → ułóż Collection Summary + Collection AI Chat, by uczynić cross-wideo retrieval codziennym nawykiem

BibiGPT Team