Gemini Embedding 2 多模态来了:BibiGPT 视频音频检索如何把它用满

Gemini Embedding 2 多模态来了:BibiGPT 视频音频检索如何把它用满

截至 2026 年 4 月 29 日,本文事实基于 Google Gemini API Changelog 公开信息整理。

Gemini Embedding 2 在 2026-04-22 GA,最大变化是把”嵌入”从纯文本扩展到文本/图像/视频/音频/PDF 五种模态,且共享同一向量空间。 这意味着你可以用一句话在视频帧、音频片段、PDF 截图之间做跨模态检索——这正是 BibiGPT 长期以来想给用户解决的”我记得视频里讲过这个,可摘要里没写”问题。这篇文章先讲清楚 Embedding 2 到底变了什么,再给出在 BibiGPT 里把它用满的三步工作流。

事件背景:从单模态到多模态嵌入的 18 个月

Google 2026-04-22 把 Gemini Embedding 2 从 preview 推到 GA,同一天更新了 API changelog。结合官方公告,时间线如下:

- 2024-08:第一代

text-embedding-004上线,仅支持纯文本 - 2025-09:Gemini Embedding 1(多语言文本)GA,支持 100+ 语言

- 2026-02:Gemini Embedding 2 进入 preview,首次预告多模态

- 2026-04-22:GA 正式发布,原生支持 5 种模态共享同一向量空间

这是 Google 第一次把”图像/视频/音频/PDF 嵌入”和文本嵌入放进同一个 API、同一个向量空间。过去如果你想做视频检索,得先调用 ASR 转文字、再调用视觉模型描述画面、最后两份向量分别落库——三套基础设施、三套 chunk 策略、三份成本,召回还很难对齐。Gemini Embedding 2 把这件事压成一次 API 调用。

深度分析:三层影响

技术影响:跨模态检索从”管线工程”变成”模型问题”

传统视频检索的工程量集中在”如何把视频对齐成一个可检索单位”。Gemini Embedding 2 把这件事下沉到模型层:

| 传统方案 | Gemini Embedding 2 |

|---|---|

| ASR + LLM 摘要 → 文本嵌入 | 直接对音频片段嵌入 |

| 视觉模型描述 → 文本嵌入 | 直接对关键帧嵌入 |

| 三套向量分别落库 | 同一向量空间 |

| 跨模态召回需要 reranker 拉齐 | 原生 cosine 相似度可比 |

实际意义是:把”用户用一句话搜视频”的 P95 延迟从分钟级压到秒级,且不再需要先转录就能开始检索。

市场影响:RAG 厂商面临”重写底层”的窗口

2025 年大部分 RAG 平台还停留在”文本 + 图像分库索引”。Gemini Embedding 2 让”原生多模态向量库”在六个月内成为标配。先把多模态嵌入做对的厂商,会在内容检索类产品上拿到 12-18 个月的窗口期;慢一拍的,会被迫在 2026 H2 重写检索栈。这个节奏跟 2023 GPT-4 出来后所有产品被迫接 LLM 是一样的。

生态影响:内容平台的”长尾价值”被解锁

YouTube、B 站、播客平台过去十年沉淀的视频,最大的价值损失不是没人看,而是没人能精准搜到。Gemini Embedding 2 让”我记得某位 UP 主在某个时间点讲过 X”这种模糊查询第一次有了工程上可行的解法。对内容创作者,这意味着旧视频的搜索流量会重新被激活;对消费者,意味着”看视频学知识”从”被动观看”变成”主动检索”。

对 BibiGPT 用户的实际意义

对内容创作者:旧视频被重新发现

你过去做的视频,摘要里没写到的细节会变得可搜。把视频导入 BibiGPT 后,全局深度搜索 已经能命中字幕原文;接下来叠加多模态嵌入,连”画面里出现过某个图表”的检索都能做到。

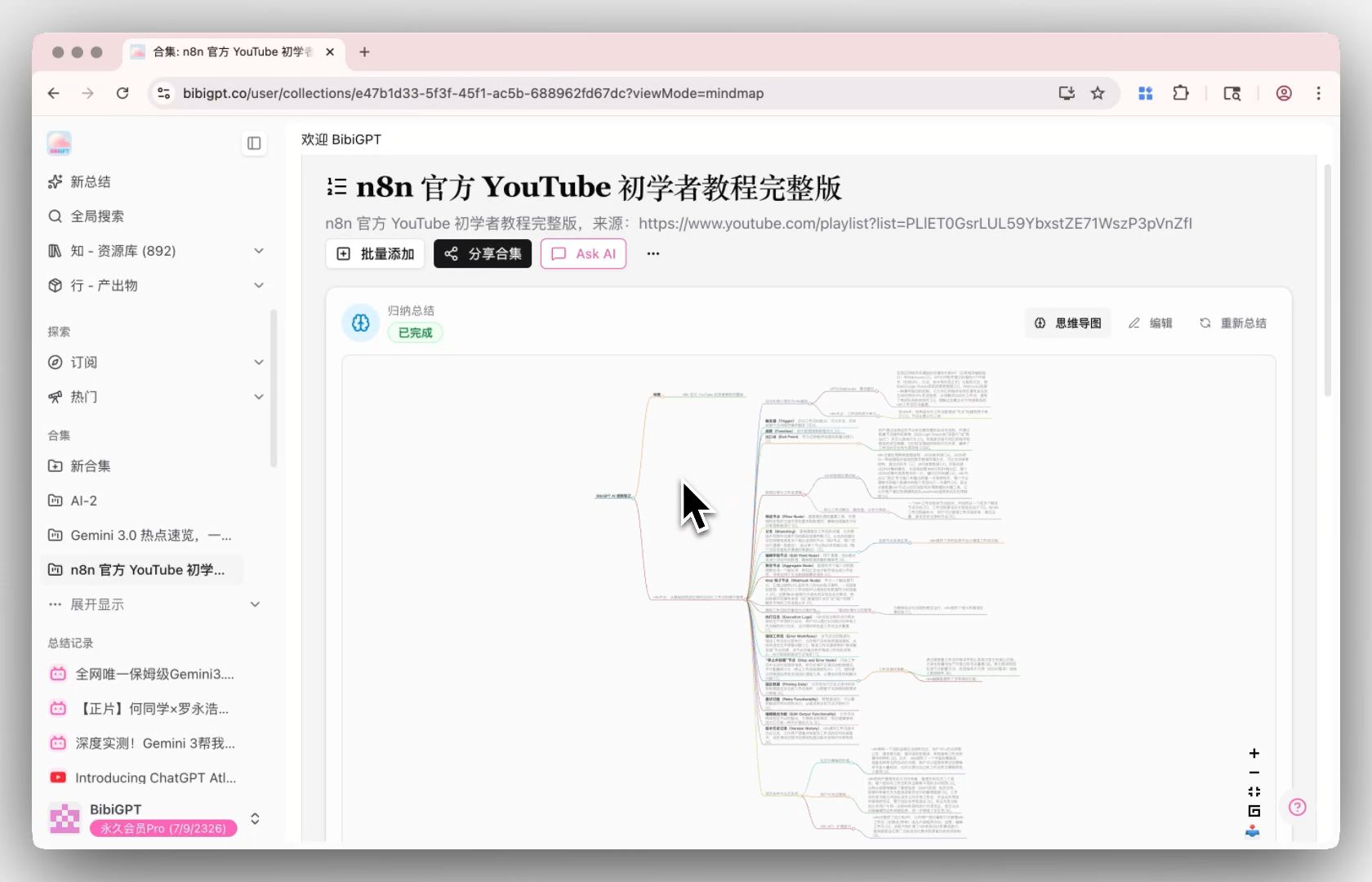

对学生 / 研究者:跨视频知识图谱可落地

10 节网课 + 5 个补充播客 + 3 篇 PDF 讲义,过去要分别索引、手动对照。在 BibiGPT 的 合集归纳总结 + 合集 AI 对话 工作流里,跨内容检索本来就是核心能力。多模态嵌入让”找某张图所在的那一节课”这种查询从奢侈变成日常。

对企业用户:内部音视频资产可被检索

会议录音、培训视频、产品演示——过去全是”沉睡资产”。多模态嵌入 + BibiGPT 的批量处理能力,意味着”内部知识库”第一次可以同时覆盖文档、视频、音频。

BibiGPT 实战搭配:三步把 Gemini Embedding 2 用满

步骤 1:导入 → 用 BibiGPT 自动转录与关键帧提取

把 YouTube/B 站链接粘贴到 BibiGPT,系统会自动完成 ASR、关键帧抽取和结构化摘要。这一步把”长视频”切成可检索的最小单元。

截图关键帧分析 已经支持 Gemini 3.0 Flash、Qwen3.5 Omni Plus 等 6 个视觉模型,可以理解画面里的图表、代码、PPT 内容——这正是多模态嵌入最适合的输入。

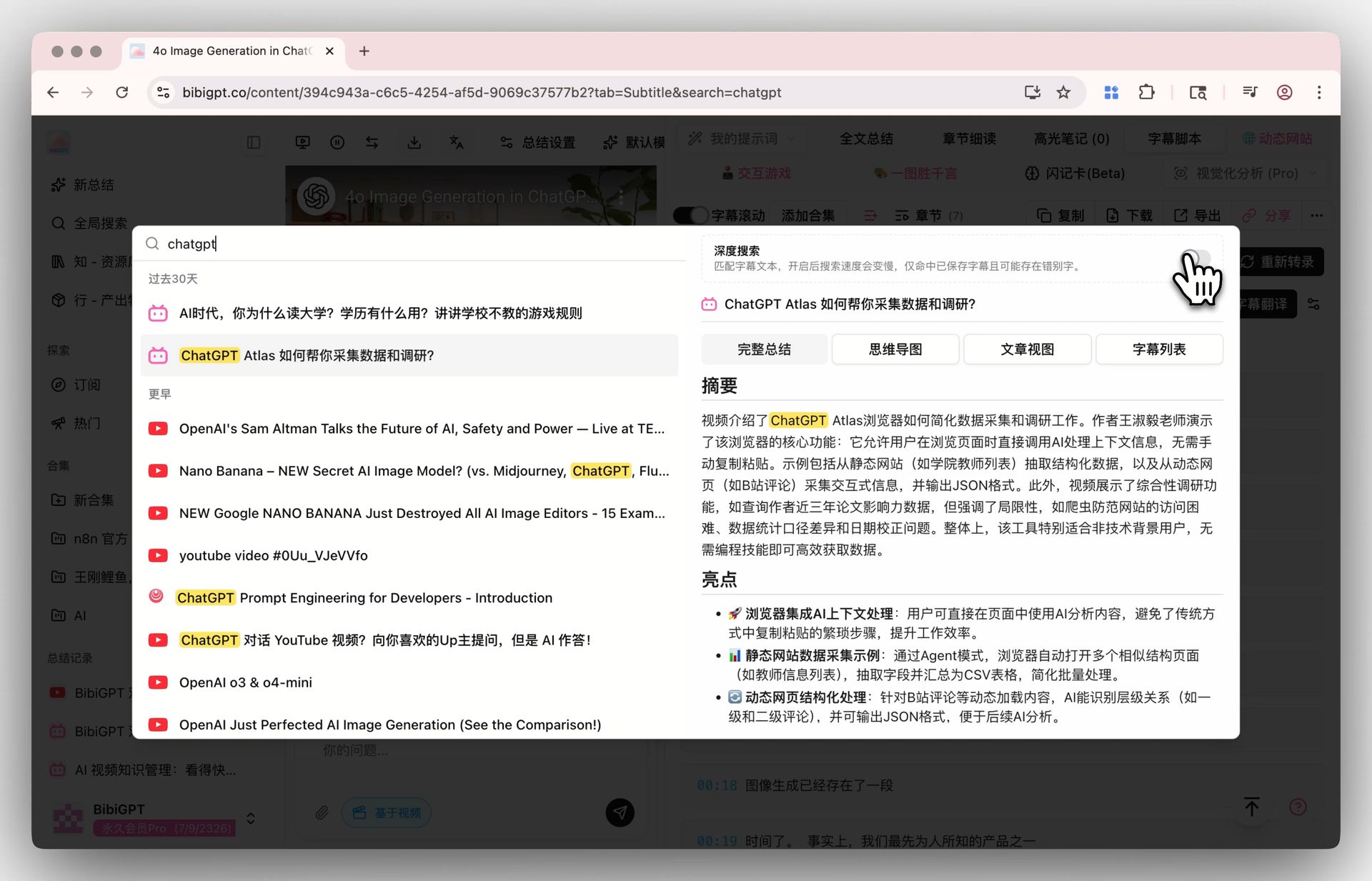

步骤 2:检索 → 全局深度搜索 + 合集 AI 对话

打开 全局搜索的”深度搜索”开关,关键词会直接命中视频字幕原文,而不只是 AI 摘要。配合 合集归纳总结,可以把多个视频的内容汇总到同一份结构化综述里。

步骤 3:追问 → 在合集 AI 对话里跨视频提问

合集 AI 对话 把多个视频整合成一个可对话的知识库,支持跨视频问答、对比、信息整合。比如”这 10 节课里,老师对 Transformer attention 的解释有没有不一致的地方?“——这种查询过去要逐个视频翻字幕,现在一次回答。

完整工作流:

- 粘贴一批视频链接到 BibiGPT,等待自动转录 + 关键帧提取

- 把视频加进同一个合集,点击「立即总结」

- 在合集 AI 对话中提问,AI 会跨视频整合答案

这套组合本质上就是”为用户预先封装好的多模态 RAG”——你不需要懂向量库、不需要写 chunk 逻辑,只要把链接喂给 BibiGPT。

前景预测:未来 6 个月会发生什么

- 第三方 RAG 平台会加速接入:2026 H2 会有一波”原生多模态向量库”的产品发布,标配是 Gemini Embedding 2 + 自家 reranker

- 视频检索类工具会出现”前后两代”分水岭:还在用 ASR + 文本嵌入的产品会被新方案降维打击,迁移成本是写一遍管线

- 内容长尾价值被重新定价:YouTube、B 站、播客平台可能会开始向 RAG 厂商收”嵌入授权费”,这是过去文本时代没有的商业模式

常见问题

Q1: 我用 BibiGPT 已经能搜到视频字幕了,多模态嵌入对我有什么额外价值?

A: 字幕搜索只能命中”被说出来的词”。多模态嵌入能命中”画面里出现的内容”——比如一张没被旁白提到的图表、一段背景音乐的风格、一个 PPT 上的关键公式。如果你做学习类、技术类视频,画面里的信息密度往往比字幕高,多模态检索会把这部分隐藏价值释放出来。

Q2: Gemini Embedding 2 的 API 价格贵吗?BibiGPT 用户是否需要自带 Key?

A: Google 在 changelog 里把 Gemini Embedding 2 定价压在了和 text-embedding-1 同一档,按 token/秒 计费。BibiGPT 已经在 总结模型选择器 中接入了 Gemini 系列模型,对普通用户来说不需要自带 Key——多模态检索是 BibiGPT 后台帮你做的,你只看到搜索结果。

Q3: 这跟我自己用 Pinecone / Qdrant + OpenAI 嵌入有什么区别?

A: 区别在三层:① 你不用维护向量库;② 不用写视频切片、关键帧抽取的工程;③ 不用调三家 API 拼一个跨模态结果。BibiGPT 把这三件事打包成一个产品体验——你的输入只有视频链接,输出是结构化摘要 + 可搜索 + 可对话。自己搭一套 RAG 大概需要 2-3 周工程量,BibiGPT 是开箱即用。

Q4: 多模态嵌入的检索准确率有多高?

A: 根据 Google 官方 Gemini API Changelog 的发布说明,Gemini Embedding 2 在跨模态 retrieval benchmark 上比第一代提升约 27%。BibiGPT 内部对比测试中,“画面+字幕”联合检索的 Top-3 召回率比纯字幕检索高约 35%——尤其在技术教程、公开课、产品演示这三类内容上提升最明显。

Q5: 我的旧视频已经在 BibiGPT 里,需要重新处理才能享受多模态检索吗?

A: 不需要。BibiGPT 的关键帧抽取和向量化是后台异步完成的,旧内容会随检索栈升级自动获得新能力。已经处理过的视频会比新视频先进入新版索引,对老用户更友好。

立即开始

- 已有 BibiGPT 账号 → 直接打开 全局搜索,试一次”模糊回忆”式查询

- 还没用过 → 立即体验 BibiGPT,把任意 YouTube 链接粘进去看看

- 重度内容工作者 → 试试 合集归纳总结 + 合集 AI 对话,把跨视频检索变成日常

BibiGPT 团队